Similar presentations:

Алгоритмы обучения искусственных нейронных сетей

1. Нейросетевые технологии в обработке и защите данных

Обработка данных искусственныминейронными сетями (ИНС).

Лекция 5.

Алгоритмы обучения

искусственных нейронных сетей

1

2. Нейронные искусственные сети, успешно применяемые для решения задач классификации, прогнозирования и управления, обеспечивают

предельноераспараллеливание алгоритмов,

соответствующих нейросетевой

технологии обработки данных.

2

3. Нейрокомпьютеры как новый класс устройств вычислительной техники являются модельным отображением особенностей, присущих

процессам переработки информации в живыхорганизмах, таким как самоорганизация, обучение,

адаптация.

Возможности нейронных сетей, недоступные

для традиционной математики, позволяют

создавать системы для решения задач управления,

распознавания образов, диагностики заболеваний,

автоматического анализа документов и многих

других приложений.

3

4. ОДНОСЛОЙНЫЕ НЕЙРОННЫЕ СЕТИ

Нейронная сеть представляет собойсовокупность формальных нейронов, связанных

определенным образом друг с другом и с внешней

средой. Вектор входного сигнала, кодирующий

входное воздействие или образ внешней среды,

подается на сеть при активации входных

нейронных элементов. Веса связей нейронных

элементов представляют в виде матрицы W, для

которой wij – вес связи j-го нейрона с i-ым. В

процессе функционирования сети входной вектор

преобразуется в выходной.

4

5. ОДНОСЛОЙНЫЕ НЕЙРОННЫЕ СЕТИ

Обучающие правила определяют изменениясвязей и весов в ответ на входное воздействие.

Слоем нейронной сети называется множество

нейронных элементов, на которые в каждый такт

времени параллельно поступает информация от

других нейронных элементов сети. Однослойные

сети включают один слой элементов,

осуществляющий обработку входной информации

5

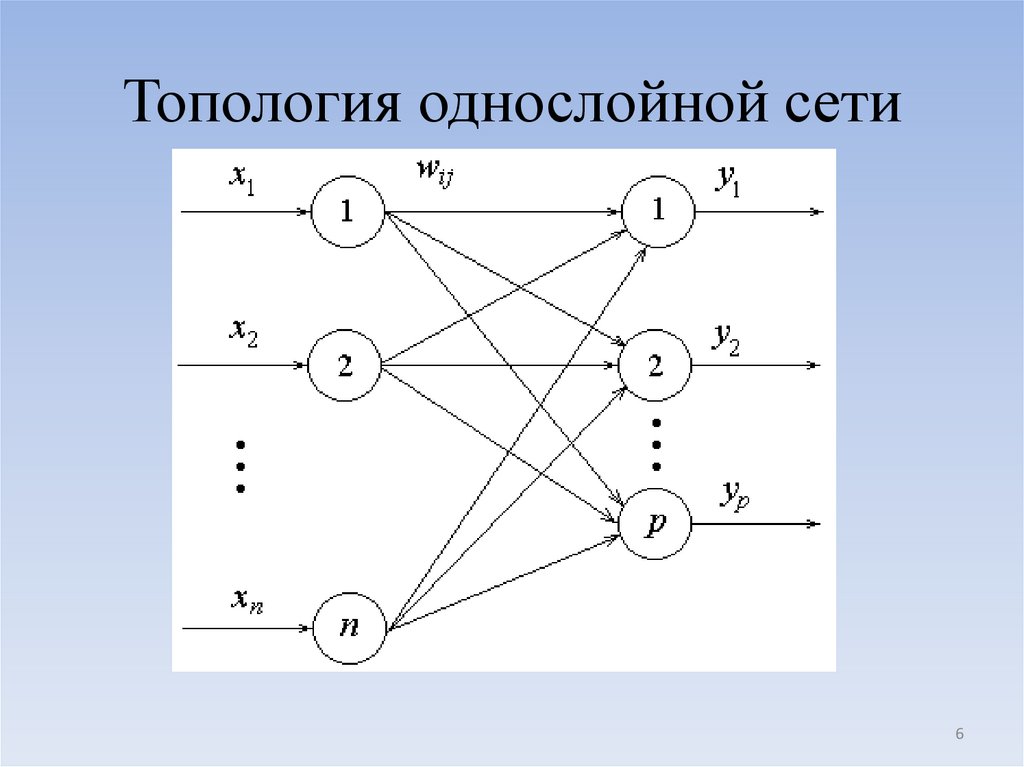

6. Топология однослойной сети

67.

Каждый нейрон распределительного слояимеет синаптические связи со всеми нейронами

обрабатывающего слоя. Выходное значение j-го

нейрона обрабатывающего слоя сети можно

представить как:

n

Y j F ( s j ) F wij xi S 0 j

i 1

где S 0 j – смещение j-го нейронного элемента

выходного слоя, wij – сила связи между j-ым

нейроном распределительного слоя и i-ым

нейроном обрабатывающего слоя.

7

8. Нейросетевые модели логических операций

Логические операции определяютсясетью с двумя нейронами на входе и одним

нейроном выходного слоя

Взвешенная сумма в этом случае равна:

w11 x1 w21 x2 S0 0 ,

а выходное значение нейронной сети

S 0

0,

.

Y

1,

S 0

8

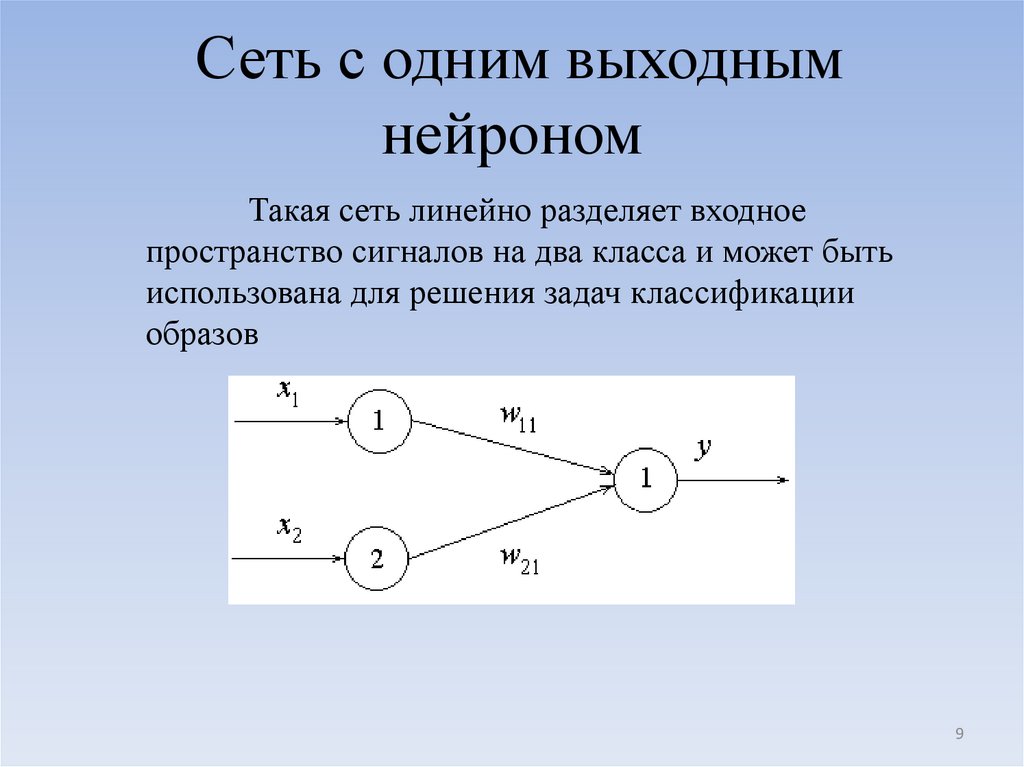

9. Сеть с одним выходным нейроном

Такая сеть линейно разделяет входноепространство сигналов на два класса и может быть

использована для решения задач классификации

образов

9

10.

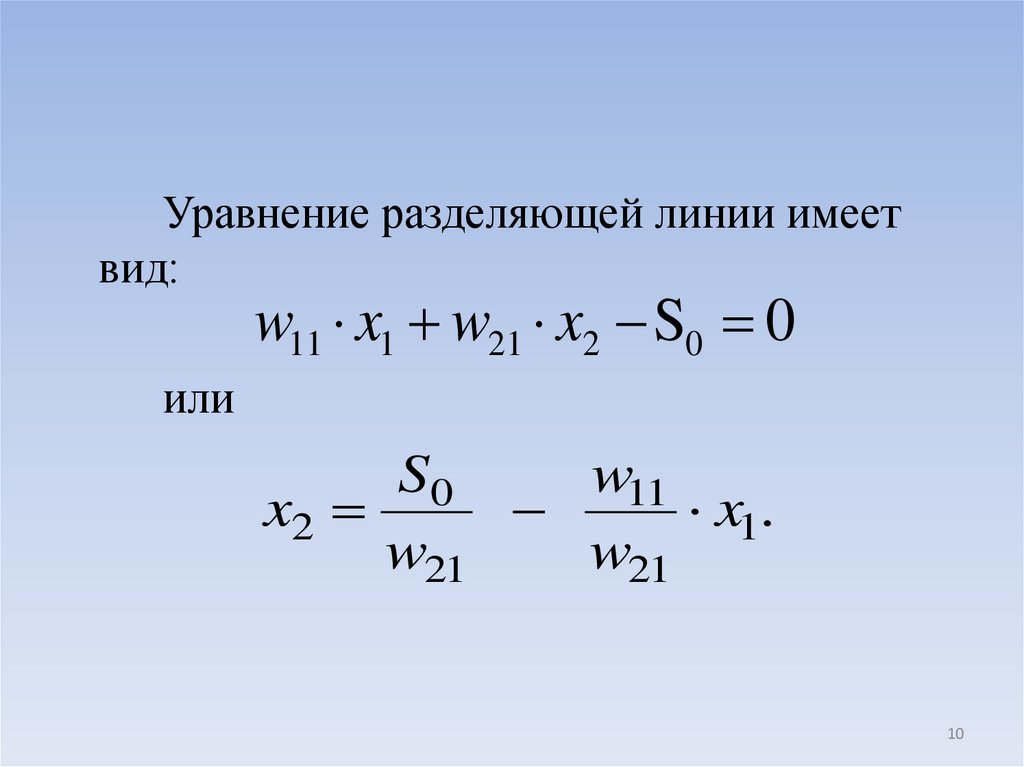

Уравнение разделяющей линии имеетвид:

w11 x1 w21 x2 S0 0

или

S0

w11

x2

x1.

w21

w21

10

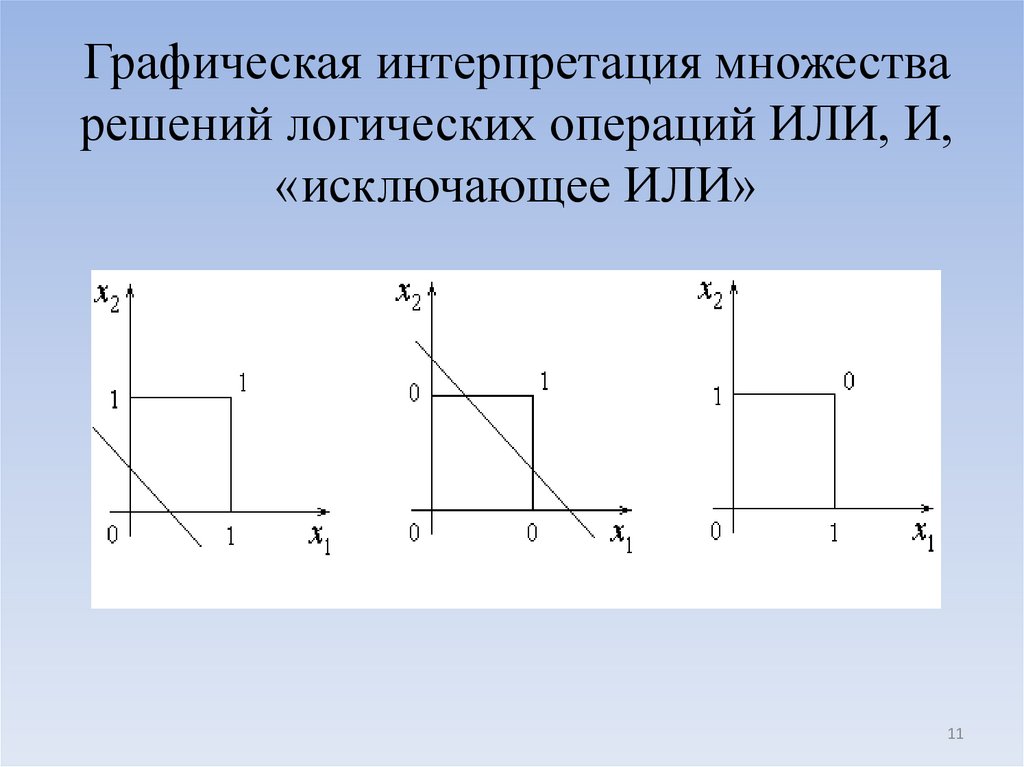

11. Графическая интерпретация множества решений логических операций ИЛИ, И, «исключающее ИЛИ»

1112.

Множество решений сети нельзя разделитьна два класса для операции «исключающее

ИЛИ».

Если размерность входного сигнала n=3, то

разделяющей поверхностью является

плоскость, при n>3 разделяющей

поверхностью является гиперплоскость.

Обучение сети можно производить путем

настройки весовых коэффициентов и

смещений, если порог или смещение нейрона

изобразить как синаптическую связь с

весовым коэффициентом, равным значению

12

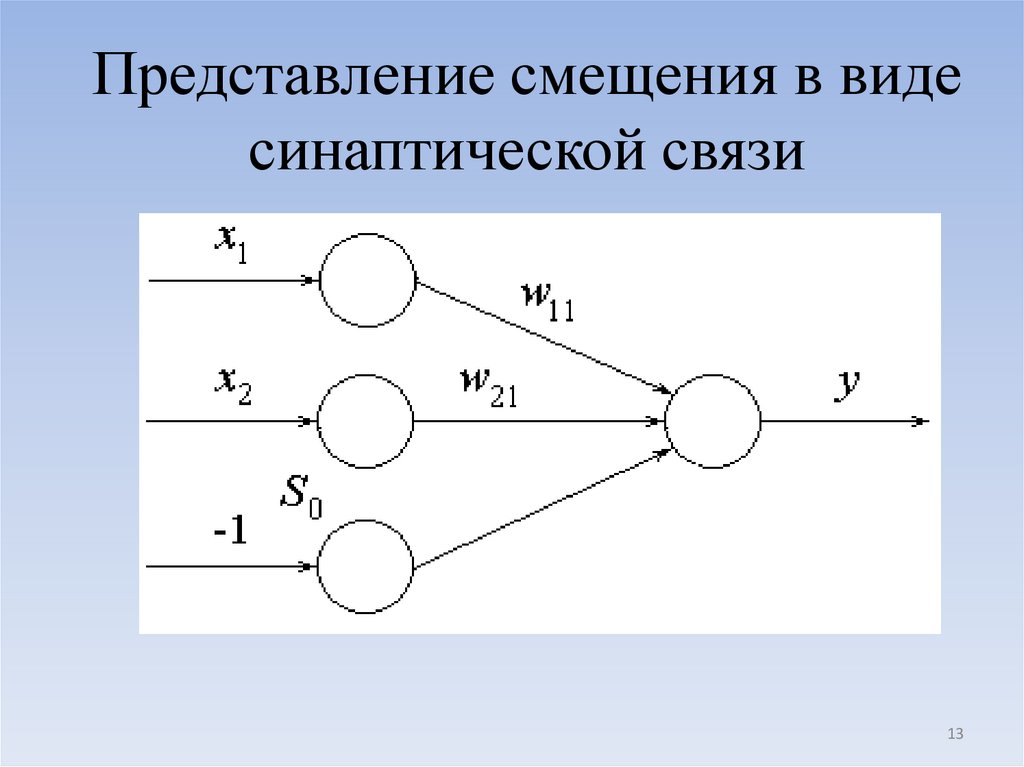

13. Представление смещения в виде синаптической связи

1314.

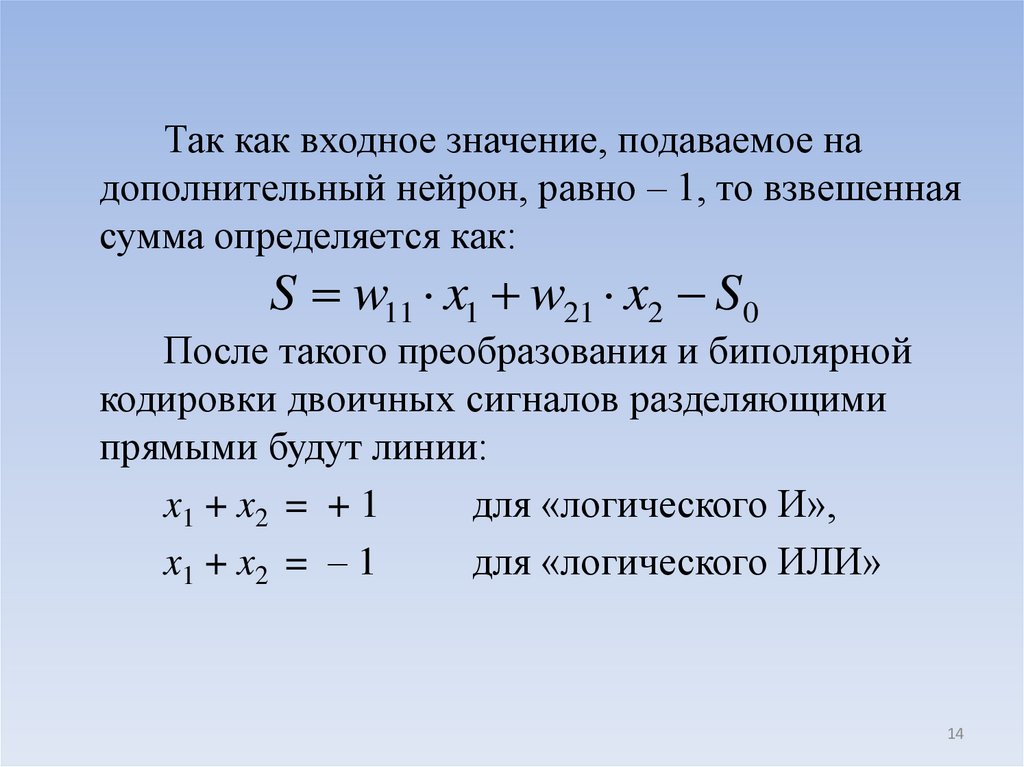

Так как входное значение, подаваемое надополнительный нейрон, равно – 1, то взвешенная

сумма определяется как:

S w11 x1 w21 x2 S0

После такого преобразования и биполярной

кодировки двоичных сигналов разделяющими

прямыми будут линии:

x1 + x2 = + 1

для «логического И»,

x1 + x2 = – 1

для «логического ИЛИ»

14

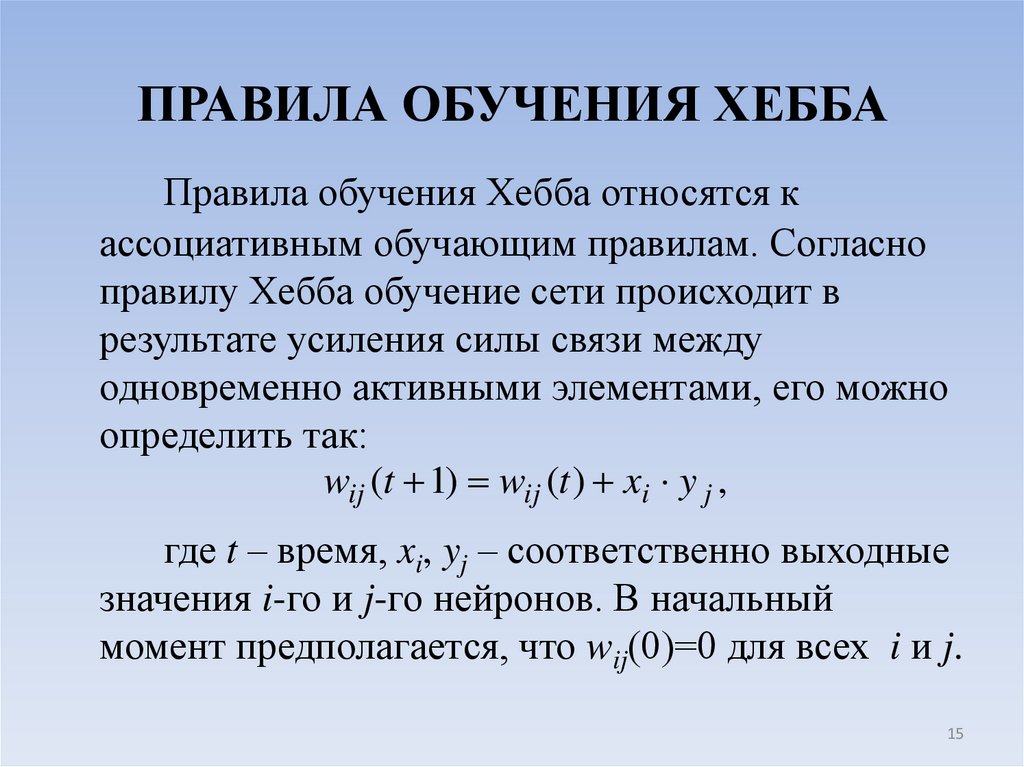

15. ПРАВИЛА ОБУЧЕНИЯ ХЕББА

Правила обучения Хебба относятся кассоциативным обучающим правилам. Согласно

правилу Хебба обучение сети происходит в

результате усиления силы связи между

одновременно активными элементами, его можно

определить так:

wij (t 1) wij (t ) xi y j ,

где t – время, xi, yj – соответственно выходные

значения i-го и j-го нейронов. В начальный

момент предполагается, что wij(0)=0 для всех i и j.

15

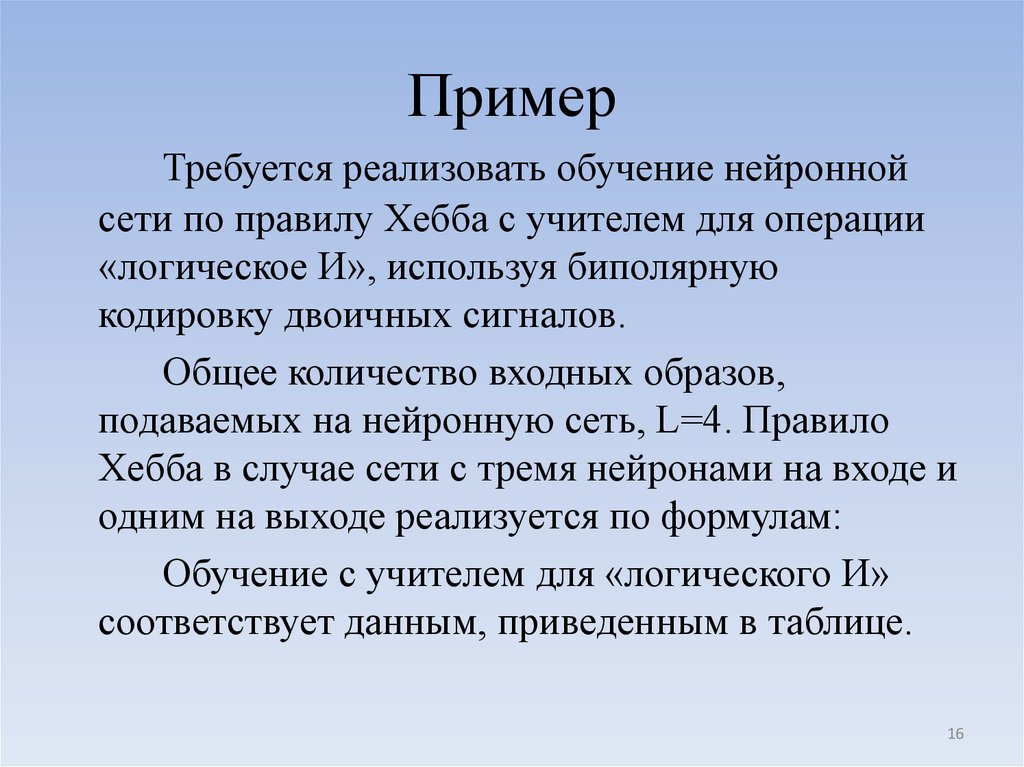

16. Пример

Требуется реализовать обучение нейроннойсети по правилу Хебба с учителем для операции

«логическое И», используя биполярную

кодировку двоичных сигналов.

Общее количество входных образов,

подаваемых на нейронную сеть, L=4. Правило

Хебба в случае сети с тремя нейронами на входе и

одним на выходе реализуется по формулам:

Обучение с учителем для «логического И»

соответствует данным, приведенным в таблице.

16

17. Результаты обучения сети по правилу Хебба

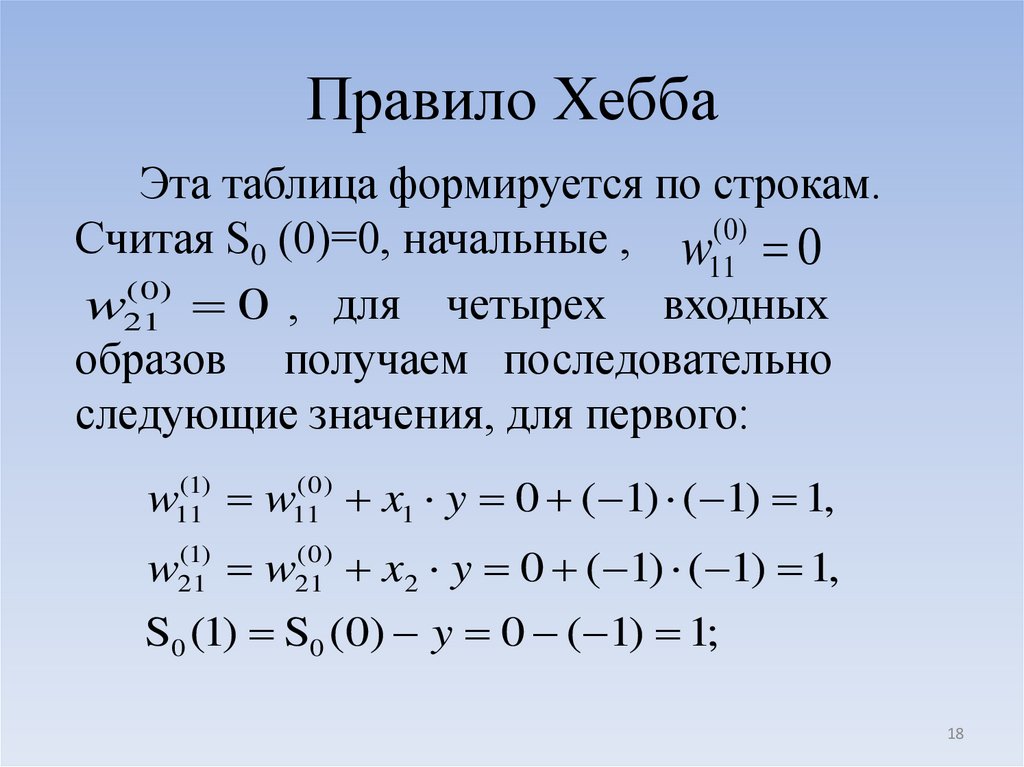

1718. Правило Хебба

Эта таблица формируется по строкам.Считая S0 (0)=0, начальные , w( 0) 0

11

( 0)

w21 0 , для четырех входных

образов получаем последовательно

следующие значения, для первого:

(1)

(0)

w11

w11

x1 y 0 ( 1) ( 1) 1,

(1)

21

w

w

(0)

21

x2 y 0 ( 1) ( 1) 1,

S0 (1) S0 (0) y 0 ( 1) 1;

18

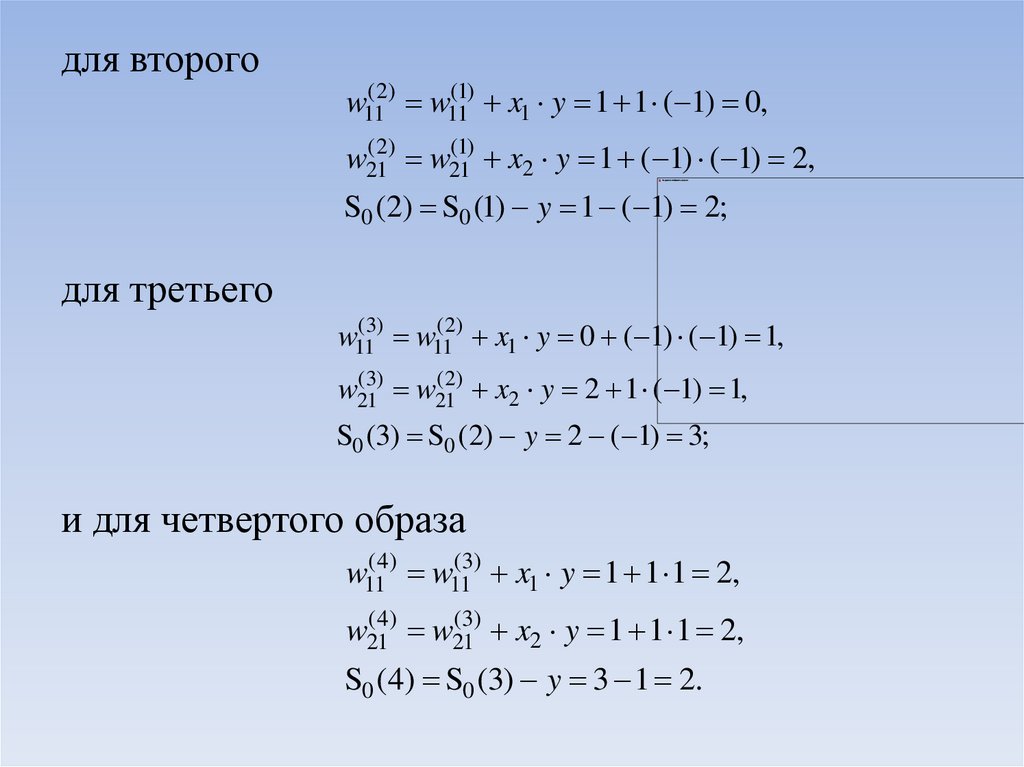

19.

для второго( 2)

(1)

w11

w11

x1 y 1 1 ( 1) 0,

( 2)

(1)

w21

w21

x2 y 1 ( 1) ( 1) 2,

S0 (2) S0 (1) y 1 ( 1) 2;

для третьего

(3)

( 2)

w11

w11

x1 y 0 ( 1) ( 1) 1,

(3)

( 2)

w21

w21

x2 y 2 1 ( 1) 1,

S0 (3) S0 (2) y 2 ( 1) 3;

и для четвертого образа

( 4)

(3)

w11

w11

x1 y 1 1 1 2,

( 4)

(3)

w21

w21

x2 y 1 1 1 2,

S0 (4) S0 (3) y 3 1 2.

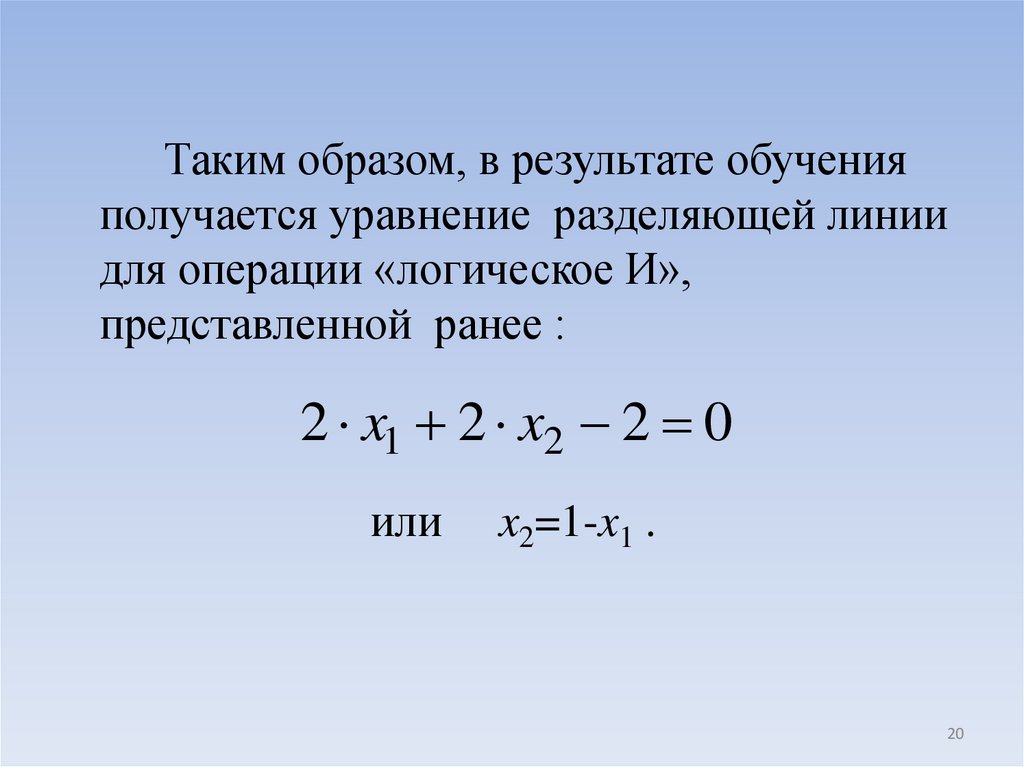

20.

Таким образом, в результате обученияполучается уравнение разделяющей линии

для операции «логическое И»,

представленной ранее :

2 x1 2 x2 2 0

или

x2=1-x1 .

20

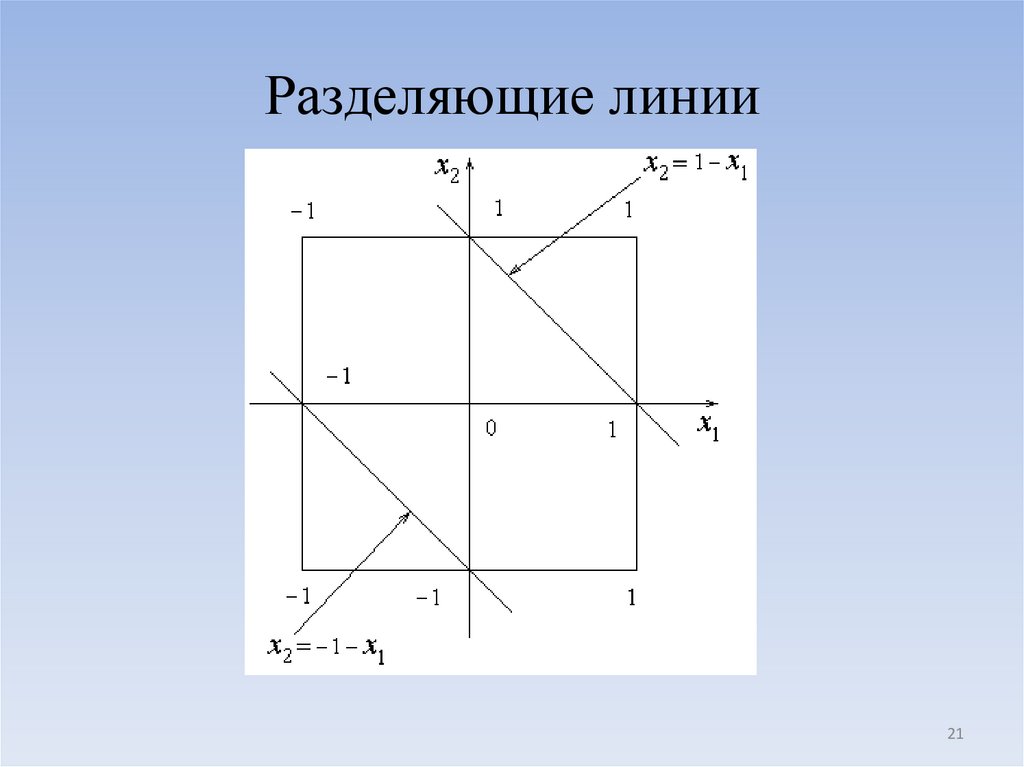

21. Разделяющие линии

2122. Исключающее ИЛИ

Для решения задачи «исключающегоИЛИ» можно использовать сеть второго

порядка, включающую произведение

переменных, тогда взвешенная сумма :

S 2 x1 2 x 2 4 x1 x 2 1

22

23. Правила обучения по Хеббу

Правило обучения по Хеббу в общем случаезадается формулой:

wij (t 1) wij (t ) xi y j

i=1,2,…,L,

j=1,2,…,p,

где – коэффициент обучения или темп

обучения, в нейроимитаторе NNT это правило

реализует процедура настройки learnh. Правило

Хебба с модификацией весов определяется по

формуле: wij (t 1) wij (t ) xi y j wij (t ),

где – коэффициент убывания или

возрастания веса.

23

24. ПРАВИЛА ОБУЧЕНИЯ ПЕРСЕПТРОНА

Персептрон – нейронная сеть прямойпередачи сигнала с бинарными входами и

бинарной пороговой функцией активации.

Правило обучения Розенблатта в общем

случае является вариантом правил обучения

Хебба, формирующих симметричную матрицу

связей, и в тех же обозначениях имеет вид:

wij (t 1) wij (t ) (ti y j ) xi

где – коэффициент обучения, 0< <1,

tj – эталонные или целевые значения.

24

informatics

informatics electronics

electronics