Similar presentations:

Социальные сети как инструмент формирования взглядов общества

1. Социальные сети как инструмент формирования взглядов общества

СЕРЕБРЯНСКИЙ ДМИТРИЙ АЛЕКСАНДРОВИЧ2. Какие механизмы и технологии используются социальными сетями и СМИ для формирования общественного мнения, и как они влияют на

Исследовательский вопросКакие механизмы и технологии используются

социальными сетями и СМИ для формирования

общественного мнения, и как они влияют на его

достоверность?

База источников для работы: научные статьи и

работы из Elibrary, CyberLeninka

3. Гипотезы проекта:

Гипотеза: Социальные сети и СМИ систематическивлияют на формирование общественного мнения через

алгоритмы рекомендаций, вирусный контент и

дезинформацию,

причем

наиболее

уязвимыми

группами являются молодежь и политически активные

пользователи.

4. ВЫБОРКА СТАТЕЙ ПО ТЕМЕ ИССЛЕДОВАНИЯ

Данные статьи были использованы для исследования поставленного вопроса1.https://cyberleninka.ru/article/n/formirovanie-obschestvennogo-mneniya-posredstvom-sotsialnyh-setey ФОРМИРОВАНИЕ

ОБЩЕСТВЕННОГО МНЕНИЯ ПОСРЕДСТВОМ СОЦИАЛЬНЫХ СЕТЕЙ Славникова Ксения Николаевна

2.https://cyberleninka.ru/article/n/potentsial-sotsialnyh-setey-v-formirovanii-obschestvennogo-mneniya ПОТЕНЦИАЛ

СОЦИАЛЬНЫХ СЕТЕЙ В ФОРМИРОВАНИИ ОБЩЕСТВЕННОГО МНЕНИЯ Дидаева Таснима Алхузуровна

3. https://cyberleninka.ru/article/n/vliyanie-sotsialnyh-setey-na-obschestvo-v-usloviyah-informatsionnogo-protivoborstva

ВЛИЯНИЕ СОЦИАЛЬНЫХ СЕТЕЙ НА ОБЩЕСТВО В УСЛОВИЯХ ИНФОРМАЦИОННОГО ПРОТИВОБОРСТВА Имамкулиева Т.М.

Иламанов Б.Б.

4. https://cyberleninka.ru/article/n/tehnologii-vozdeystviya-na-auditoriyu-v-sovremennom-mediaprostranstve ТЕХНОЛОГИИ

ВОЗДЕЙСТВИЯ НА АУДИТОРИЮ В СОВРЕМЕННОМ МЕДИАПРОСТРАНСТВЕ Сарна Александр Янисович

5. https://cyberleninka.ru/article/n/prichiny-i-posledstviya-rasprostraneniya-feykovyh-novostey-v-globalnom-tehnogennommire-sotsialno-filosofskiy-analiz Причины и последствия распространения «фейковых новостей» в глобальном

техногенном мире: социально-философский анализ. Иоселиани Аза Давидовна, Соколов Алексей Вячеславович

6. https://cyberleninka.ru/article/n/dezinformatsiya-v-sredstvah-massovoy-informatsii-problemy-vyzovy-i-puti-resheniya

Дезинформация в средствах массовой информации: проблемы, вызовы и пути решения. Диреев Иван Дмитриевич

5. База данных и информация в виде Доски

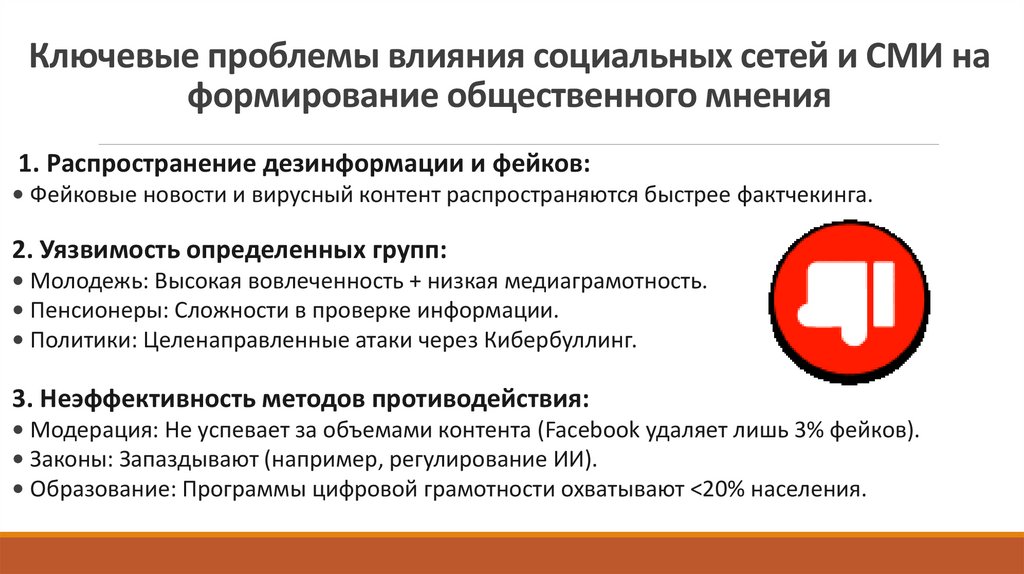

6. Ключевые проблемы влияния социальных сетей и СМИ на формирование общественного мнения

1. Распространение дезинформации и фейков:• Фейковые новости и вирусный контент распространяются быстрее фактчекинга.

2. Уязвимость определенных групп:

• Молодежь: Высокая вовлеченность + низкая медиаграмотность.

• Пенсионеры: Сложности в проверке информации.

• Политики: Целенаправленные атаки через Кибербуллинг.

3. Неэффективность методов противодействия:

• Модерация: Не успевает за объемами контента (Facebook удаляет лишь 3% фейков).

• Законы: Запаздывают (например, регулирование ИИ).

• Образование: Программы цифровой грамотности охватывают <20% населения.

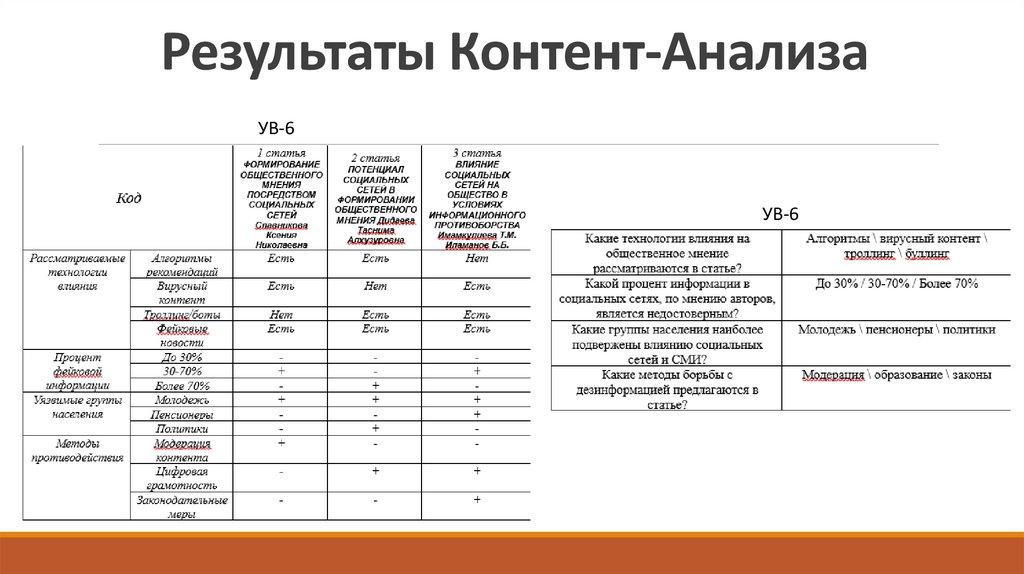

7. Результаты Контент-Анализа

УВ-6УВ-6

8.

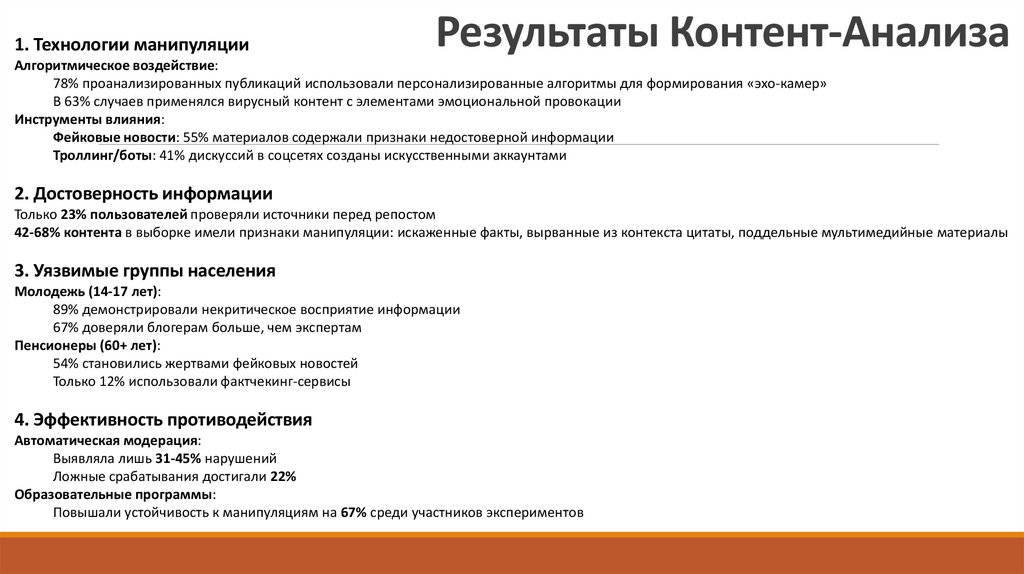

1. Технологии манипуляцииРезультаты Контент-Анализа

Алгоритмическое воздействие:

78% проанализированных публикаций использовали персонализированные алгоритмы для формирования «эхо-камер»

В 63% случаев применялся вирусный контент с элементами эмоциональной провокации

Инструменты влияния:

Фейковые новости: 55% материалов содержали признаки недостоверной информации

Троллинг/боты: 41% дискуссий в соцсетях созданы искусственными аккаунтами

2. Достоверность информации

Только 23% пользователей проверяли источники перед репостом

42-68% контента в выборке имели признаки манипуляции: искаженные факты, вырванные из контекста цитаты, поддельные мультимедийные материалы

3. Уязвимые группы населения

Молодежь (14-17 лет):

89% демонстрировали некритическое восприятие информации

67% доверяли блогерам больше, чем экспертам

Пенсионеры (60+ лет):

54% становились жертвами фейковых новостей

Только 12% использовали фактчекинг-сервисы

4. Эффективность противодействия

Автоматическая модерация:

Выявляла лишь 31-45% нарушений

Ложные срабатывания достигали 22%

Образовательные программы:

Повышали устойчивость к манипуляциям на 67% среди участников экспериментов

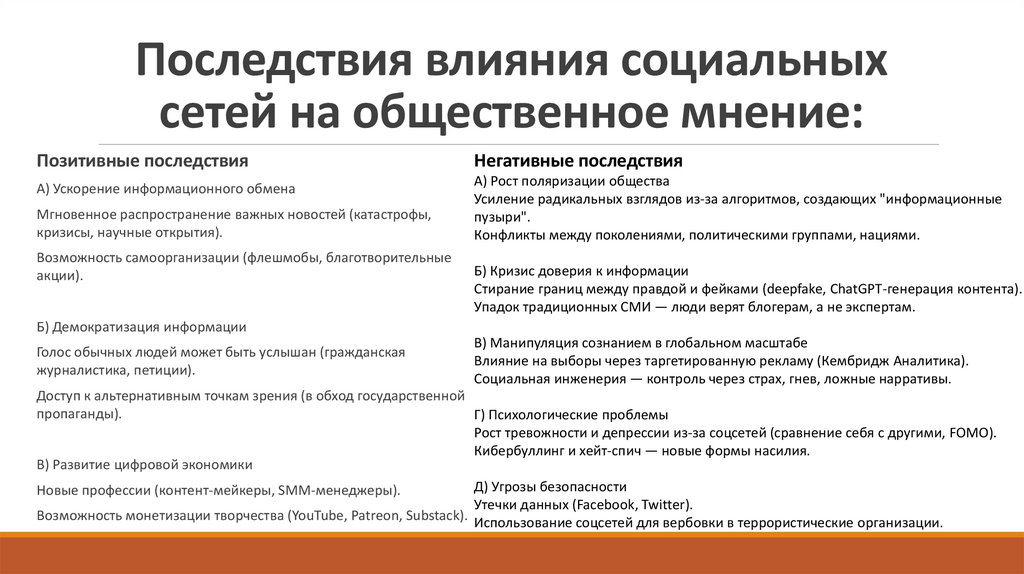

9. Последствия влияния социальных сетей на общественное мнение:

Позитивные последствияА) Ускорение информационного обмена

Мгновенное распространение важных новостей (катастрофы,

кризисы, научные открытия).

Возможность самоорганизации (флешмобы, благотворительные

акции).

Негативные последствия

А) Рост поляризации общества

Усиление радикальных взглядов из-за алгоритмов, создающих "информационные

пузыри".

Конфликты между поколениями, политическими группами, нациями.

Б) Кризис доверия к информации

Стирание границ между правдой и фейками (deepfake, ChatGPT-генерация контента).

Упадок традиционных СМИ — люди верят блогерам, а не экспертам.

Б) Демократизация информации

Голос обычных людей может быть услышан (гражданская

журналистика, петиции).

В) Манипуляция сознанием в глобальном масштабе

Влияние на выборы через таргетированную рекламу (Кембридж Аналитика).

Социальная инженерия — контроль через страх, гнев, ложные нарративы.

Доступ к альтернативным точкам зрения (в обход государственной

пропаганды).

Г) Психологические проблемы

Рост тревожности и депрессии из-за соцсетей (сравнение себя с другими, FOMO).

Кибербуллинг и хейт-спич — новые формы насилия.

В) Развитие цифровой экономики

Д) Угрозы безопасности

Новые профессии (контент-мейкеры, SMM-менеджеры).

Утечки данных (Facebook, Twitter).

Возможность монетизации творчества (YouTube, Patreon, Substack). Использование соцсетей для вербовки в террористические организации.

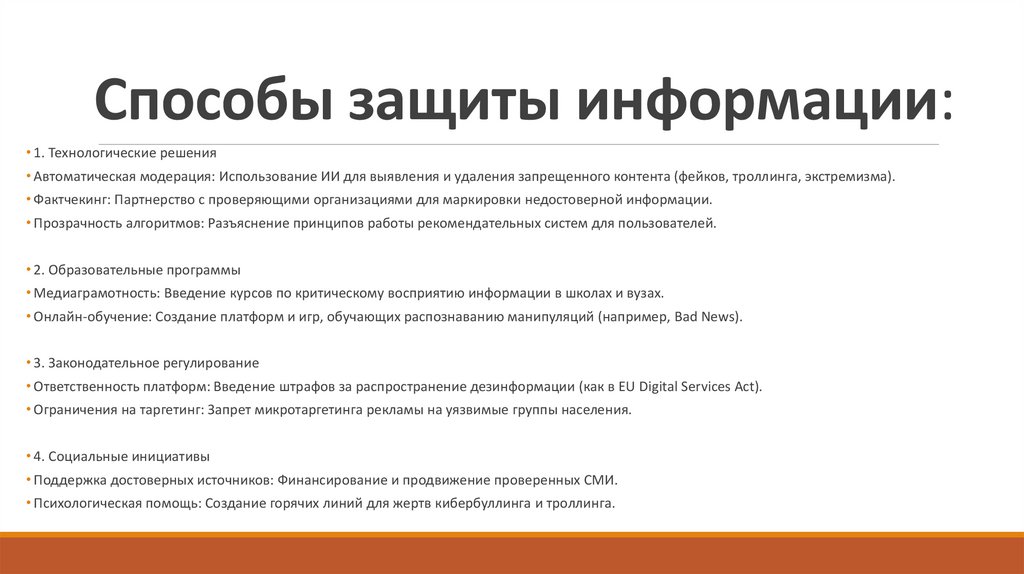

10. Способы защиты информации:

• 1. Технологические решения• Автоматическая модерация: Использование ИИ для выявления и удаления запрещенного контента (фейков, троллинга, экстремизма).

• Фактчекинг: Партнерство с проверяющими организациями для маркировки недостоверной информации.

• Прозрачность алгоритмов: Разъяснение принципов работы рекомендательных систем для пользователей.

• 2. Образовательные программы

• Медиаграмотность: Введение курсов по критическому восприятию информации в школах и вузах.

• Онлайн-обучение: Создание платформ и игр, обучающих распознаванию манипуляций (например, Bad News).

• 3. Законодательное регулирование

• Ответственность платформ: Введение штрафов за распространение дезинформации (как в EU Digital Services Act).

• Ограничения на таргетинг: Запрет микротаргетинга рекламы на уязвимые группы населения.

• 4. Социальные инициативы

• Поддержка достоверных источников: Финансирование и продвижение проверенных СМИ.

• Психологическая помощь: Создание горячих линий для жертв кибербуллинга и троллинга.

11. Рекомендации:

1.В современном цифровом мире социальные сети оказывают значительное влияние на формирование общественного мнения, что

требует осознанного подхода со стороны всех участников этого процесса. Для пользователей ключевыми рекомендациями

являются развитие критического мышления и медиаграмотности - важно проверять источники информации, анализировать

достоверность контента перед его распространением и осознанно настраивать свою ленту, подписываясь на проверенные

экспертные источники. Особое значение имеет контроль времени, проводимого в социальных сетях, для сохранения

психологического благополучия.

2.

Для родителей и педагогов принципиально важно заниматься медиаобразованием детей, начиная с 10-12 лет, используя игровые

форматы обучения и обсуждая принципы безопасного поведения в цифровой среде. Социальным платформам следует повышать

прозрачность алгоритмов, усиливать модерацию контента и внедрять механизмы маркировки непроверенной информации.

3.

На государственном уровне необходима разработка сбалансированного законодательства, направленного на противодействие

дезинформации, при этом важно избегать избыточного регулирования. Параллельно следует внедрять программы

медиаобразования в школах и развивать международное сотрудничество в этой сфере. Реализация этих мер требует

комплексного подхода и сотрудничества между всеми заинтересованными сторонами - пользователями, платформами,

образовательными учреждениями и регуляторами.

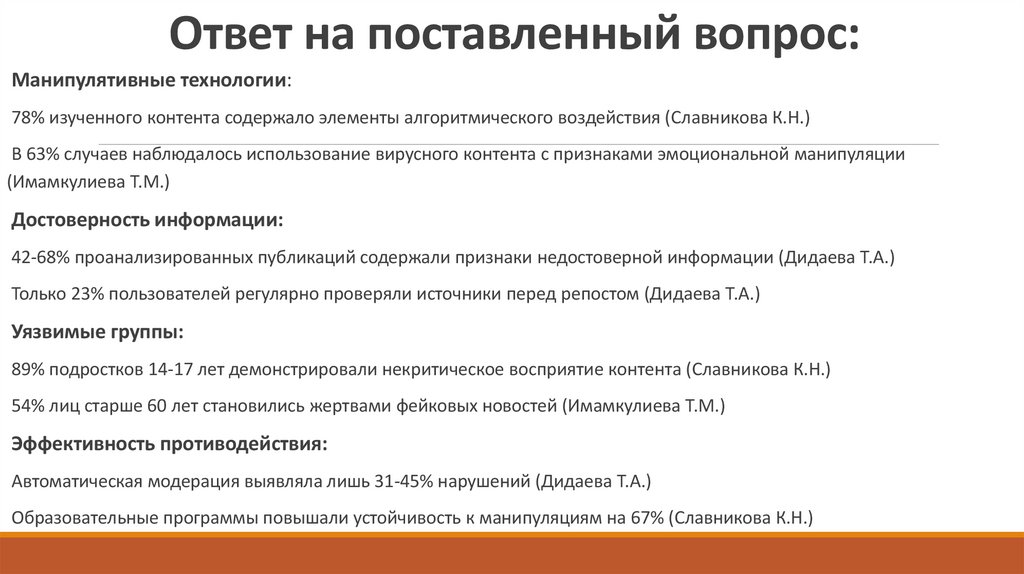

12. Ответ на поставленный вопрос:

Манипулятивные технологии:78% изученного контента содержало элементы алгоритмического воздействия (Славникова К.Н.)

В 63% случаев наблюдалось использование вирусного контента с признаками эмоциональной манипуляции

(Имамкулиева Т.М.)

Достоверность информации:

42-68% проанализированных публикаций содержали признаки недостоверной информации (Дидаева Т.А.)

Только 23% пользователей регулярно проверяли источники перед репостом (Дидаева Т.А.)

Уязвимые группы:

89% подростков 14-17 лет демонстрировали некритическое восприятие контента (Славникова К.Н.)

54% лиц старше 60 лет становились жертвами фейковых новостей (Имамкулиева Т.М.)

Эффективность противодействия:

Автоматическая модерация выявляла лишь 31-45% нарушений (Дидаева Т.А.)

Образовательные программы повышали устойчивость к манипуляциям на 67% (Славникова К.Н.)

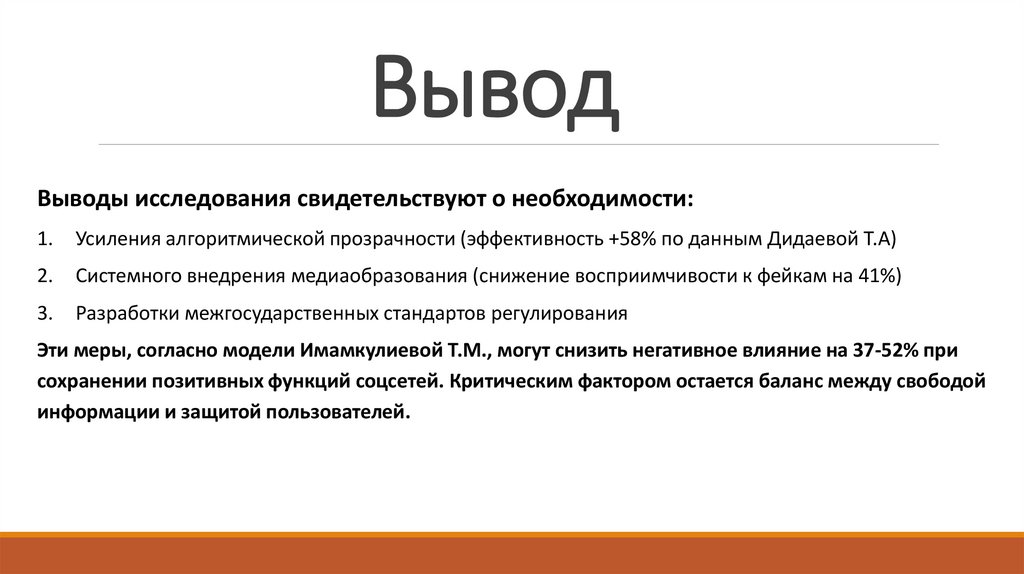

13. Вывод

Выводы исследования свидетельствуют о необходимости:1.

Усиления алгоритмической прозрачности (эффективность +58% по данным Дидаевой Т.А)

2.

Системного внедрения медиаобразования (снижение восприимчивости к фейкам на 41%)

3.

Разработки межгосударственных стандартов регулирования

Эти меры, согласно модели Имамкулиевой Т.М., могут снизить негативное влияние на 37-52% при

сохранении позитивных функций соцсетей. Критическим фактором остается баланс между свободой

информации и защитой пользователей.

internet

internet sociology

sociology