Similar presentations:

Методы автоматического извлечения отношений гипоним-гипероним (таксономических отношений) из текстов

1. Методы автоматического извлечения отношений гипоним-гипероним (таксономических отношений) из текстов

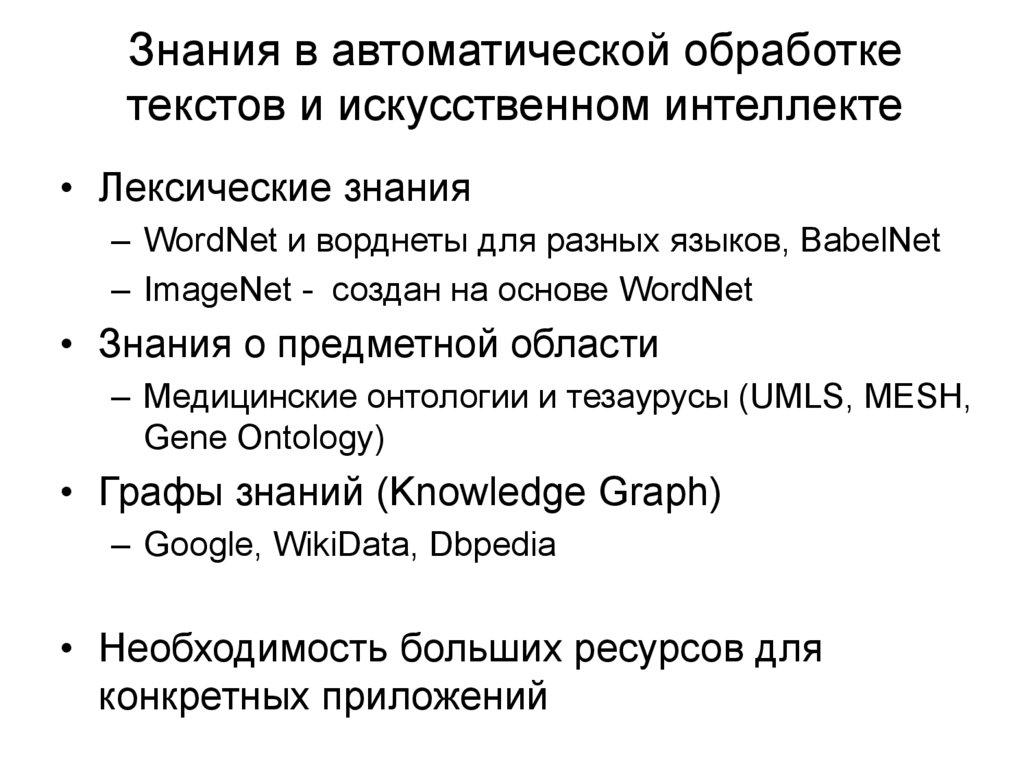

2. Знания в автоматической обработке текстов и искусственном интеллекте

• Лексические знания– WordNet и ворднеты для разных языков, BabelNet

– ImageNet - создан на основе WordNet

• Знания о предметной области

– Медицинские онтологии и тезаурусы (UMLS, MESH,

Gene Ontology)

• Графы знаний (Knowledge Graph)

– Google, WikiData, Dbpedia

• Необходимость больших ресурсов для

конкретных приложений

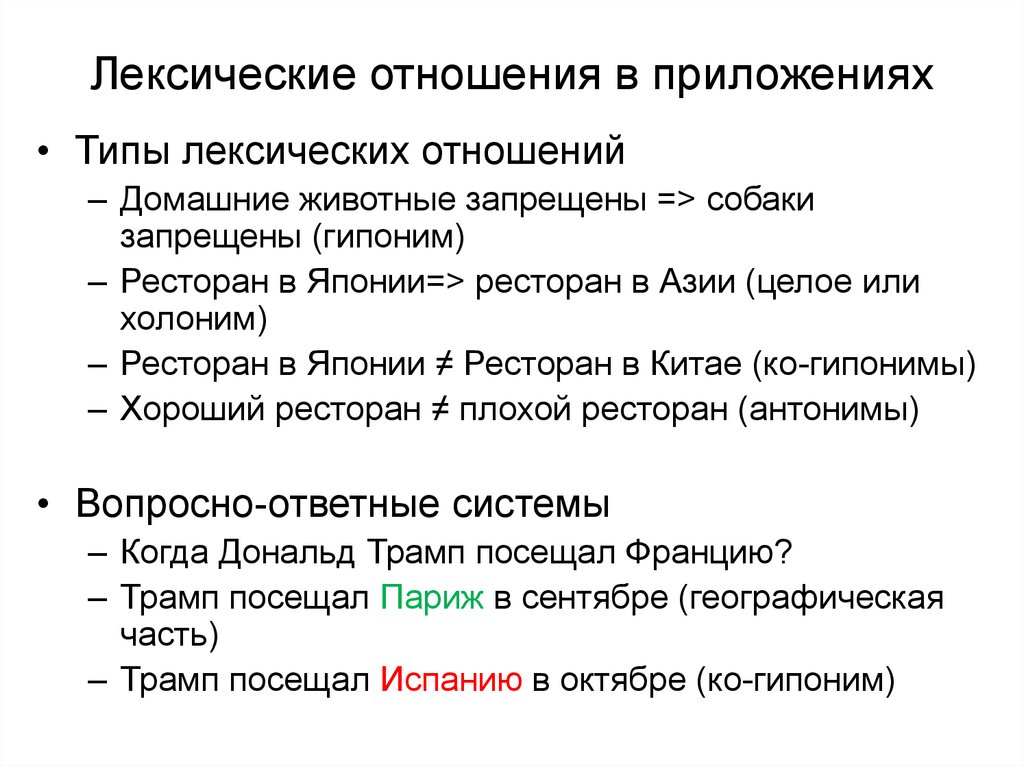

3. Лексические отношения в приложениях

• Типы лексических отношений– Домашние животные запрещены => собаки

запрещены (гипоним)

– Ресторан в Японии=> ресторан в Азии (целое или

холоним)

– Ресторан в Японии ≠ Ресторан в Китае (ко-гипонимы)

– Хороший ресторан ≠ плохой ресторан (антонимы)

• Вопросно-ответные системы

– Когда Дональд Трамп посещал Францию?

– Трамп посещал Париж в сентябре (географическая

часть)

– Трамп посещал Испанию в октябре (ко-гипоним)

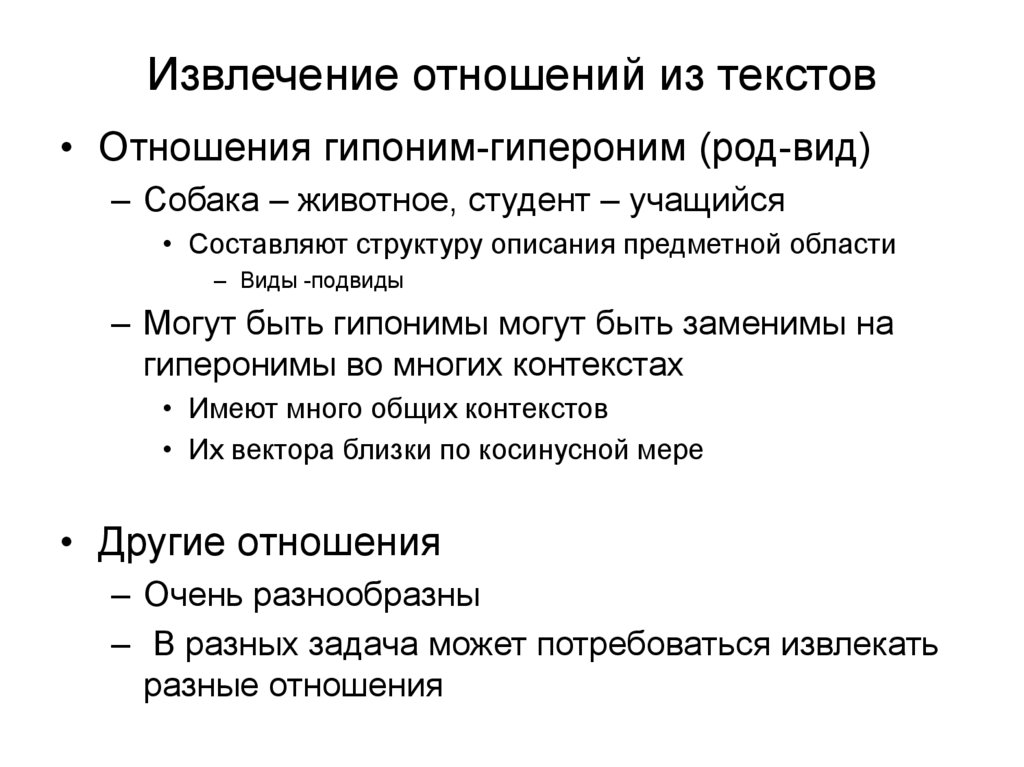

4. Извлечение отношений из текстов

• Отношения гипоним-гипероним (род-вид)– Собака – животное, студент – учащийся

• Составляют структуру описания предметной области

– Виды -подвиды

– Могут быть гипонимы могут быть заменимы на

гиперонимы во многих контекстах

• Имеют много общих контекстов

• Их вектора близки по косинусной мере

• Другие отношения

– Очень разнообразны

– В разных задача может потребоваться извлекать

разные отношения

5. Векторные представления слов и лексические ресурсы

• На основе векторных представлений словможно предсказывать близость слов

– Могут быть ошибки

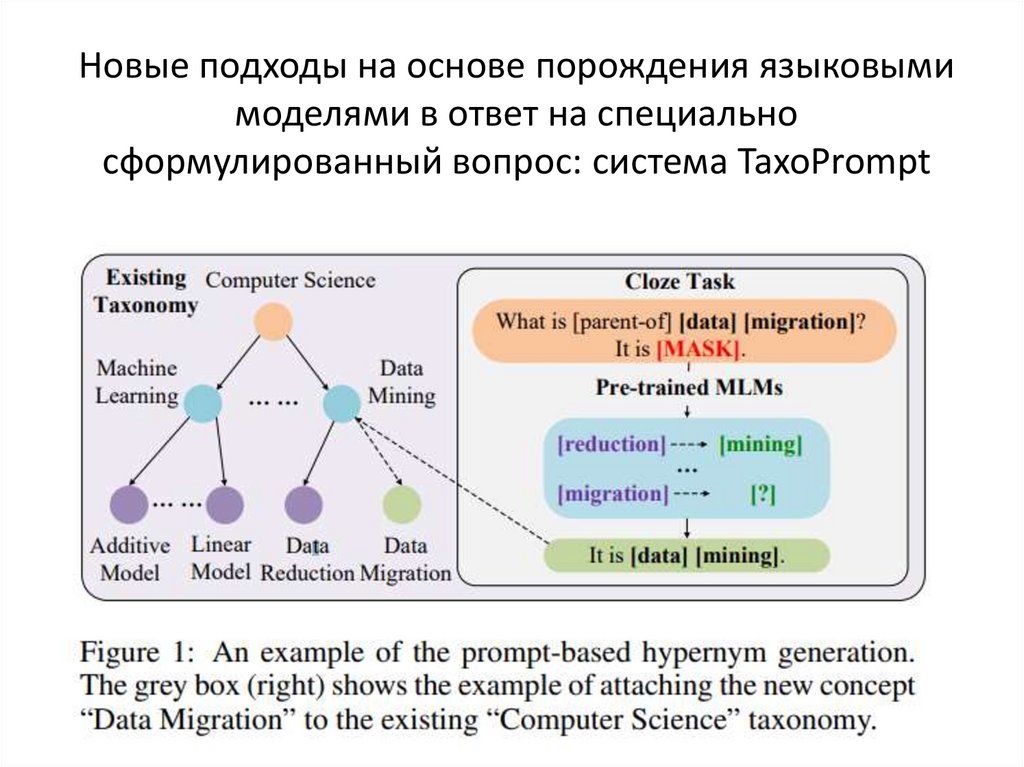

• Но векторные представления не могут

определять точное отношение между

словами

– Синонимы

– Гипоним-гипероним

– Часть-целое

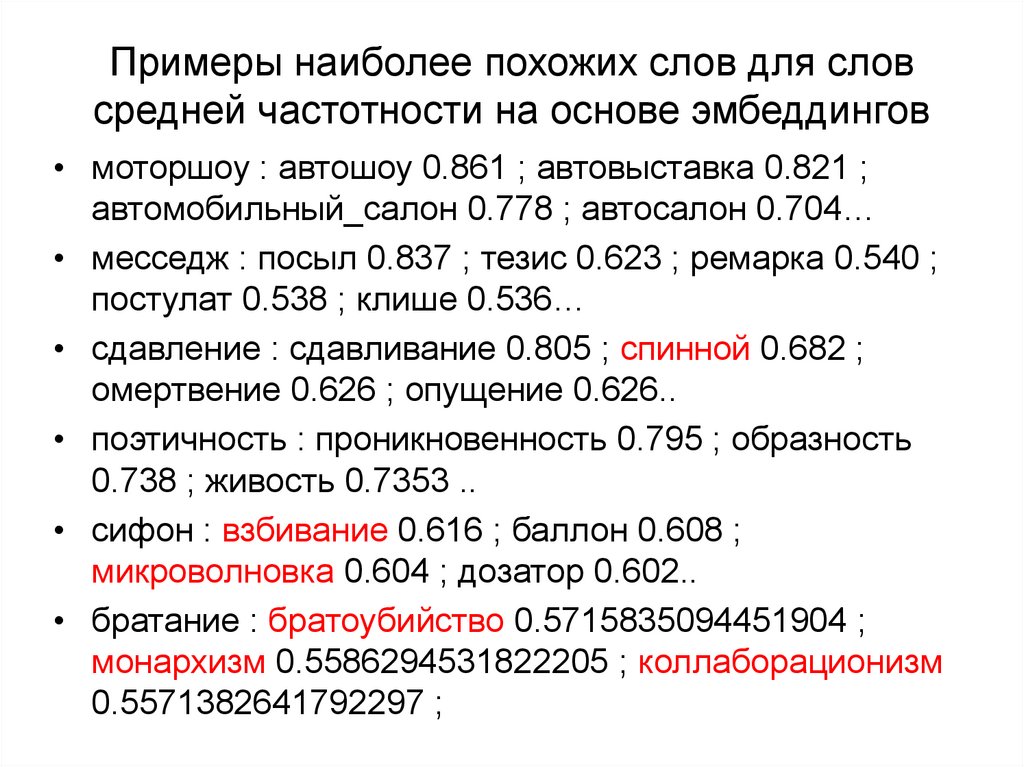

6. Примеры наиболее похожих слов для слов средней частотности на основе эмбеддингов

• моторшоу : автошоу 0.861 ; автовыставка 0.821 ;автомобильный_салон 0.778 ; автосалон 0.704…

• месседж : посыл 0.837 ; тезис 0.623 ; ремарка 0.540 ;

постулат 0.538 ; клише 0.536…

• сдавление : сдавливание 0.805 ; спинной 0.682 ;

омертвение 0.626 ; опущение 0.626..

• поэтичность : проникновенность 0.795 ; образность

0.738 ; живость 0.7353 ..

• сифон : взбивание 0.616 ; баллон 0.608 ;

микроволновка 0.604 ; дозатор 0.602..

• братание : братоубийство 0.5715835094451904 ;

монархизм 0.5586294531822205 ; коллаборационизм

0.5571382641792297 ;

7. Основные методы извлечения таксономических отношений

• Лингвистические методы (на основешаблонов)

– Шаблоны вида регулярных выражений

– Шаблоны на основе синтаксических структур

• Методы на основе векторных представлений

– Без учителя

– Машинное обучение

• Традиционные методы типа SVM

• Projection learning – специализированные линейные

преобразования

• Комбинированные методы

8. Подходы на основе шаблонов

• Подход на основе совместной встречаемости впредложениях в заданных конструкциях (Hearst

patterns,1992):

– X or (other) Y;

– Y, including X

•Шаблоны могут описываться через синтаксические

деревья зависимостей

9. Сложные синтаксические шаблоны (Aldine et al., 2018)

10. Шаблоны для русского языка (Sabirova, Lukanin, 2014)

• Pattern 1. Такие/таких/таким X, как Y [, Y] и/или Y.• Пример контекста:

• В Индии зародились такие {[религии]=HYPER} как

{[индуизм]=HYPO}, {[буддизм]=HYPO},

{[сикхизм]=HYPO} и{[джайнизм]=HYPO}.

• Pattern 2. X, такие/таких/таким как Y [, Y] [и/или Y].

• Пример контекста:

• ... {систем [верований]=HYPER}, таких как

{[шаманизм]=HYPO}, {[политеизм]=HYPO},

{[пантеизм]=HYPO}, {[анимизм]=HYPO}.

11. Проблемы извлечения отношений на основе путей

• Вариативность, могут вклиниваться дополнительныеслова

• Низкая полнота, некоторые пары слов никогда не

встречаются вместе в одном предложении в достаточно

большом корпусе

• Может быть много редких шаблонов, из которых мы всетаки можем сделать вывод, что слова находятся в

таксономическим отношении между собой

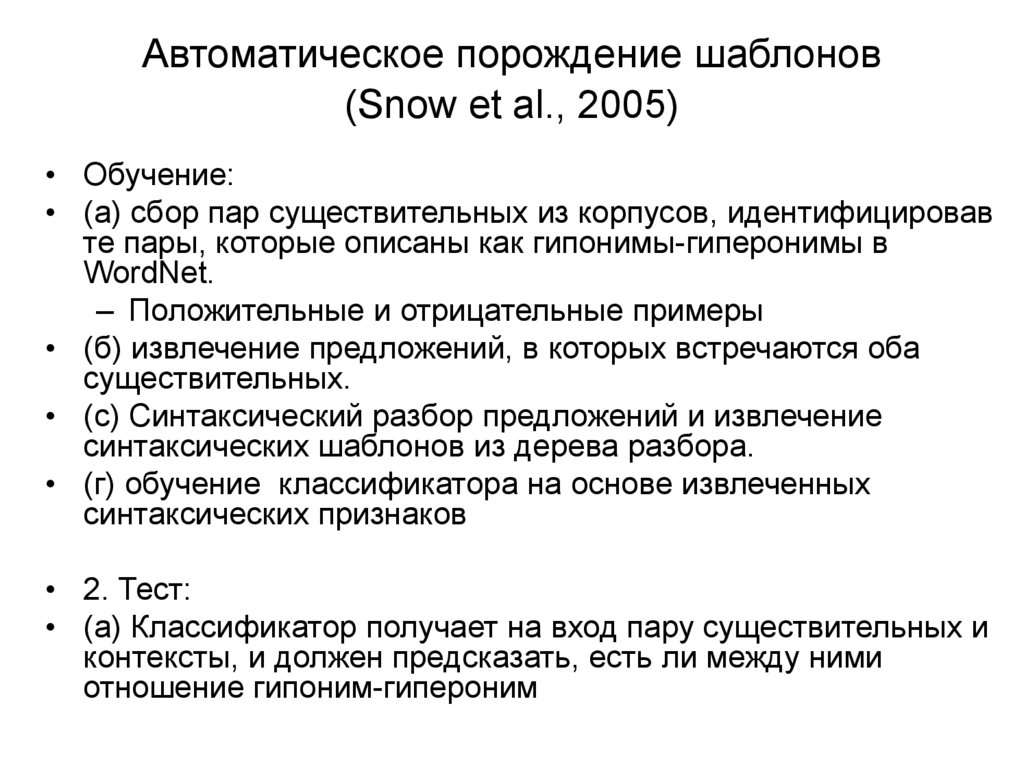

12. Автоматическое порождение шаблонов (Snow et al., 2005)

• Обучение:• (а) сбор пар существительных из корпусов, идентифицировав

те пары, которые описаны как гипонимы-гиперонимы в

WordNet.

– Положительные и отрицательные примеры

• (б) извлечение предложений, в которых встречаются оба

существительных.

• (c) Синтаксический разбор предложений и извлечение

синтаксических шаблонов из дерева разбора.

• (г) обучение классификатора на основе извлеченных

синтаксических признаков

• 2. Тест:

• (a) Классификатор получает на вход пару существительных и

контексты, и должен предсказать, есть ли между ними

отношение гипоним-гипероним

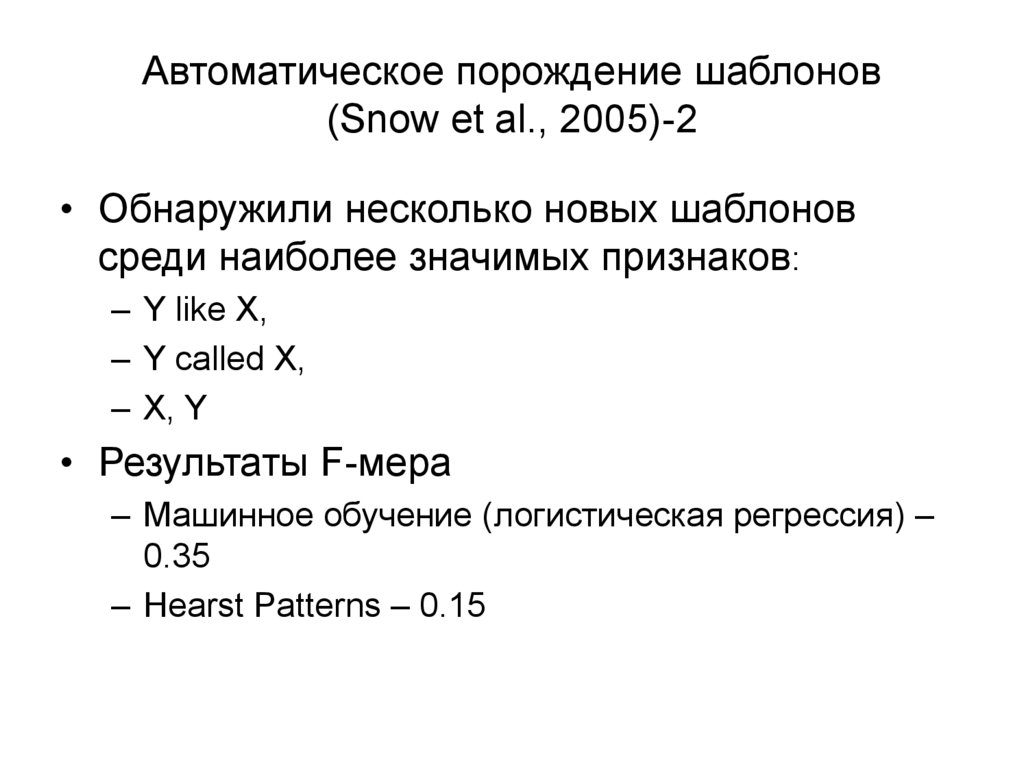

13. Автоматическое порождение шаблонов (Snow et al., 2005)-2

• Обнаружили несколько новых шаблоновсреди наиболее значимых признаков:

– Y like X,

– Y called X,

– X, Y

• Результаты F-мера

– Машинное обучение (логистическая регрессия) –

0.35

– Hearst Patterns – 0.15

14. Машинное обучение на основе векторных представлений

• Представим (x, y) как вектор признаков, на основевекторных представлений:

– Конкатенация x y [Baroni et al., 2012]

– Разность y x [Roller et al., 2014, Weeds et al.,

2014]

• Обучаем классификатор (например, метод опорных

векторов), чтобы предсказать семантические

отношение между x и y

• Достигает очень хорошие результатов на различных

наборах данных

• Более 70% Accuracy

• Является ли задача решенной?

15. Projection learning

• (Fu et al., 2014) Learning Semantic Hierarchies via WordEmbeddings

• Основан на известном свойстве векторных

представлений: похожие сущности группируются в

некоторых областях пространства и можно высчитать

линейное преобразование, например для отношения

страна-столица

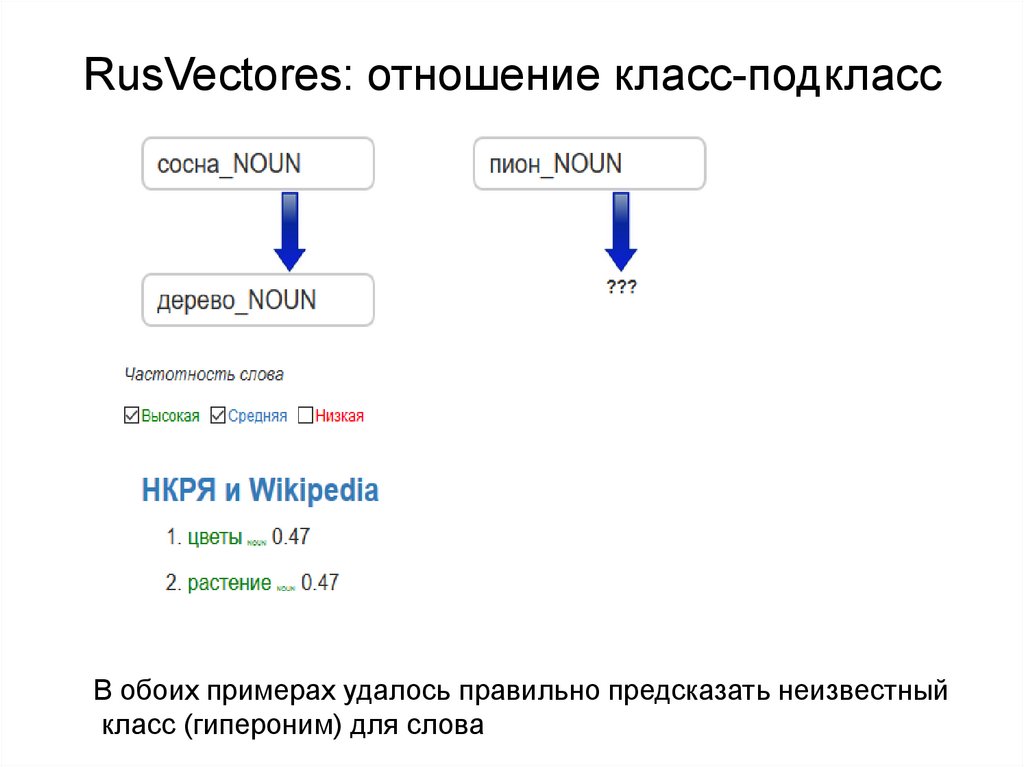

16. Можно ли это сделать для таксономических отношений? Пример: семантический калькулятор сайта rusvectores (отношение

экземпляр-класс)17. RusVectores: отношение класс-подкласс

В обоих примерах удалось правильно предсказать неизвестныйкласс (гипероним) для слова

18. Projection learning

• Но в работе (Fu et al., 2014) указывается, что в целом длятаксономических отношений не удается найти оптимального

линейного преобразования, поскольку такие преобразования

различаются для разных типов слов

• В примере ниже показано, что такие преобразования для рыб

и профессий различаются

19. Идея Projection Learning

• Нужно кластеризовать слова по их представления впространстве

• В каждом кластере обучить свое преобразование

вектора слова в вектор гиперонима

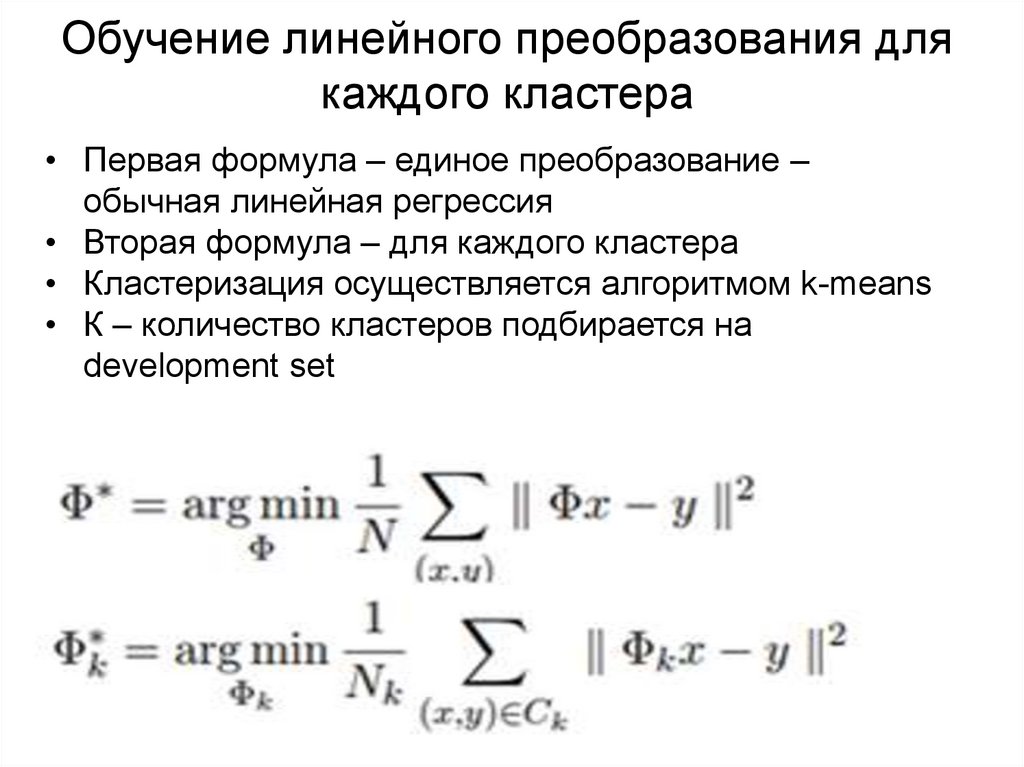

20. Обучение линейного преобразования для каждого кластера

• Первая формула – единое преобразование –обычная линейная регрессия

• Вторая формула – для каждого кластера

• Кластеризация осуществляется алгоритмом k-means

• К – количество кластеров подбирается на

development set

21. Projection learning. Тестирование для китайского языка. Данные

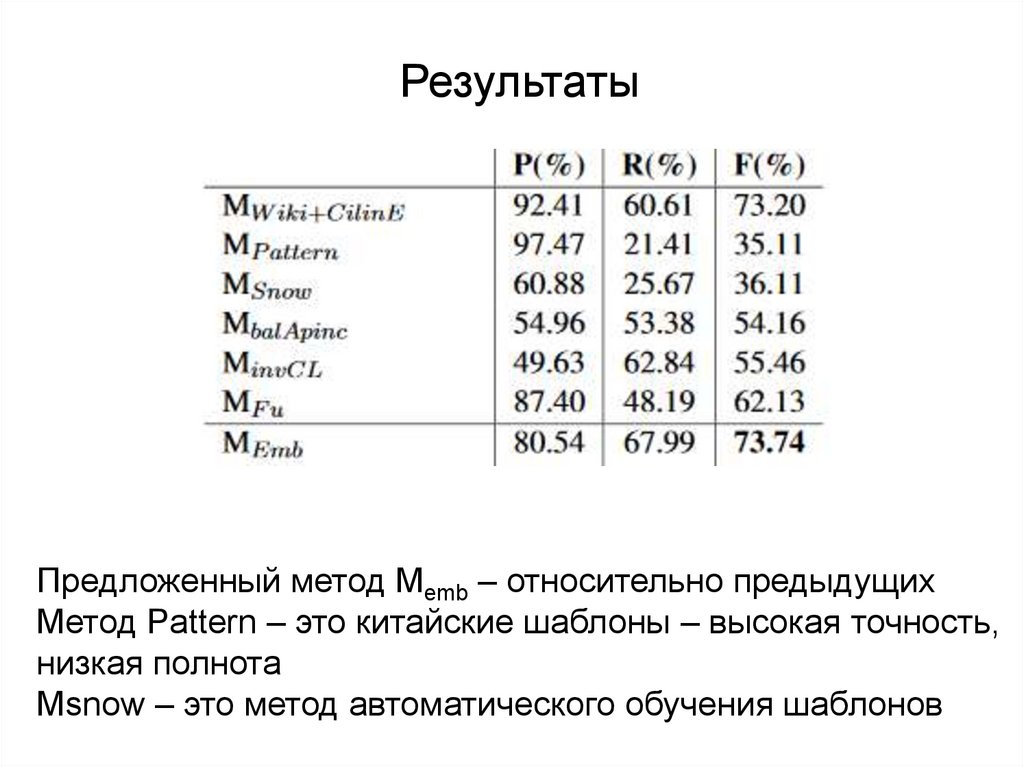

22. Результаты

Предложенный метод Memb – относительно предыдущихМетод Pattern – это китайские шаблоны – высокая точность,

низкая полнота

Msnow – это метод автоматического обучения шаблонов

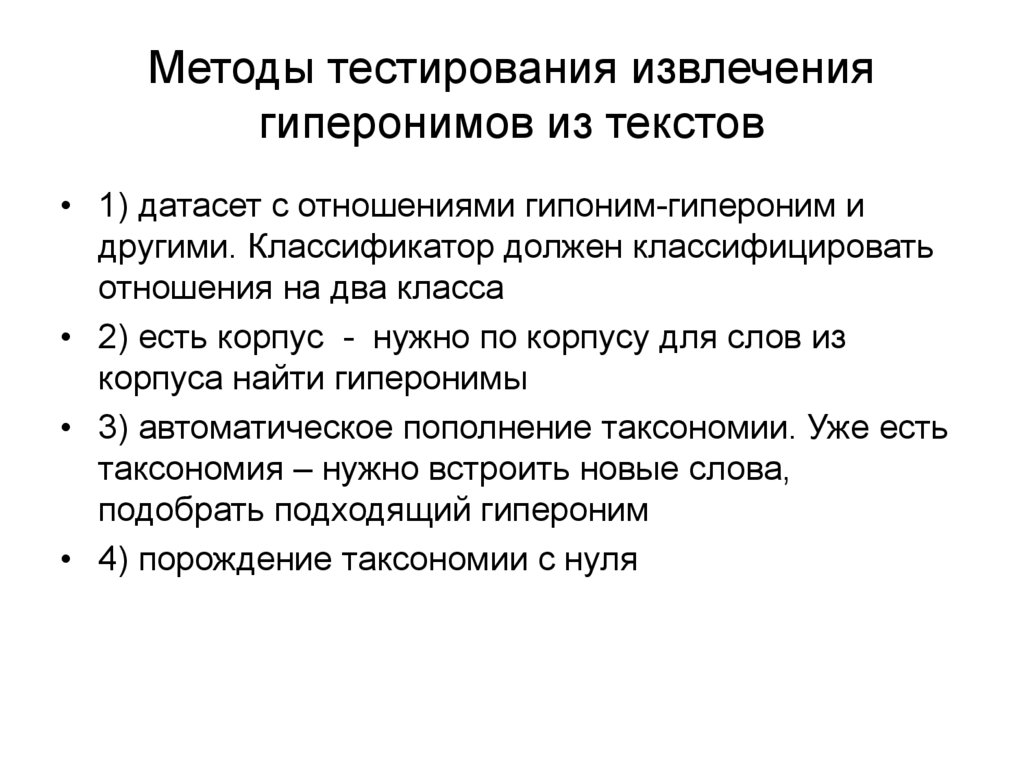

23. Методы тестирования извлечения гиперонимов из текстов

• 1) датасет с отношениями гипоним-гипероним идругими. Классификатор должен классифицировать

отношения на два класса

• 2) есть корпус - нужно по корпусу для слов из

корпуса найти гиперонимы

• 3) автоматическое пополнение таксономии. Уже есть

таксономия – нужно встроить новые слова,

подобрать подходящий гипероним

• 4) порождение таксономии с нуля

24. Подход к оценке N1. Наборы данных для оценки качества извлечения гиперонимов

• Наборы со сравнимыми объемами положительных иотрицательных примеров

• Меры: F-measure and Accuracy

• Но в реальности количество позитивных примеров

любого отношения значительно меньше, чем

отрицательных

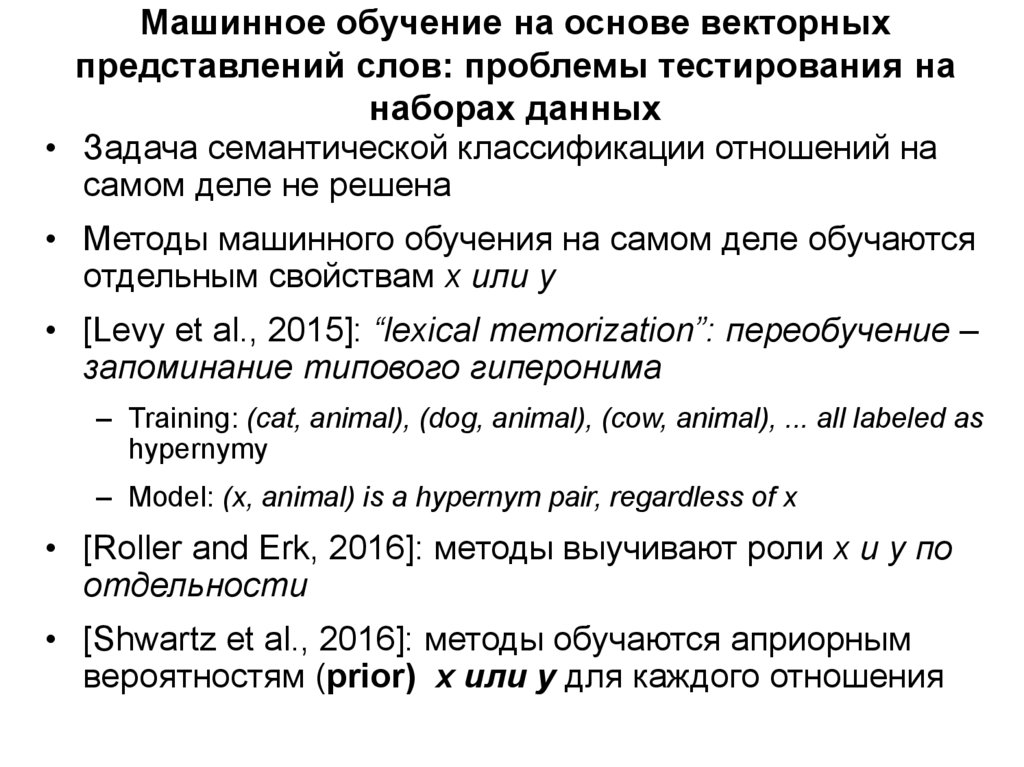

25. Машинное обучение на основе векторных представлений слов: проблемы тестирования на наборах данных

• Задача семантической классификации отношений насамом деле не решена

• Методы машинного обучения на самом деле обучаются

отдельным свойствам x или y

• [Levy et al., 2015]: “lexical memorization”: переобучение –

запоминание типового гиперонима

– Training: (cat, animal), (dog, animal), (cow, animal), ... all labeled as

hypernymy

– Model: (x, animal) is a hypernym pair, regardless of x

• [Roller and Erk, 2016]: методы выучивают роли x и y по

отдельности

• [Shwartz et al., 2016]: методы обучаются априорным

вероятностям (prior) x или y для каждого отношения

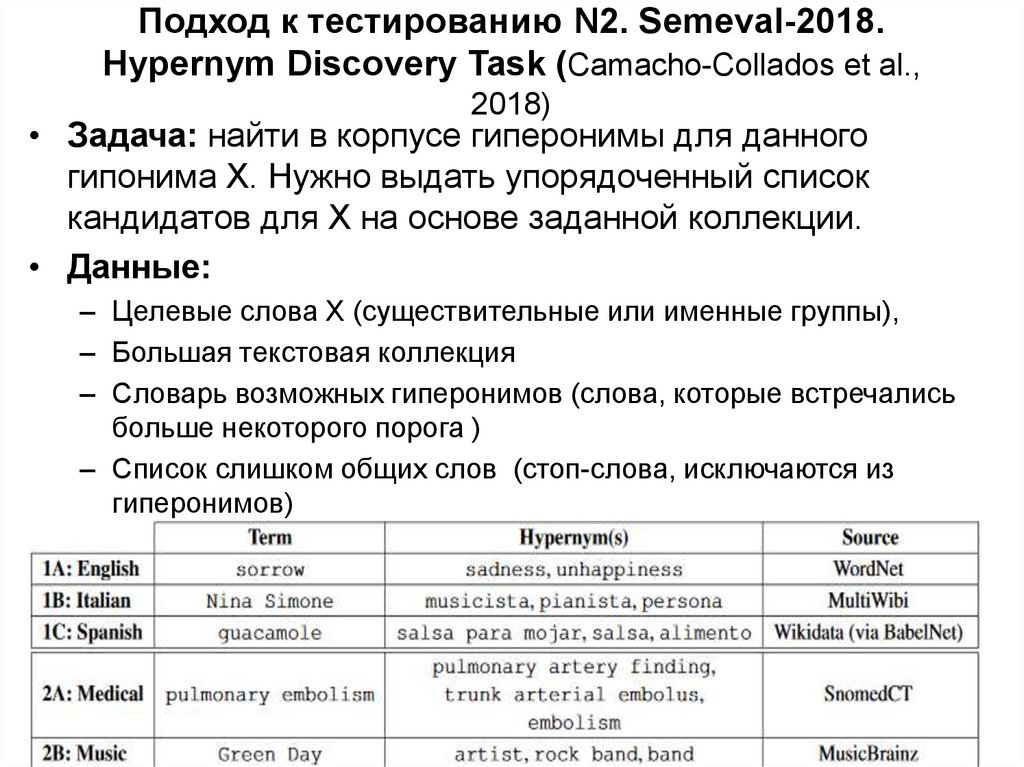

26. Подход к тестированию N2. Semeval-2018. Hypernym Discovery Task (Camacho-Collados et al., 2018)

• Задача: найти в корпусе гиперонимы для данногогипонима X. Нужно выдать упорядоченный список

кандидатов для Х на основе заданной коллекции.

• Данные:

– Целевые слова X (существительные или именные группы),

– Большая текстовая коллекция

– Словарь возможных гиперонимов (слова, которые встречались

больше некоторого порога )

– Список слишком общих слов (стоп-слова, исключаются из

гиперонимов)

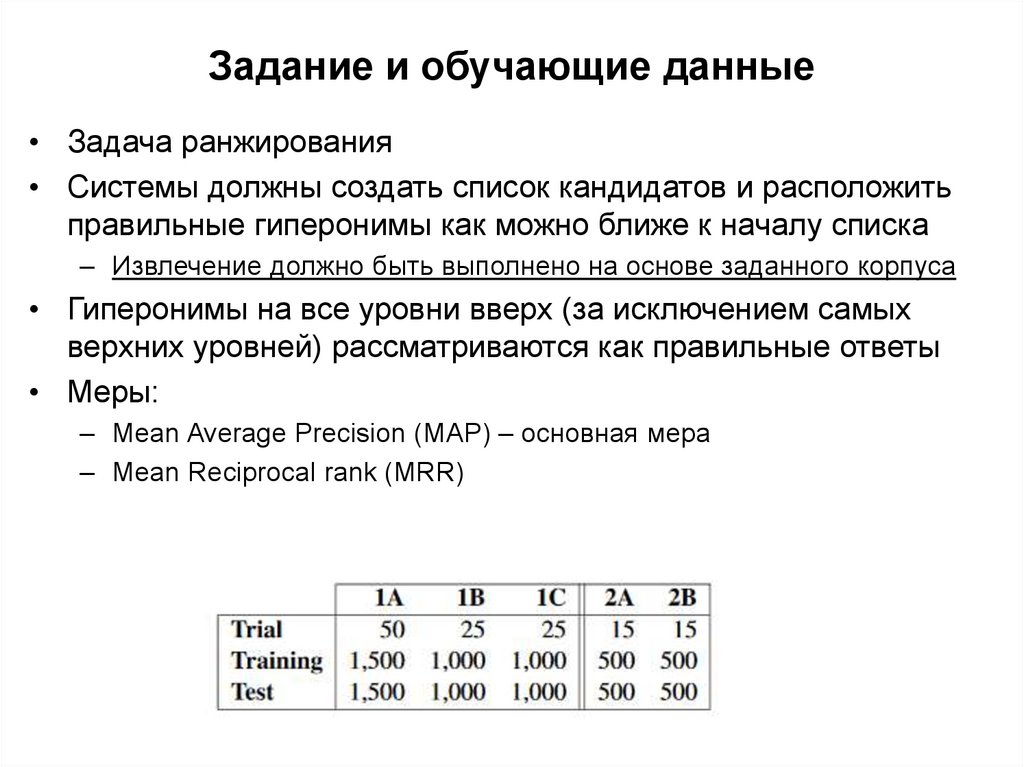

27. Задание и обучающие данные

• Задача ранжирования• Системы должны создать список кандидатов и расположить

правильные гиперонимы как можно ближе к началу списка

– Извлечение должно быть выполнено на основе заданного корпуса

• Гиперонимы на все уровни вверх (за исключением самых

верхних уровней) рассматриваются как правильные ответы

• Меры:

– Mean Average Precision (MAP) – основная мера

– Mean Reciprocal rank (MRR)

28.

Мера средней точности AP, вычисляемая для каждого слова датасета

является усреднением точностей в

момент выдачи правильных гиперонимов системой-участницей,

Достигает величины 1, когда все

правильные ответы располагаются

в начале списка

MMR – основана на вычислении

обратной величины номера позиции

первого правильного ответа.

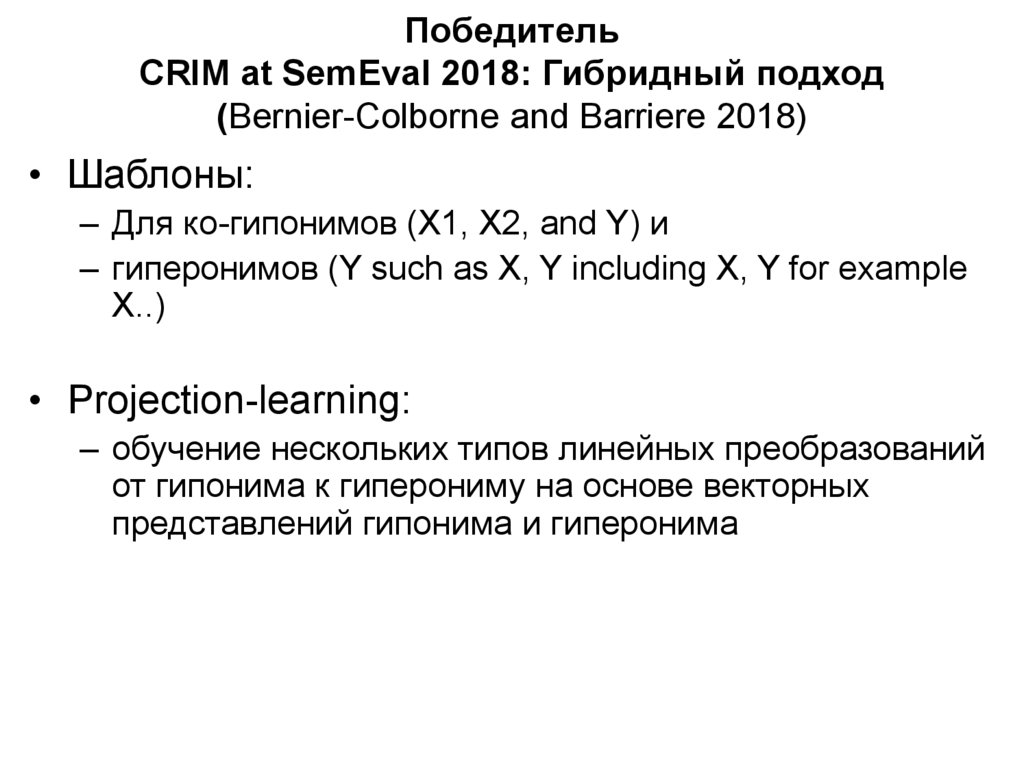

29. Победитель CRIM at SemEval 2018: Гибридный подход (Bernier-Colborne and Barriere 2018)

• Шаблоны:– Для ко-гипонимов (X1, X2, and Y) и

– гиперонимов (Y such as X, Y including X, Y for example

X..)

• Projection-learning:

– обучение нескольких типов линейных преобразований

от гипонима к гиперониму на основе векторных

представлений гипонима и гиперонима

30.

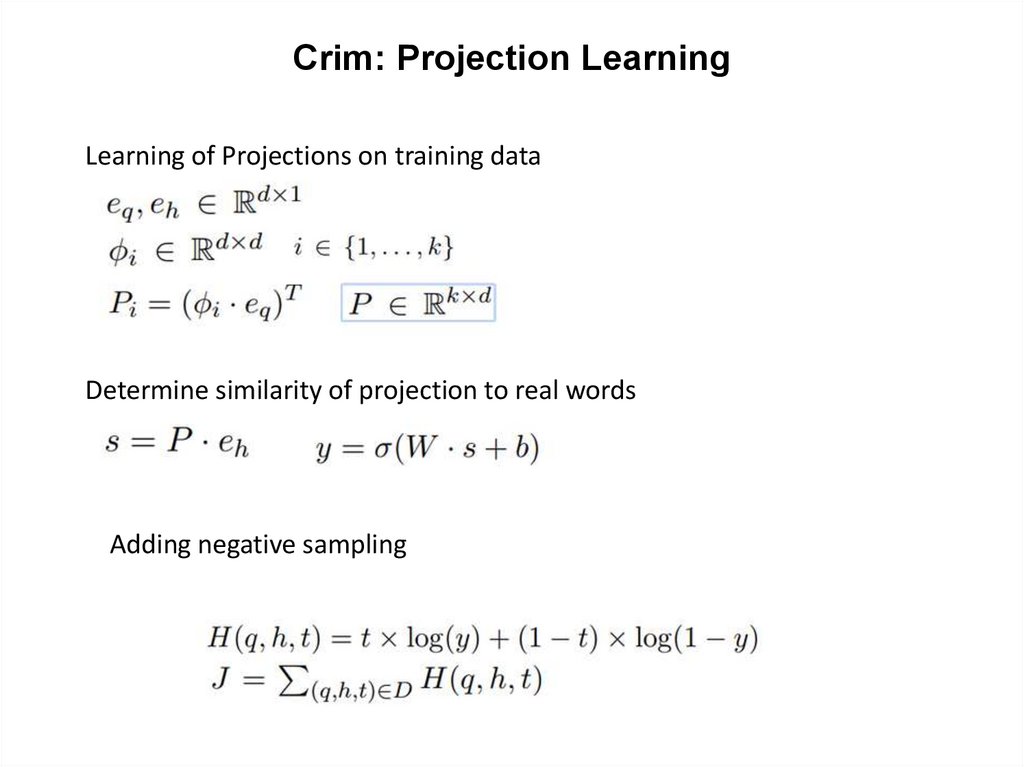

31. Crim: Projection Learning

Learning of Projections on training dataDetermine similarity of projection to real words

Adding negative sampling

32. Результаты Semeval-2018

• MRR – Mean Reciprocal Rank основан на подсчете позициив ранжированном списке первого правильного ответа

Т.е. в среднем система выдает правильный гипероним

на третьем месте

33. Выводы по тестированию SemEval-2018

• Результаты предсказания гиперонимов очень низкиев общей области

• Система, которая предсказывает правильные ответы

как один из трех, не может автоматически породить

ресурс ручного качества

• Результат существенно выше в конкретных областях,

но там были какие-то особенности формирования

данных

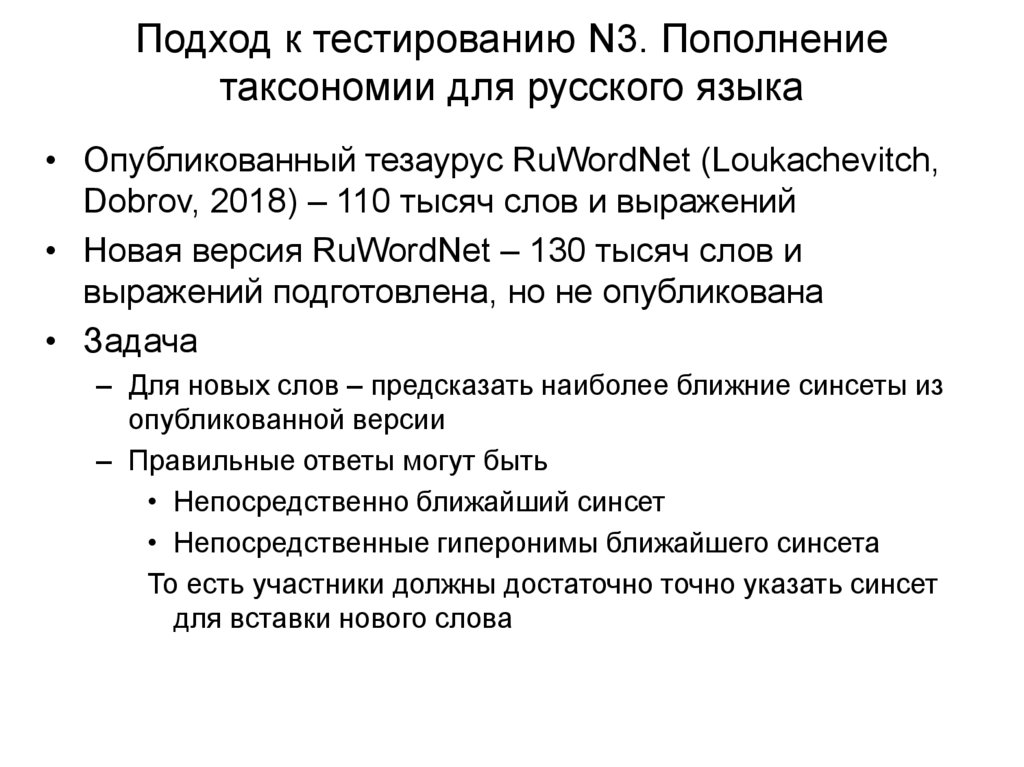

34. Подход к тестированию N3. Пополнение таксономии для русского языка

• Опубликованный тезаурус RuWordNet (Loukachevitch,Dobrov, 2018) – 110 тысяч слов и выражений

• Новая версия RuWordNet – 130 тысяч слов и

выражений подготовлена, но не опубликована

• Задача

– Для новых слов – предсказать наиболее ближние синсеты из

опубликованной версии

– Правильные ответы могут быть

• Непосредственно ближайший синсет

• Непосредственные гиперонимы ближайшего синсета

То есть участники должны достаточно точно указать синсет

для вставки нового слова

35. Примеры слов для пополнения

абдоминопластика

абсентеизм

абсолютизация

абсорбент

абстракционизм

абстракционист

аваль

аванзал

аварийщик

автаркия

авуары

агитпункт

агностик

адвентист

адгезия

аджика

адсорбент

адъюнкт

адъюнктура

азовка

азу

айпад

айран

абсолютизировать

адсорбировать

акать

активировать

актировать

алеть

американизировать

аннигилировать

аннотировать

анодировать

аукаться

бередить

бинтовать

бичевать

блокироваться

бодриться

бряцать

булькать

буреть

бутилировать

вальсировать

вбухивать

36.

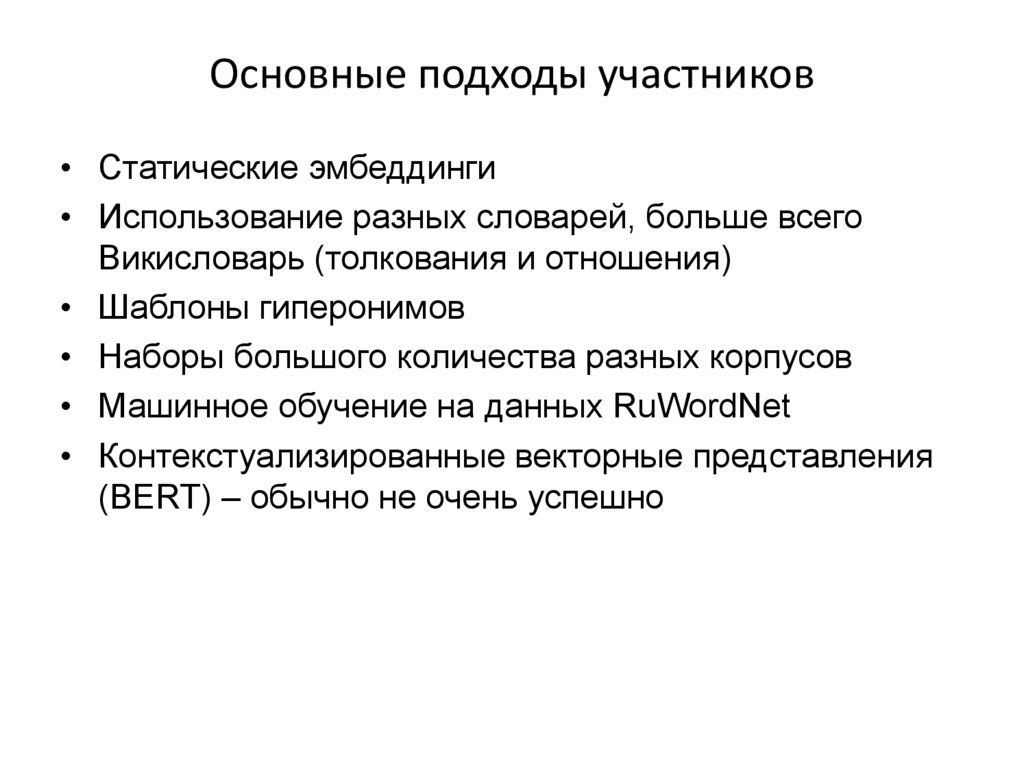

37. Основные подходы участников

• Статические эмбеддинги• Использование разных словарей, больше всего

Викисловарь (толкования и отношения)

• Шаблоны гиперонимов

• Наборы большого количества разных корпусов

• Машинное обучение на данных RuWordNet

• Контекстуализированные векторные представления

(BERT) – обычно не очень успешно

38. Результаты: предсказание гиперонимов существительных

39. Обсуждение

Result (noun concepts)MAP

MRR

SemEval2018-Best

0.16

0.30

SemEval2018-baseline

0.017

0.037

Russe2020-Best

0.55

0.59

Russe2020-Restricted

corpus

0.49

0.53

Russe2020-Baseline

0.42

0.45

• Более низкие результаты на SemEval-2018

– Ограниченный корпус,

– Нужно извлечь отношения с нуля

• Большее различие между метриками MAP и MRR на

SemEval-2018

– На Semeval-2018 нужно было предсказать гиперонимы

на все уровни

40. Новые подходы на основе порождения языковыми моделями в ответ на специально сформулированный вопрос

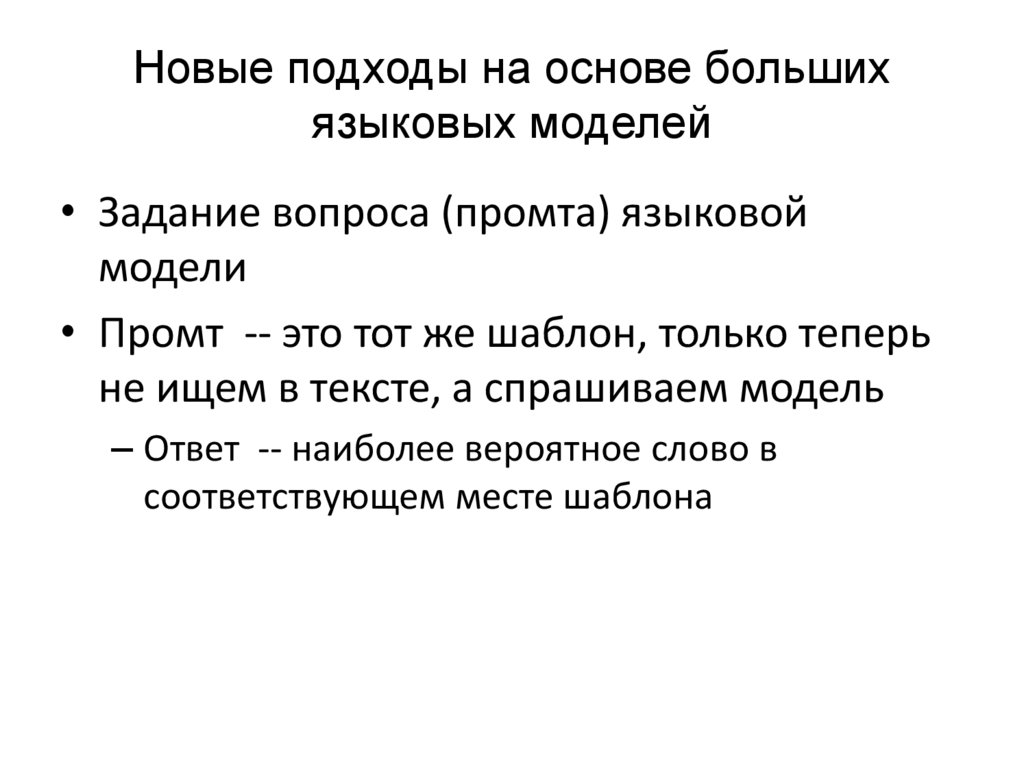

41. Новые подходы на основе больших языковых моделей

• Задание вопроса (промта) языковоймодели

• Промт -- это тот же шаблон, только теперь

не ищем в тексте, а спрашиваем модель

– Ответ -- наиболее вероятное слово в

соответствующем месте шаблона

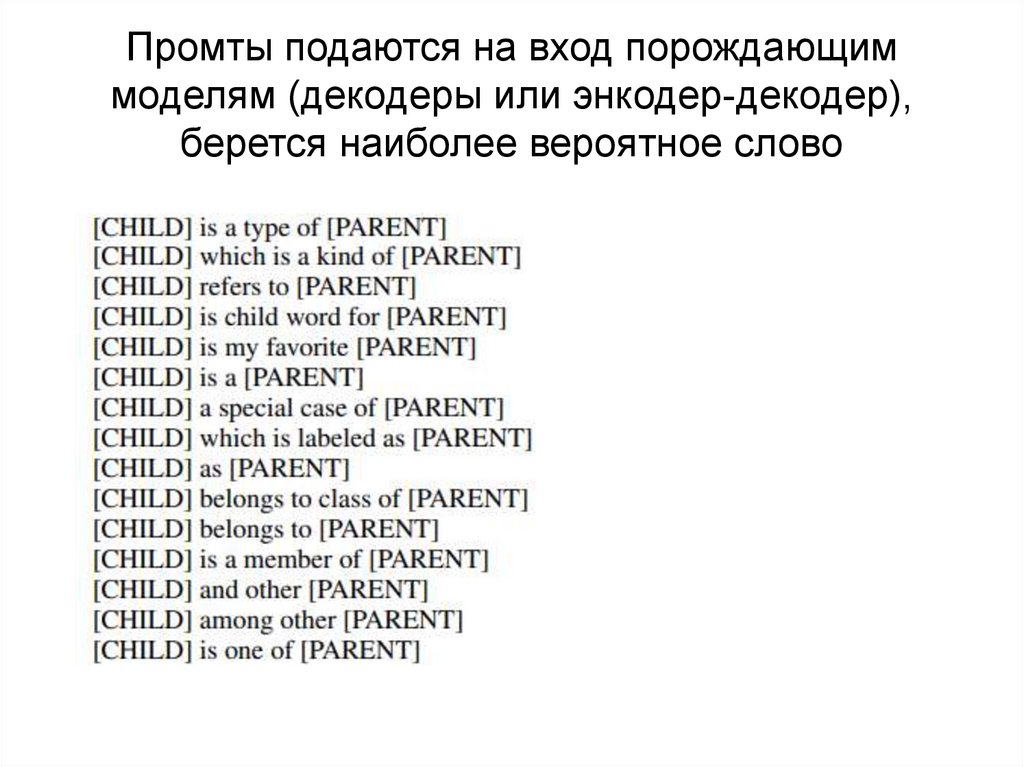

42. Промты подаются на вход порождающим моделям (декодеры или энкодер-декодер), берется наиболее вероятное слово

43. Новые подходы на основе порождения языковыми моделями в ответ на специально сформулированный вопрос: система TaxoPrompt

44. Заключение

• Возможности современных систем автоматическивоспроизводить ресурсы ручного качества,

определять наличие конкретного отношения пока

ограничены

• Можно рассмотреть задачи для автоматизации

ведения и пополнения существующих лексикосемантических ресурсов

• Важно уметь настраивать существующие лексикосемантические ресурсы на конкретные предметные

области

– Находить нерелевантные отношения или новые значения

– Это позволит более эффективно использовать существующие

лексические ресурсы

45. Задание

• На сервисе RusVectores посмотрите, какиеслова чаще всего предсказываются как

ближайшие к исходному слову (посмотрите

5 существительных) – синонимы, антонимы,

гипонимы, гиперонимы, ко-гипонимы.

• https://rusvectores.org/ru/associates/

• Пришлите отчет

informatics

informatics