Similar presentations:

Тема 1. Информатика и информация. Основные понятия и определения

1. Литература

1.2.

3.

4.

5.

6.

Информатика: учебник /под ред. В.В. Трофимовой. – М.:

Юрайт, 2012.

Информатика: учебник /под ред. Н.В. Макаровой. – М.:

Финансы и статистика, 2001.

Практикум по информатике: учебн. пособ. /под ред. Е.К.

Хенера. – М.: «Академия», 2009.

Н.И. Савицкий Экономическая информатика / учебн. пособие

– М.: Экономистъ, 2004.

Информатика и информационные технологии: учебн. пособие

/ под ред. Ю.Д.Романовой. – М.:Эксмо, 2010.

Шапорев С.Д. Информатика. Теоретический курс и

практические занятия. СПб.: БХВ Петербург, 2008.

Поллак Галина Андреевна, к.т.н., доцент каф.

«Информационные технологии в экономике»

«Высшая школа экономики и управления»

«Южно-Уральский государственный университет»

(национальный исследовательский университет)

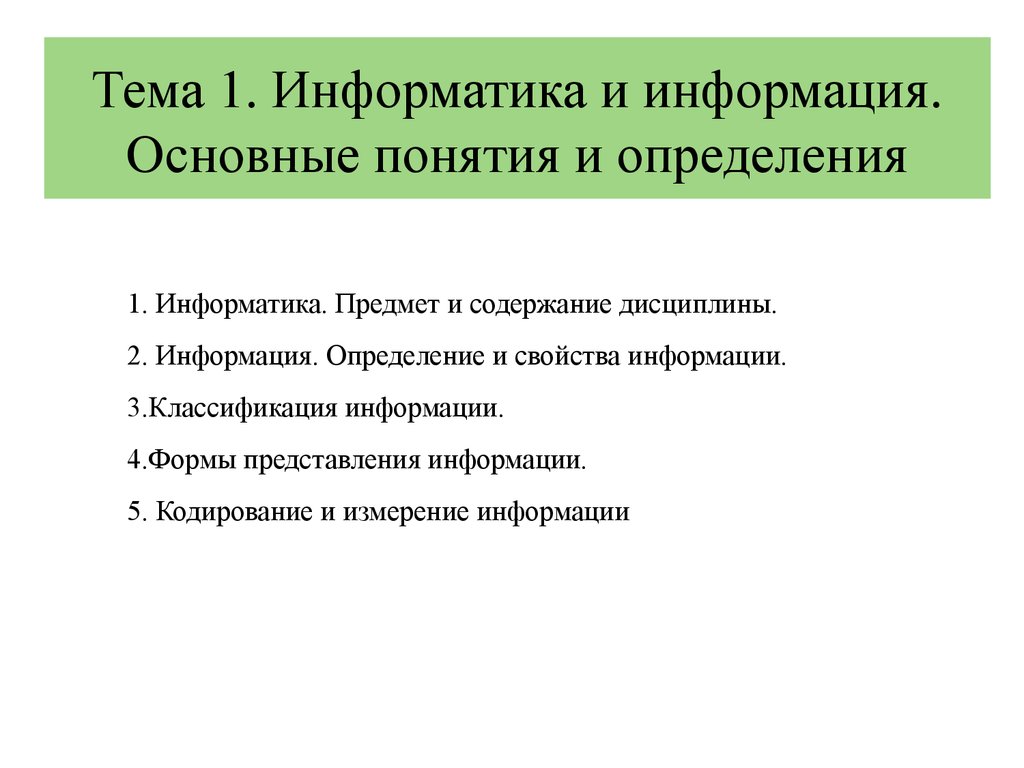

2. Тема 1. Информатика и информация. Основные понятия и определения

1. Информатика. Предмет и содержание дисциплины.2. Информация. Определение и свойства информации.

3.Классификация информации.

4.Формы представления информации.

5. Кодирование и измерение информации

3.

4. 1. Информатика. Предмет и содержание дисциплины

Термин “informatique” введен в конце 60-х г. 20 века во Франции.В США термин “computer science” – преобразование

информации в вычислительной технике.

В СССР термин «информатика» официально закреплен в 1983 г.

Информатика в широком смысле – наука об информации,

способах ее сбора, хранения, обработки и представления с

помощью электронных средств.

Главная функция информатики – разработка методов и средств

преобразования информации и их использование в

организации технологического процесса переработки

информации.

5.

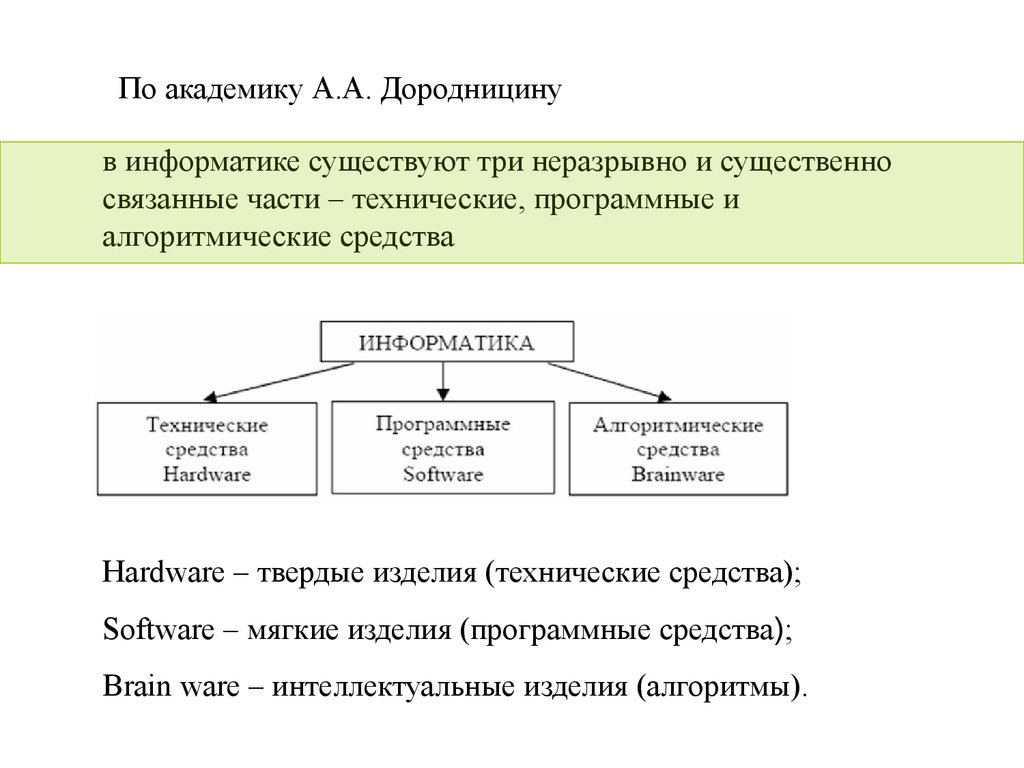

По академику А.А. Дородницинув информатике существуют три неразрывно и существенно

связанные части – технические, программные и

алгоритмические средства

Hardware – твердые изделия (технические средства);

Software – мягкие изделия (программные средства);

Brain ware – интеллектуальные изделия (алгоритмы).

6.

Предметом изученияинформатики являются:

1. Информационные системы,

2.Модели, языки их описания,

3.Технологии их

использования.

Информатику можно

рассматривать с трех позиций:

1.как отрасль народного

хозяйства,

2.как фундаментальную науку,

3.как прикладную дисциплину.

Отрасль

народного

хозяйства

Фундаментальная наука

Прикладная

дисциплина

1.Производство

технических

средств

1.Методология

создания

информационно

го обеспечения.

Изучение закономерностей в

информационных процессах.

2.Производство

программных

продуктов

2.Теория

2.Создание

информационинформационных систем и ных моделей.

технологий.

3.Разработка

технологий

переработки

информации.

3.Разработка

информационных систем и

технологий.

7.

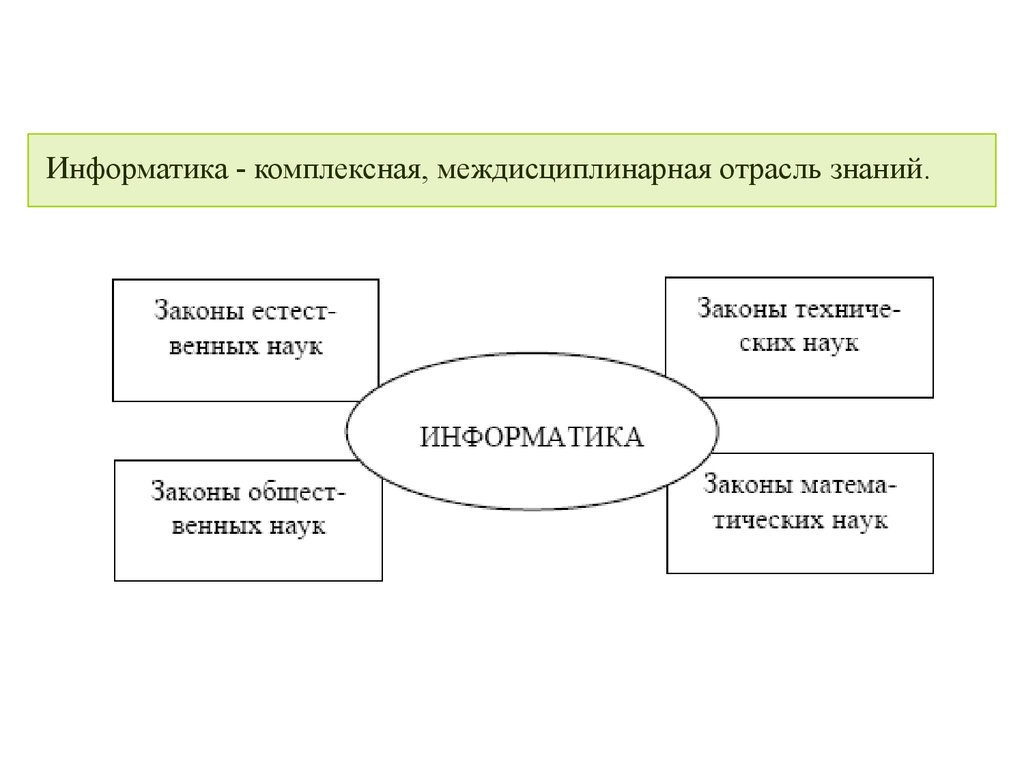

Информатика - комплексная, междисциплинарная отрасль знаний.8.

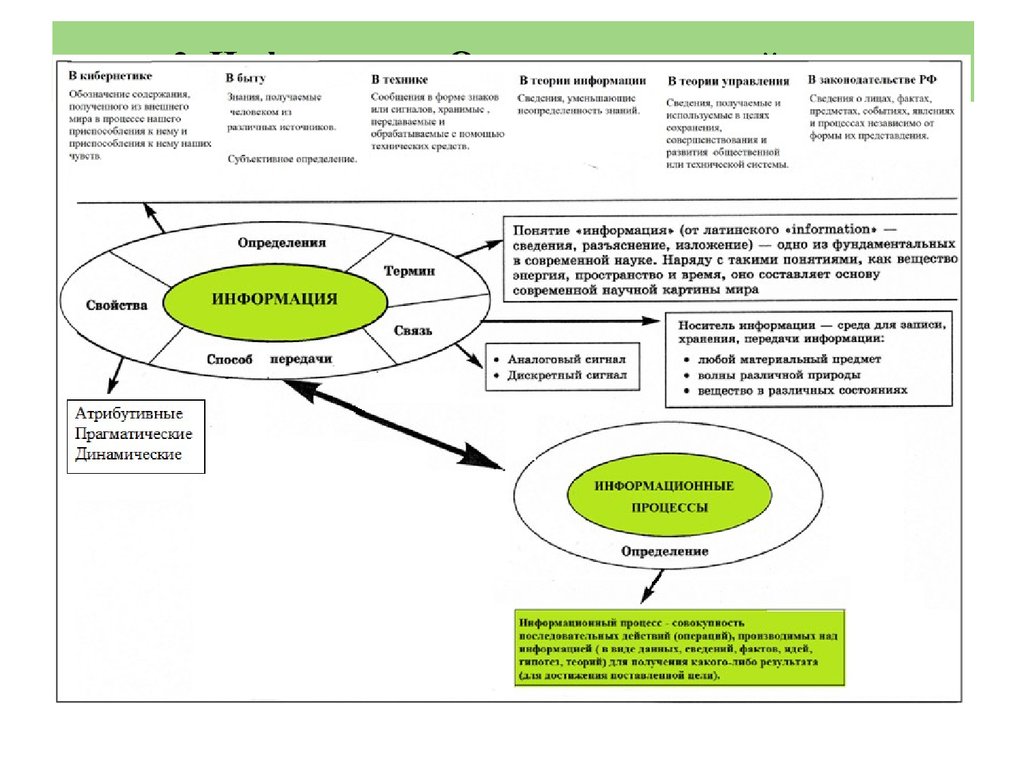

2. Информация. Определение и свойства9.

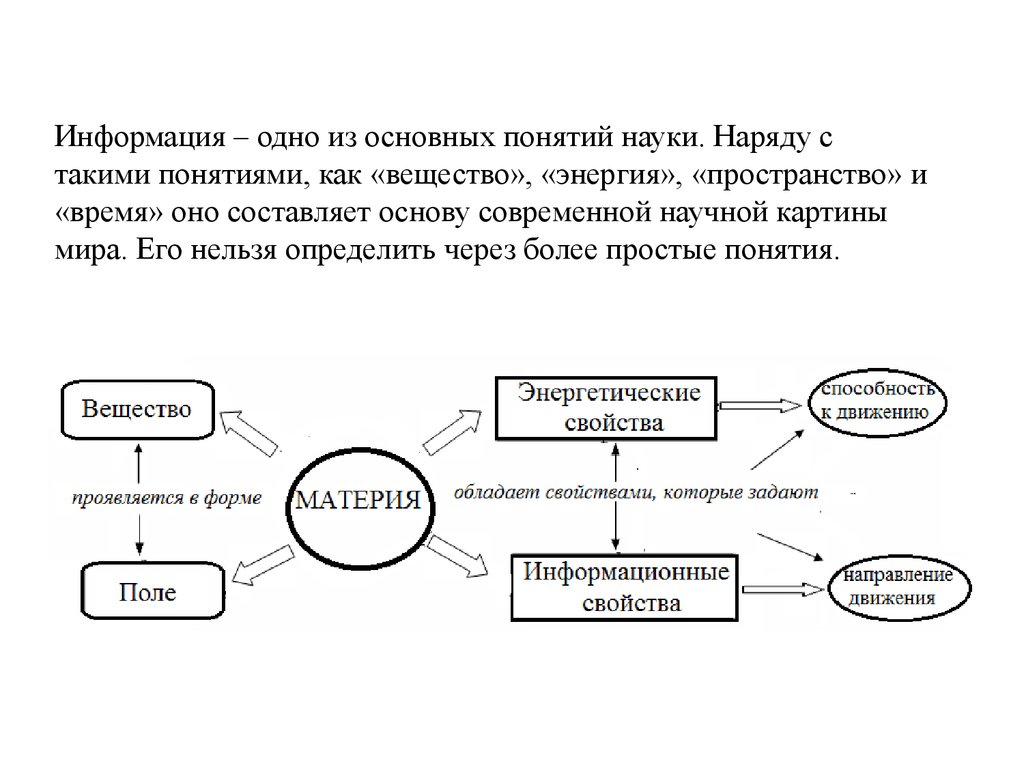

Информация – одно из основных понятий науки. Наряду стакими понятиями, как «вещество», «энергия», «пространство» и

«время» оно составляет основу современной научной картины

мира. Его нельзя определить через более простые понятия.

10.

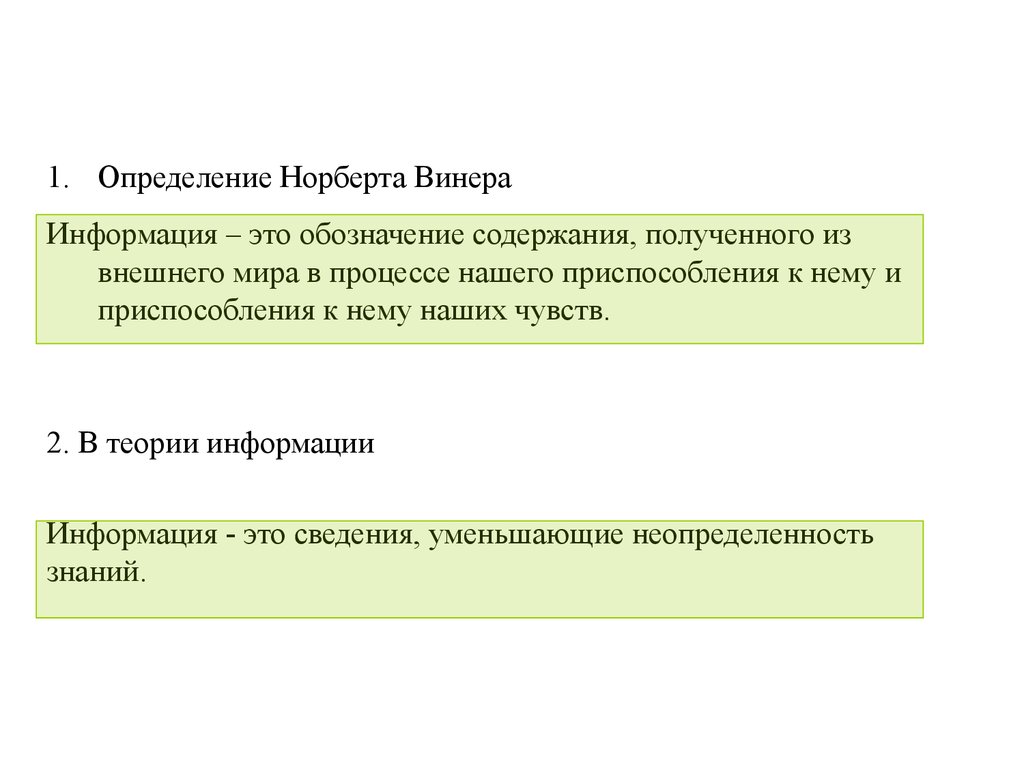

1. Определение Норберта ВинераИнформация – это обозначение содержания, полученного из

внешнего мира в процессе нашего приспособления к нему и

приспособления к нему наших чувств.

2. В теории информации

Информация - это сведения, уменьшающие неопределенность

знаний.

11.

3. В теории управленияИнформация - сведения, получаемые и используемые в целях

сохранения, совершенствования и развития общественной или

технической системы.

4. В кибернетике

Информация - содержание передаваемых сигналов.

5. Формальное определение информации, данное в российском

законодательстве:

Информация – это сведения о лицах, предметах, фактах, событиях,

явлениях и процессах независимо от формы их представления.

12.

6. Для человека (субъективный подход)Информация – это знания, которые он получает из различных

источников.

Виды знаний

1. Декларативные (факты) .

2. Процедурные (правила).

Декларативные – знания об определенных явлениях,

событиях, свойствах объектов( «Я знаю, что…»).

Процедурные – знания о действиях, которые нужно

предпринять для достижения какой-либо цели ( «Я знаю,

как…»).

13.

Обобщая,Информация – содержание сообщения, а сообщение –

это форма информации.

Информация существует в трех видах: в виде данных,

собственно информации и знаний.

Данные – фиксированные сведения о событиях или

явлениях.

Информация – это обработанные данные,

представленные в виде, пригодном для принятия решений

получателем.

Знания – это обработанная информация, использованная

и используемая для принятия решения и решения задач.

14.

Обобщая,Информация – содержание сообщения, а сообщение –

это форма информации.

Информация существует в трех видах: в виде данных,

собственно информации и знаний.

Данные – фиксированные сведения о событиях или

явлениях.

Информация – это обработанные данные,

представленные в виде, пригодном для принятия решений

получателем.

Знания – это обработанная информация, использованная

и используемая для принятия решения и решения задач.

15.

Взаимосвязь данных, информации и знаний16.

У информации различают атрибутивные, прагматическиеи динамические свойства.

Атрибутивные свойства – это те свойства, без которых

информация не существует:

•непрерывность;

• дискретность;

• наличие физического носителя информации;

• языковая природа информации.

17.

Прагматические свойства характеризуют степеньполезности информации для потребителя и

проявляются в процессе использования информации:

• смысл и новизна;

• полезность (содержит минимальный, но достаточный для

принятия правильного решения состав);

• полнота (исчерпывающе характеризует отображаемый

объект или процесс);

• достоверность (не имеет скрытых ошибок);

• адекватность (уровень соответствия образа, получаемого с

помощью информации, реальному объекту);

• доступность;

• актуальность (степень сохранения ценности информации для

управления в момент ее использования);

• объективность и субъективность.

18.

Динамические свойства информации характеризуютизменение информации во времени:

• рост информации;

• старение.

19. Методы получения информации

Методыполученияинформации

информации

3. Классификация

20.

По способу кодирования сигнала – аналоговая и цифроваяинформация.

Аналоговый сигнал информацию о величине исходного

параметра, о котором сообщается в информации, представляет

в виде величины другого параметра, являющегося физической

основой сигнала, его физическим носителем.

Цифровой сигнал использует в качестве физической

основы для записи и передачи информации только

минимальное число таких значений, Чаще всего два.

21.

По общественному назначению – личная, массовая испециальная.

Личная содержит данные о владельце.

Массовая подразделяется в свою очередь на общественнополитическую, обыденную и научно-популярную.

Специальная подразделяется на производственную, техническую,

управленческую и научную.

• Производственная содержит сведения о производственных

процессах, персонале, финансах предприятия и т.д.

• Техническая имеет следующие градации: станкостроительная,

машиностроительная, инструментальная и т.д.

• Управленческая содержит данные, необходимые для управления

предприятием и принятия управленческих решений.

• Научная информация подразделяется по отраслям науки.

22.

По сфере возникновения:• элементарная – информация в неживой природе;

• биологическая – информация в мире животных и растений

• социальная – в человеческом обществе.

По способу передачи и восприятия:

• визуальная,

• аудиальная,

• тактильная,

• вкусовая,

• машинно-ориентированная.

23.

4. Формы представления информацииМатериальный носитель информации – это

материальный объект или среда, которые служат для

представления и передачи информации.

Хранение информации связано с характеристикой носителя,

которая не меняется с течением времени.

Передача информации – с характеристикой, которая

изменяется с течением времени.

24.

СигналИзменение характеристики носителя, используемое для

представления информации, называется сигналом.

Значение этой характеристики, отнесенное к некоторой шкале

измерения, – параметр сигнала.

Различают аналоговые, дискретные, квантованные и цифровые

сигналы, которые в свою очередь могут быть синхронными и

асинхронными.

25.

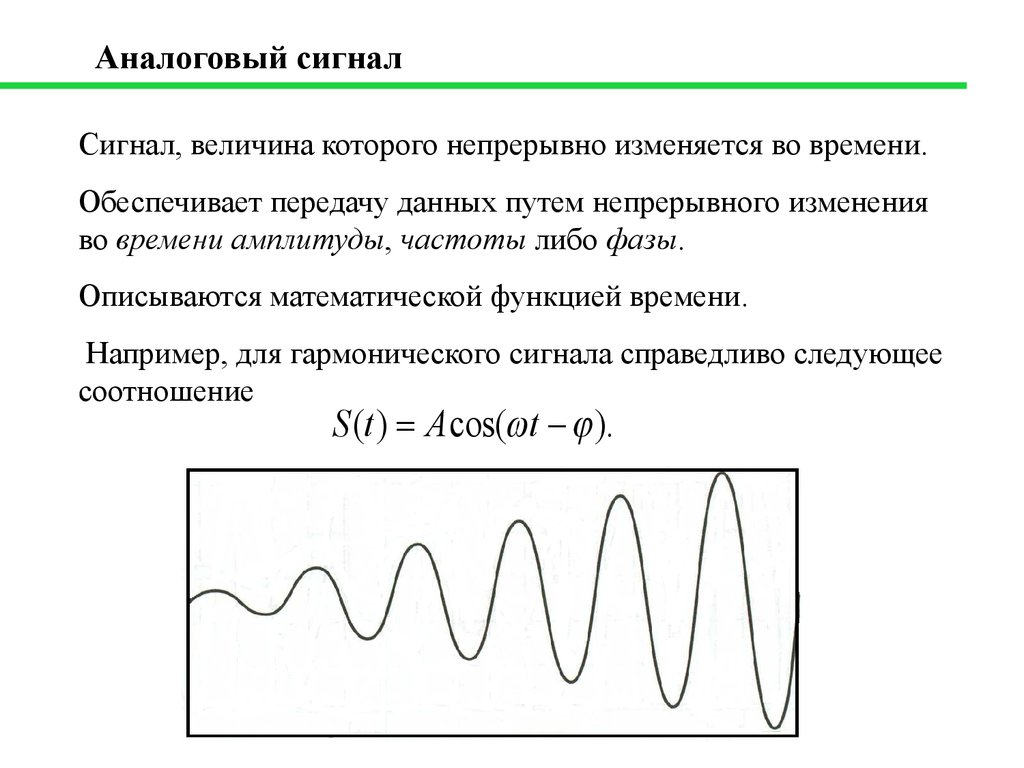

Аналоговый сигналСигнал, величина которого непрерывно изменяется во времени.

Обеспечивает передачу данных путем непрерывного изменения

во времени амплитуды, частоты либо фазы.

Описываются математической функцией времени.

Например, для гармонического сигнала справедливо следующее

соотношение

S (t ) A cos( t ).

26.

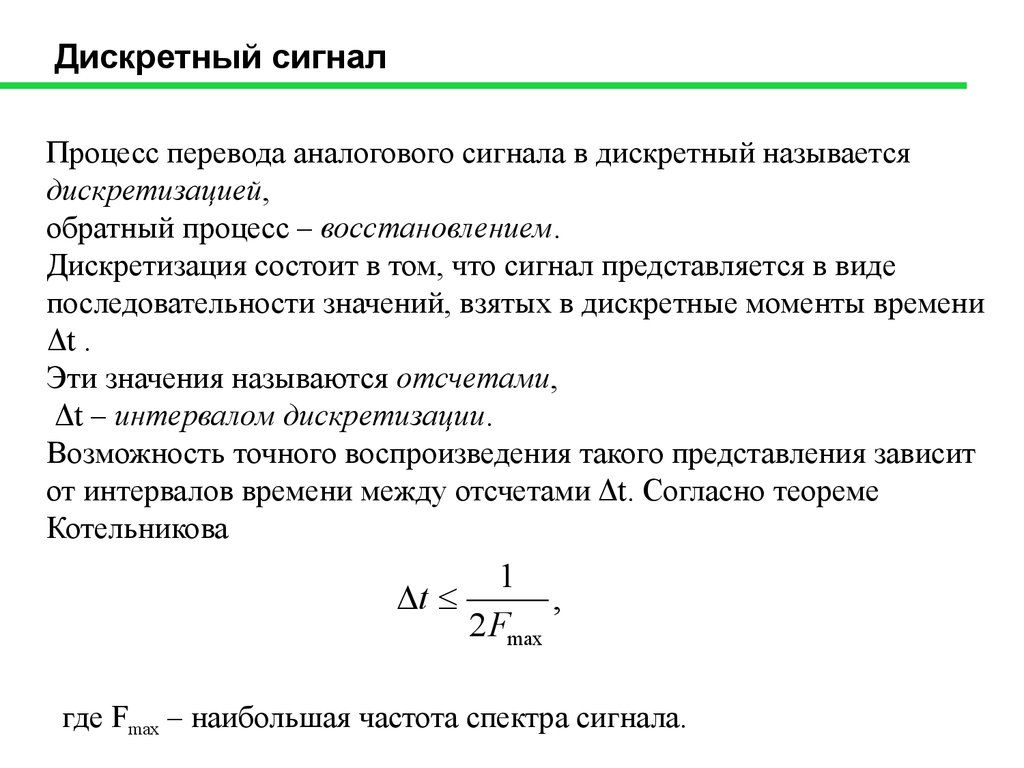

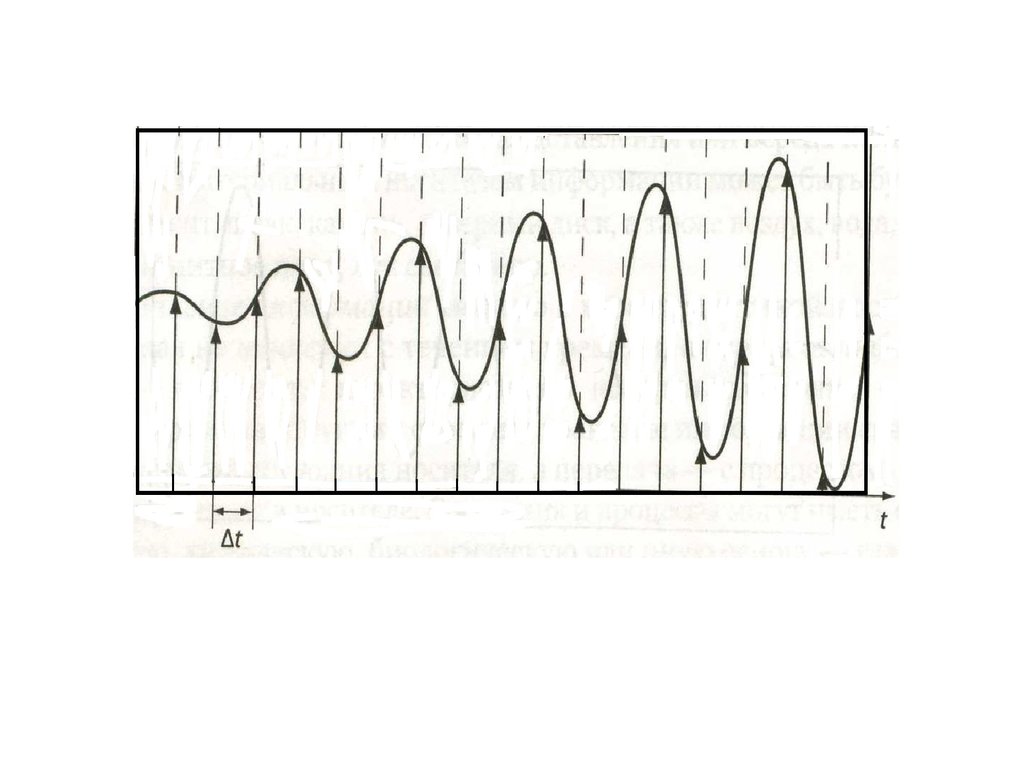

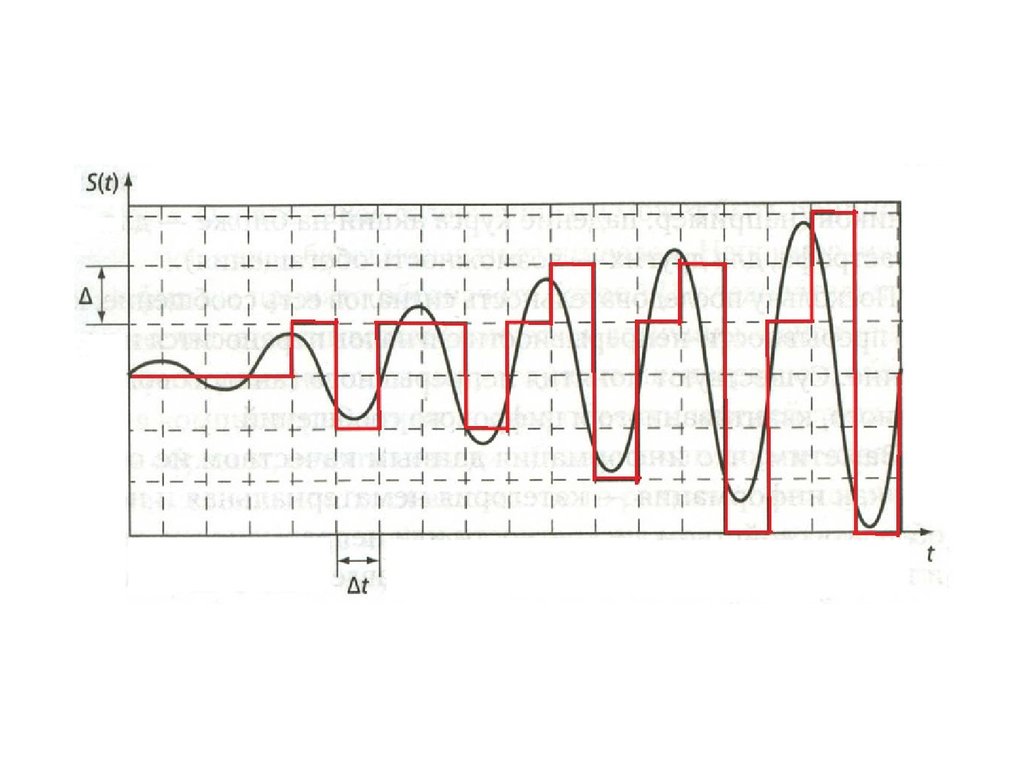

Дискретный сигналПроцесс перевода аналогового сигнала в дискретный называется

дискретизацией,

обратный процесс – восстановлением.

Дискретизация состоит в том, что сигнал представляется в виде

последовательности значений, взятых в дискретные моменты времени

Δt .

Эти значения называются отсчетами,

Δt – интервалом дискретизации.

Возможность точного воспроизведения такого представления зависит

от интервалов времени между отсчетами Δt. Согласно теореме

Котельникова

1

t

,

2 Fmax

где Fmax – наибольшая частота спектра сигнала.

27.

28.

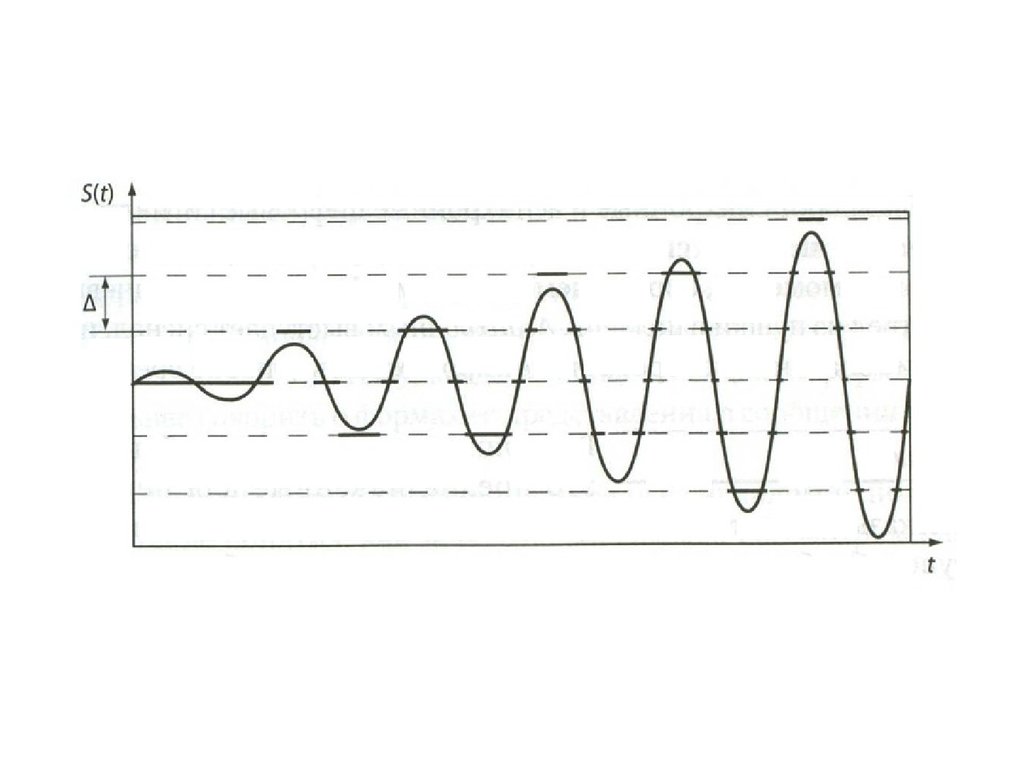

Квантованный сигнал.Вся область значений сигнала разбивается на уровни. Расстояния

между уровнями называется шагом квантования Δ. Число этих

уровней равно N ( от 0 до N–1). Каждому уровню присваивается

некоторое число.

Отсчеты сигнала сравнивается с уровнями квантования, и в

качестве сигнала выбирается число, соответствующее

некоторому уровню квантования. Каждый уровень квантования

кодируется двоичным числом с n разрядами. Число уровней

квантования N и число разрядов n двоичных чисел, кодирующих

эти уровни, связаны соотношением n ≥ log2(N).

29.

30.

Цифровой сигнал.Для превращения аналогового сигнала в цифровой он сначала

превращается в дискретный, а затем квантуется.

В результате на каждом заданном промежутке времени известно

приближенное (квантованное) значение сигнала, которое

записывается целым числом.

Целые числа записываются в двоичной системе.

Полученные значения будут являться цифровым сигналом.

31.

32.

СообщенияПоследовательность сигналов называется сообщением.

Сообщение является переносчиком информации, а

информация является содержанием сообщения.

Соответствие между сообщением и содержащейся в нем

информацией называется правилом интерпретации

сообщения.

Это соответствие может быть однозначным и

неоднозначным.

33.

Знак – это элемент некоторого конечного множества отличных другот друга сущностей.

Множество знаков, представляющих дискретную информацию,

называется набором знаков.

Набор знаков, в котором установлен порядок их следования,

называется алфавитом.

Знаки, используемые для обозначения фонем человеческого языка,

называются буквами, а их совокупность – алфавитом языка.

Сами по себе знак или буква не несут никакого смыслового

содержания.

Знак называется символом, если ему приписано содержание.

Таким образом, понятия «знак», «буква» и «символ» нельзя

считать тождественными, хотя часто различия между ними не

проводят.

34.

ДанныеДанные – сведения, полученные путем измерения, наблюдения,

логических или арифметических операций и представленные в

форме, пригодной для постоянного хранения, передачи и обработки.

В процессах сбора, обработки и использования данные

расчленяются на отдельные элементарные составляющие –

элементарные данные. Они могут быть выражены целыми и

вещественными числами, словами, а также булевыми величинами,

принимающими значения «истина» или «ложь».

35.

Данные хранятся в базе данных.База данных (БД) – совокупность хранимых в памяти

компьютера данных, относящихся к определенному

объему или кругу деятельности, специально

организованных, обновляемых и логически связанных

между собой.

Они представляют собой информационную модель

объекта.

36.

ЗнанияЗнания – вид информации, отражающий опыт специалиста в

определенной предметной области, его понимание множества

текущих ситуаций и способы перехода от одного описания

объекта к другому. Для знаний характерна внутренняя

интерпретируемость, структурированность, связанность и

взаимная активность.

Декларативные знания представляют информацию о свойствах

и фактах предметной области.

Процедурные знания используются для представления

информации о способах решения задач в проблемной области,

а также формирования различных инструкций, методик и т.п.

37.

Эвристические знания накапливаютсяинтеллектуальной системой в процессе ее

функционирования, а также закладываются в ней

априорно, но не имеют статуса абсолютной

истинности в данной проблемной области. Обычно

эвристические знания отражают неформальный

опыт решения задач.

Экспертными знаниями располагает специалист в

некоторой предметной области.

38.

Знания хранятся в базе знаний.База знаний – семантическая модель, описывающая

предметную область. Содержит формальное описание

знаний экспертов, представленное в виде набора фактов и

правил. Является основным компонентом экспертных и

интеллектуальных систем.

39.

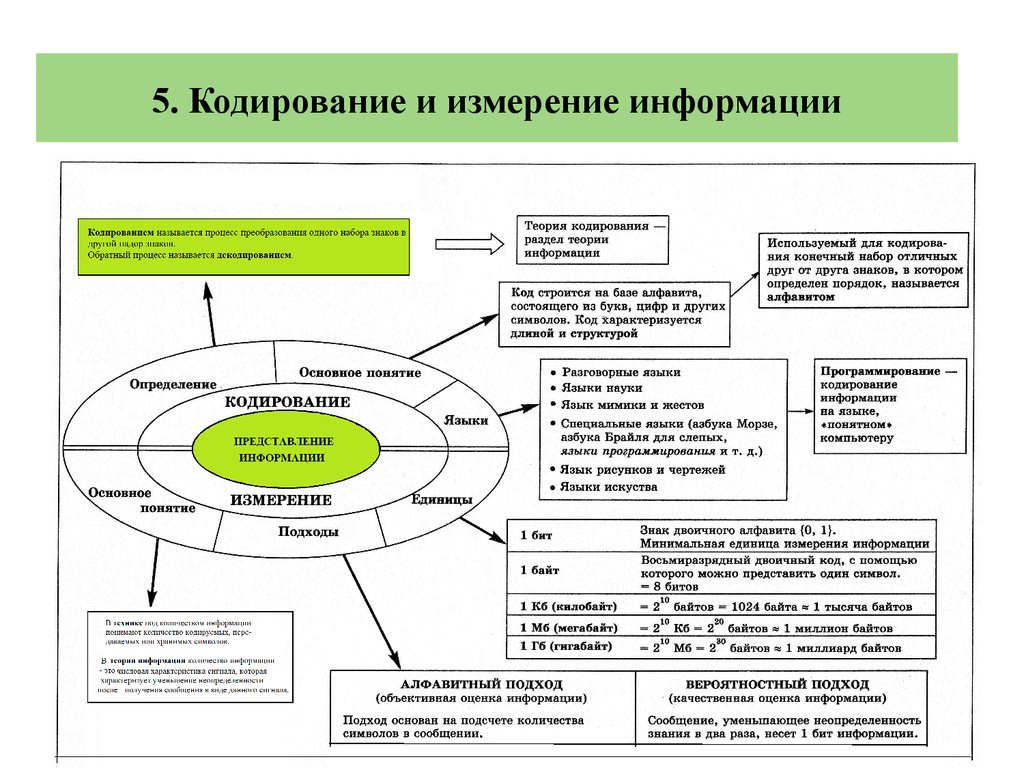

5. Кодирование и измерение информации40.

Определенная знаковая система представленияинформации называется языком.

Грамматика – характерные для конкретного языка

средства и правила создания смысловых единиц.

Правила приписывания содержания единицам языка,

называются семантическими.

Правила построения предложений из слов данного языка,

называются синтаксическими.

41.

Для технической обработки информации необходимо еекодирование.

Кодирование – представление в виде последовательности

символических обозначений (букв, цифр, закодированных

графических образов и звуков и т.п.).

Кодирование сохраняет смысловую нагрузку сообщения,

но представляет его в возможном для технического

устройства формате.

42.

Код – правило для преобразования одного набора знаков в другойнабор знаков.

Знак – это элемент конечного множества отличных друг от друга

элементов, с помощью которых кодируется сообщение.

Набор знаков, в котором определен порядок их следования,

называется алфавитом.

Количество знаков кодирующего алфавита, которое используется

при кодировании одного знака кодируемого сообщения называется

длиной кода.

43.

44.

Синтаксический уровень– изучение физических характеристик информации: способ

представления, скорость передачи данных, тип носителя).

Семантический уровень

– рассмотрение информации по ее содержанию.

Прагматический уровень

– рассмотрение информации с точки зрения практической

полезности и ценности для потребителя.

45.

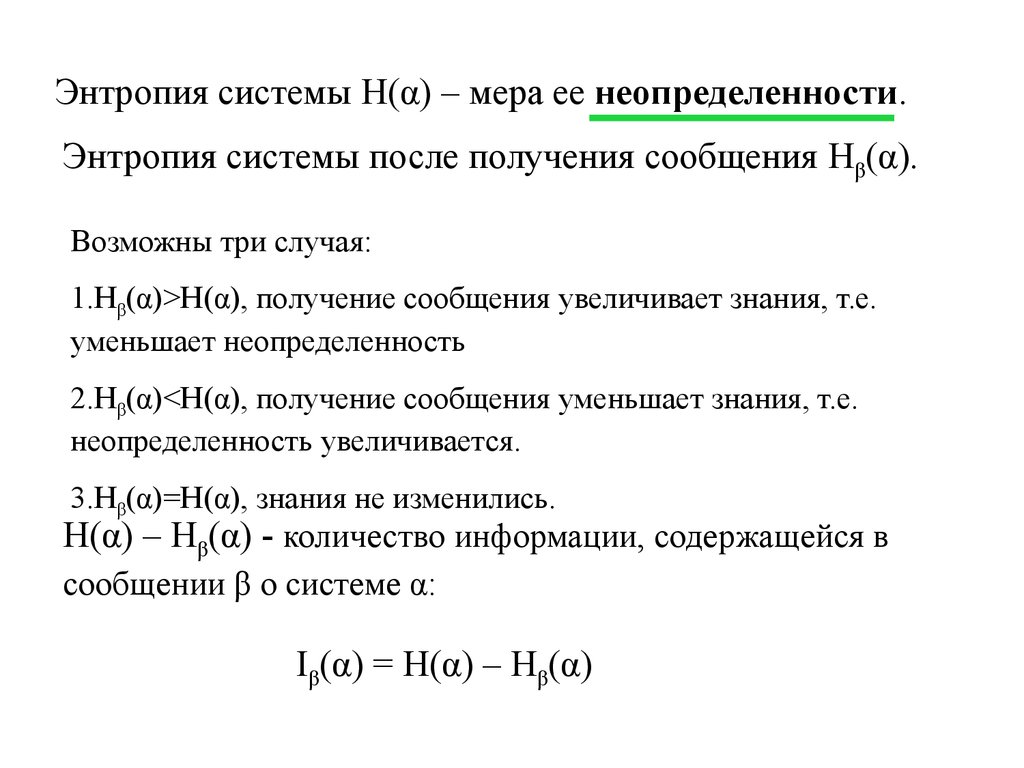

Энтропия системы H(α) – мера ее неопределенности.Энтропия системы после получения сообщения Hβ(α).

Возможны три случая:

1.Hβ(α)>H(α), получение сообщения увеличивает знания, т.е.

уменьшает неопределенность

2.Hβ(α)<H(α), получение сообщения уменьшает знания, т.е.

неопределенность увеличивается.

3.Hβ(α)=H(α), знания не изменились.

H(α) – Hβ(α) - количество информации, содержащейся в

сообщении β о системе α:

Iβ(α) = H(α) – Hβ(α)

46.

Для определения количества информации надооценить энтропию системы. В общем случае энтропия

системы, имеющей n возможных состояний (H(α)),

согласно формуле Шеннона равна

n

H ( ) p i log 2 p i ,

i 1

где pi вероятность того, что система находится в i-ом

состоянии.

При равновероятных исходах, т.е. pi = 1/n,

получаем формулу Хартли H(α) = log2n.

47.

Пример 1В барабане для розыгрыша лотереи находится 32 шара.

Сколько информации содержит сообщение о первом

выпавшем номере (например, выпал номер 15)?

Решение. Поскольку вытаскивание любого из 32 шаров

равновероятно, то количество информации об одном

выпавшем номере находится из уравнения 2I = 32. Отсюда

I = 5.

48.

Пример 2При бросании монеты (например, выпал «орел» или

«решка») количество возможных вариантов результатов

равно 2. Оба варианта равновероятны. Отсюда i=1.

49.

Пример 3Допустим, требуется угадать одно число из набора чисел

от 1 до 100. Для этого требуется количество информации

I= log2 100 = 6,644.

50.

Пример 4В коробке имеется 50 шаров. Из них 40 белых и 10

черных. Определить количество информации в сообщении о

том, что из корзины был вытащен черный шар.

Решение. Вероятность попадания при вытаскивании

черного шара р = 10/50 = 0,2. Количество информации в

сообщении о попадании черного шара i = log2(1/0,2) = log2 5

= 2,32.

51.

Количество информации, заключенной в тексте.i = log2N, где

i – количество информации, которое несет один символ,

N – мощность алфавита.

I = i * K, где

I – количество информации в тексте,

K – количество символов в тексте.

52.

Пример 5Книга, набранная с помощью компьютера, содержит 150

страниц; на каждой странице – 40 строк, в каждой строке –

60 символов. Каков объем информации в книге?

Решение. Мощность компьютерного алфавита равна 256.

Один символ несет 1 байт информации. Объем всей

информации в книге 2400 * 150 = 360 000 байт

53.

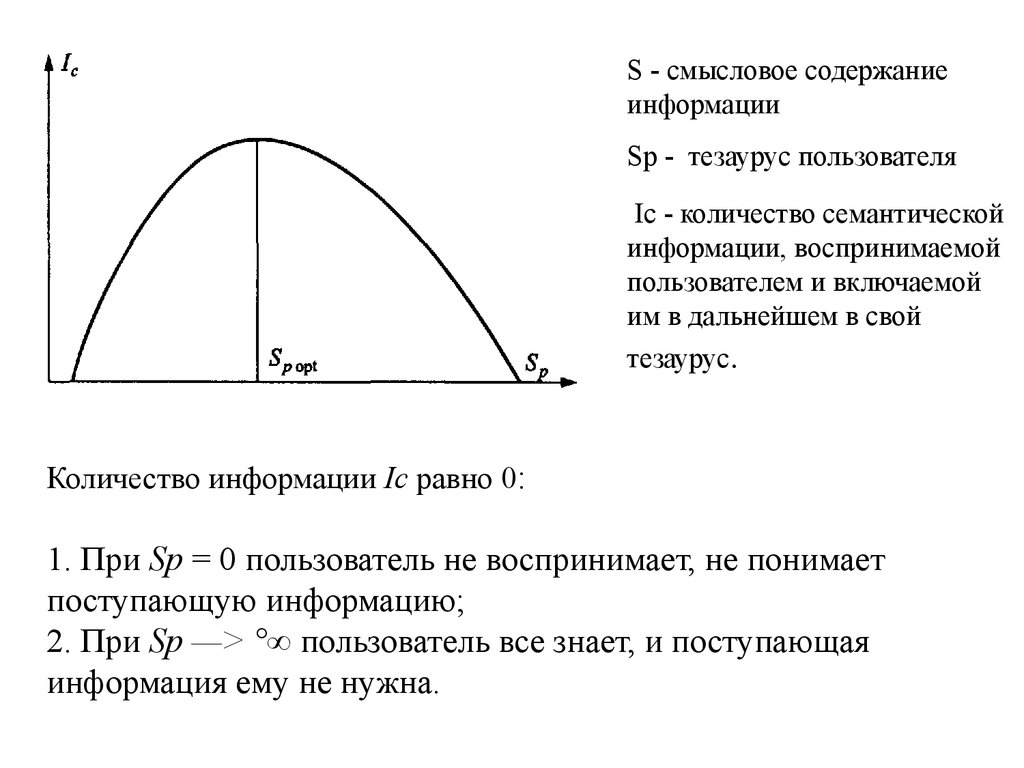

6.2. Семантическая мера информацииДля измерения смыслового содержания информации,

используется тезаурусная мера. Она связывает семантические

свойства информации со способностью пользователя

принимать поступившее сообщение.

Используется понятие тезаурус пользователя.

Тезаурус – это совокупность сведений, которыми располагает

пользователь или система.

54.

S - смысловое содержаниеинформации

Sp - тезаурус пользователя

Ic - количество семантической

информации, воспринимаемой

пользователем и включаемой

им в дальнейшем в свой

тезаурус.

Количество информации Ic равно 0:

1. При Sp = 0 пользователь не воспринимает, не понимает

поступающую информацию;

2. При Sp —> °∞ пользователь все знает, и поступающая

информация ему не нужна.

55.

Ic максимально, когда ее смысловое содержание S согласовано спользователя Sp.

Тогда информация понятна пользователю и несет ему ранее не

известные (отсутствующие в его тезаурусе) сведения.

Следовательно, количество семантической информации в

сообщении - величина относительная.

Относительной мерой количества семантической информации

является коэффициент содержательности С, который определяется

как отношение количества семантической информации к ее объему:

56.

6.3. Прагматическая мера информацииОпределяет полезность информации (ценность) для

достижения пользователем поставленной цели.

Оценивается двумя показателями.

1.Приращение вероятности достижения цели.

Пусть до получения сообщения β вероятность достижения

цели была р0, а после получения – р1.

Ценность информации, полученной из сообщения,

Ip = log (p1/p0).

57.

2. Прагматическая мера информацииоценивается величиной изменения целевой функции,

обусловленной получением информации.

Прагматическая мера информации, содержащейся в

сообщении β, оценивается по величине изменения

целевой функции: Iβ(α) = C(α /β) – C(α),

где Iβ(α) – ценность информационного сообщения β для системы α;

C(α /β) – значение целевой функции, оценивающей эффект

функционирования системы α при условии, что будет использована

информация, содержащаяся в сообщении β;

C(α) – значение целевой функции, оценивающей эффект

функционирования системы α до получения сообщения β.

58.

Информация относится к категории человеческогопознания истинности и в чистом виде неизмерима.

Количество информации, содержащееся в одном из двух

возможных сообщений, наз. битом.

Для внутримашинного представления информации и

определения необходимого объема памяти применяются

единицы бит и байт.

1 байт = 8 бит

59.

Производные единицы1Килобайт = 1024 байт = 210 байт

1Мегабайт = 1024 Кбайт = 220 байт

1Гигабайт = 1024 Мбайт = 230 байт

1Терабайт = 1024 Гбайт = 240 байт

1Петабайт = 1024 Тбайт = 250 байт

informatics

informatics