Similar presentations:

Glubokoe-obuchenie-Osobennosti-ispolzovaniya-parametrov-v-nejronnoj-seti

1.

Глубокое обучение:Особенности

использования параметров

в нейронной сети

2.

Что такое параметры нейронной сети?Веса (Weights)

Смещения (Bias)

Числовые коэффициенты, которые определяют

Свободные параметры, которые позволяют сдвигать

важность каждого входного сигнала для нейрона. Они

функцию активации нейрона. Это даёт модели

показывают, насколько сильно каждый вход влияет на

дополнительную гибкость и помогает ей лучше

конечный результат.

подстраиваться под данные.

Вместе веса и смещения формируют основу, на которой строится процесс обучения нейронной сети и её способность

принимать точные решения.

3.

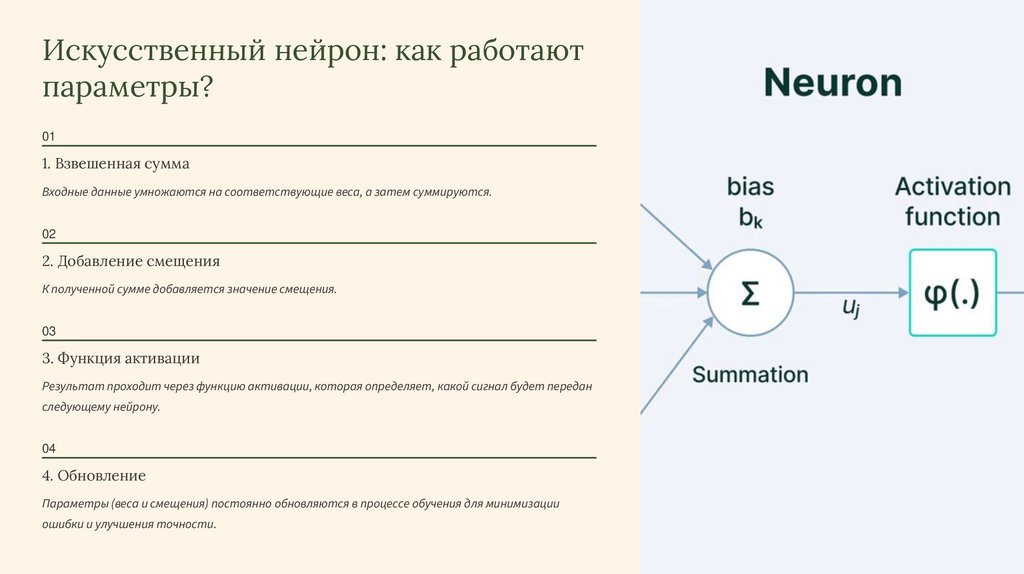

Искусственный нейрон: как работаютпараметры?

01

1. Взвешенная сумма

Входные данные умножаются на соответствующие веса, а затем суммируются.

02

2. Добавление смещения

К полученной сумме добавляется значение смещения.

03

3. Функция активации

Результат проходит через функцию активации, которая определяет, какой сигнал будет передан

следующему нейрону.

04

4. Обновление

Параметры (веса и смещения) постоянно обновляются в процессе обучения для минимизации

ошибки и улучшения точности.

4.

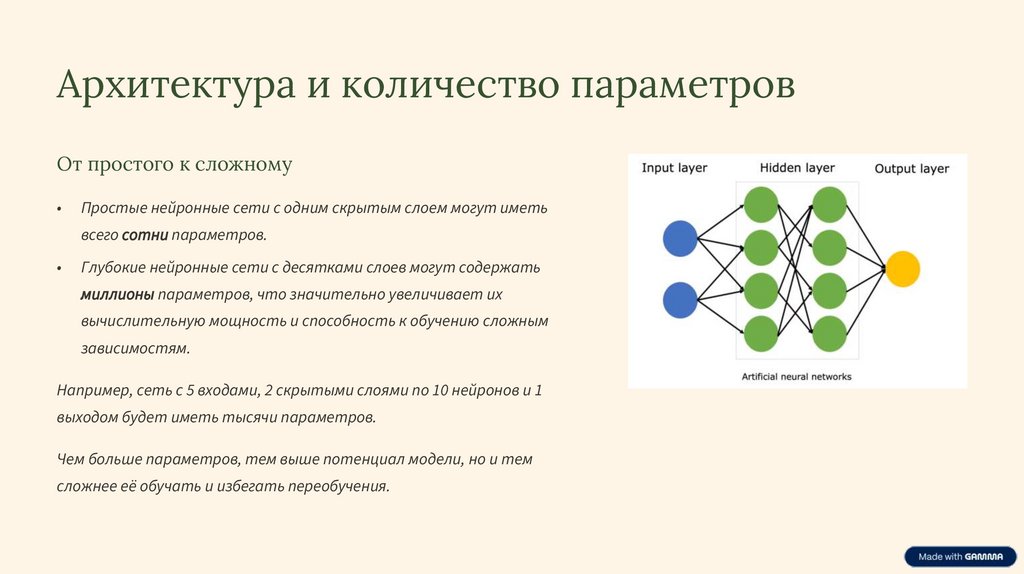

Архитектура и количество параметровОт простого к сложному

Простые нейронные сети с одним скрытым слоем могут иметь

всего сотни параметров.

Глубокие нейронные сети с десятками слоев могут содержать

миллионы параметров, что значительно увеличивает их

вычислительную мощность и способность к обучению сложным

зависимостям.

Например, сеть с 5 входами, 2 скрытыми слоями по 10 нейронов и 1

выходом будет иметь тысячи параметров.

Чем больше параметров, тем выше потенциал модели, но и тем

сложнее её обучать и избегать переобучения.

5.

Обучение параметров: Обратноераспространение и оптимизаторы

Обратное распространение (Backpropagation)

Механизм, который вычисляет градиенты ошибки по отношению к каждому параметру

сети, позволяя определить, в каком направлении и на сколько нужно изменить

параметры для уменьшения ошибки.

Оптимизаторы (SGD, Adam)

Алгоритмы, которые используют вычисленные градиенты для корректировки весов и

смещений, шаг за шагом улучшая производительность модели. Adam — один из самых

популярных адаптивных оптимизаторов, который подстраивает скорость обучения для

каждого параметра индивидуально.

6.

Регуляризация: Борьба с переобучением параметровЧтобы избежать переобучения — ситуации, когда модель слишком хорошо запоминает обучающие данные, но плохо работает на новых,

неизвестных данных — используются методы регуляризации.

Dropout

Случайное "выключение" нейронов во время обучения. Это заставляет сеть быть более устойчивой и не полагаться на

конкретные нейроны.

Батч-нормализация (Batch Normalization)

Нормализация входных данных для каждого слоя. Это ускоряет обучение и стабилизирует работу сети, делая её менее

чувствительной к инициализации параметров.

Weight Decay

Штраф за большие значения весов. Он препятствует излишней сложности модели, заставляя веса оставаться небольшими и

тем самым предотвращая переобучение.

7.

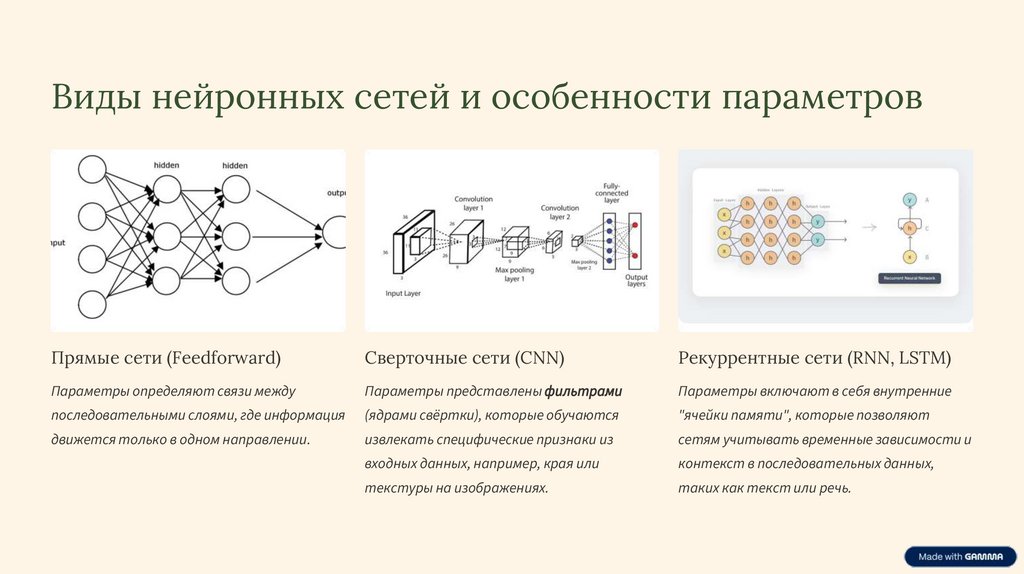

Виды нейронных сетей и особенности параметровПрямые сети (Feedforward)

Сверточные сети (CNN)

Рекуррентные сети (RNN, LSTM)

Параметры определяют связи между

Параметры представлены фильтрами

Параметры включают в себя внутренние

последовательными слоями, где информация

(ядрами свёртки), которые обучаются

"ячейки памяти", которые позволяют

движется только в одном направлении.

извлекать специфические признаки из

сетям учитывать временные зависимости и

входных данных, например, края или

контекст в последовательных данных,

текстуры на изображениях.

таких как текст или речь.

8.

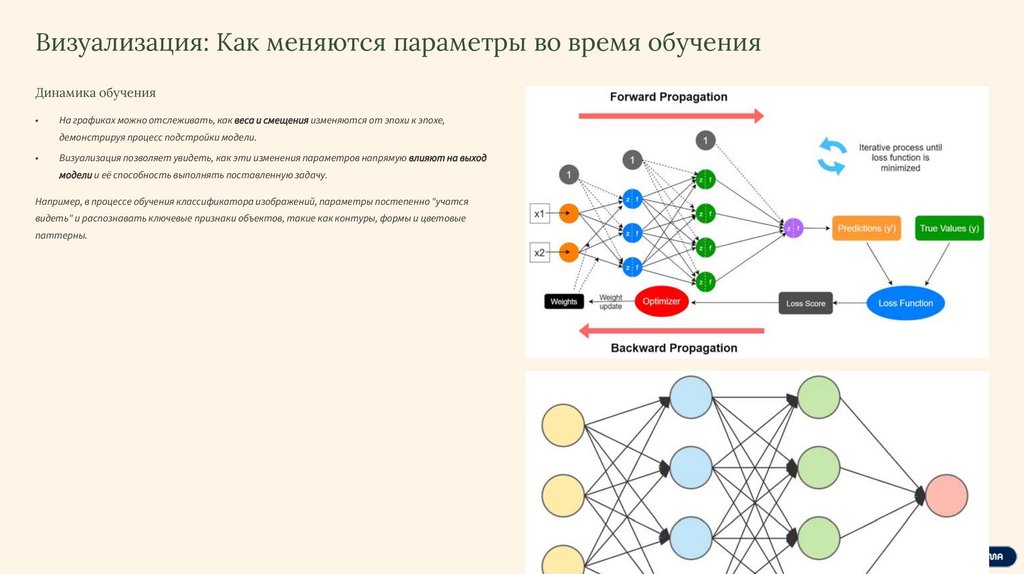

Визуализация: Как меняются параметры во время обученияДинамика обучения

На графиках можно отслеживать, как веса и смещения изменяются от эпохи к эпохе,

демонстрируя процесс подстройки модели.

Визуализация позволяет увидеть, как эти изменения параметров напрямую влияют на выход

модели и её способность выполнять поставленную задачу.

Например, в процессе обучения классификатора изображений, параметры постепенно "учатся

видеть" и распознавать ключевые признаки объектов, такие как контуры, формы и цветовые

паттерны.

9.

Практические советы поработе с параметрами

Инициализация параметров

Правильный выбор начальных значений весов и смещений критичен для

успешного старта обучения и предотвращения проблем с исчезающими

или взрывающимися градиентами.

Выбор функции активации

Функция активации влияет на нелинейность модели и на способ

распространения градиентов, что напрямую сказывается на обновлении

параметров.

Настройка гиперпараметров

Точная настройка скорости обучения, коэффициентов регуляризации и

других гиперпараметров оптимизатора является ключевым фактором

для достижения высокого качества модели и эффективного обучения.

10.

Заключение: Параметры — сердце глубокогообучения

Инновационные методы

Современные алгоритмы оптимизации

Основа интеллекта

Понимание и грамотное

управление параметрами — это

ключ к созданию эффективных и

высокопроизводительных

нейросетей, способных решать

сложные задачи.

и регуляризации значительно

упрощают обучение моделей с

миллионами параметров, делая

глубокое обучение доступнее.

Искусство и наука

Глубокое обучение — это не только

наука, но и искусство настройки

бесчисленных параметров для создания

систем, способных имитировать

человеческое познание.

informatics

informatics