Similar presentations:

2

1. Инструменты и платформы для работы

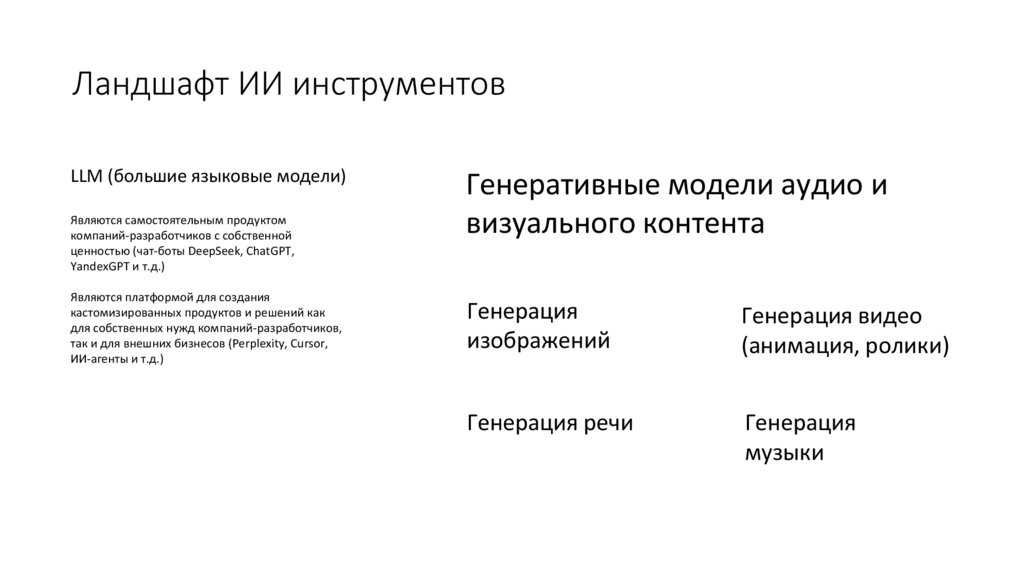

17 июля 2025 г.2. Ландшафт ИИ инструментов

LLM (большие языковые модели)Являются самостоятельным продуктом компаний-разработчиков с

собственной ценностью (чат-боты DeepSeek, ChatGPT, YandexGPT и т.д.)

Являются платформой для создания кастомизированных продуктов и

решений как для собственных нужд компаний-разработчиков, так и

для внешних бизнесов (Perplexity, Cursor, голосовые помощники, ИИагенты и т.д.)

3. Обзор существующих LLM

ПродуктыРазработчики

Инфраструктура

4. Большие языковые модели

5. Большие языковые модели

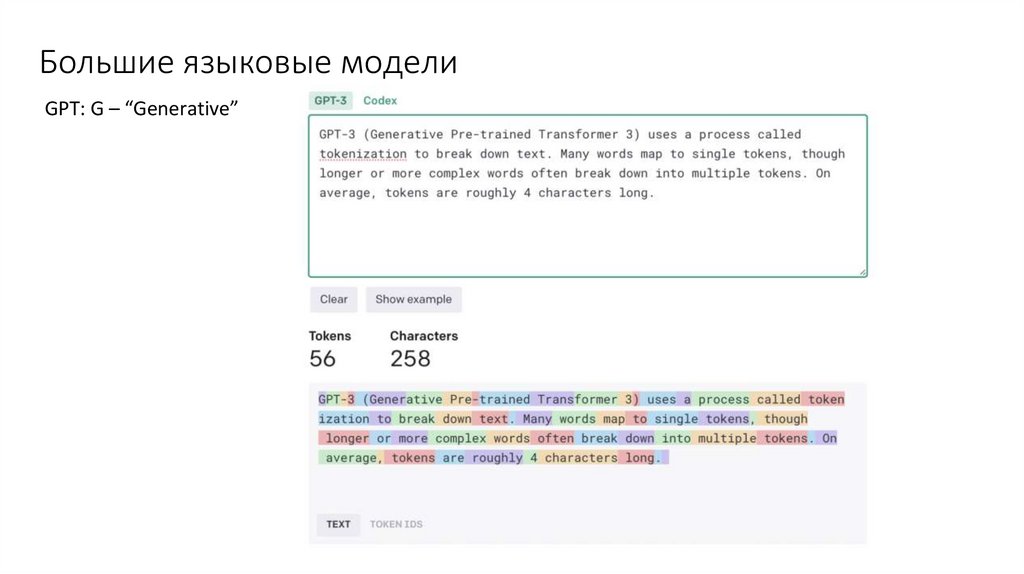

GPT: G – “Generative”6. Большие языковые модели

GPT: P – “Pretrained”“Pretrained” означает, что модель предобучена на большом массиве данных до

того, как её начнут применять на практике или дообучать на конкретных задачах.

Pretraining (предобучение): модель обучается на гигантских объёмах открытых текстов из

интернета (книги, статьи, сайты) без специфической задачи — просто учится

«предсказывать» следующий токен (слово, символ или часть слова). Это создаёт базовое

знание о языке, логике, мире.

Fine-tuning (донастройка): на втором этапе, если нужно, модель могут дополнительно

обучать на конкретных данных (например, юридические тексты или медицинские записи).

“Pretrained” подчёркивает, что модель уже «знает» общий

язык и не обучается с нуля для каждой задачи.

7. Большие языковые модели

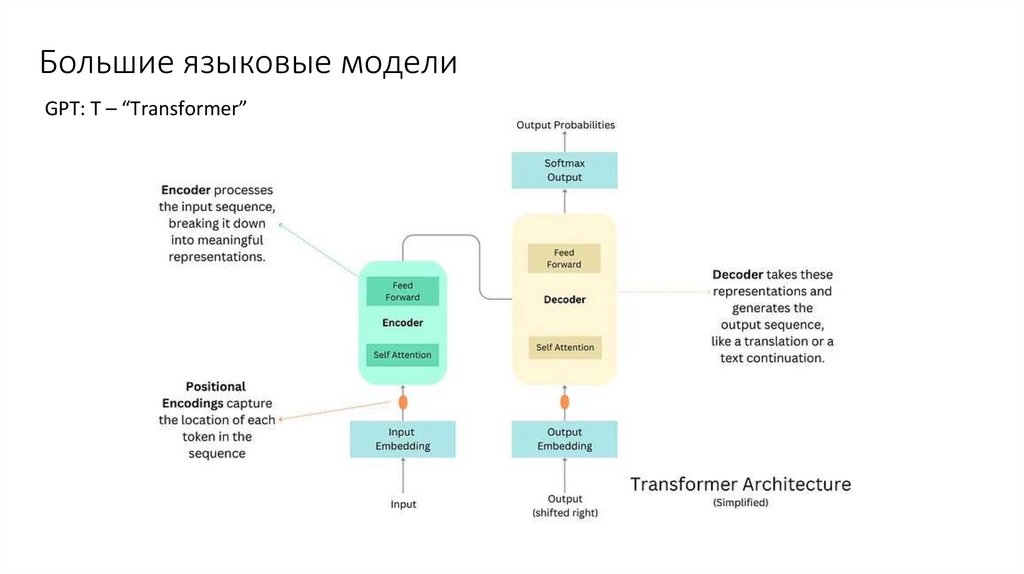

GPT: T – “Transformer”8. Большие языковые модели

GPT: T – “Transformer”В основе трансформеров лежит процесс, называемый «self-attention»

Трансформеры читают каждое «слово» в предложении сразу (в отличие от рекуррентных

нейронных сетей) и сравнивают каждое «слово» со всеми остальными.

Это позволяет направить свое «внимание» (attention) на наиболее важные «слова»,

независимо от того, где они находятся в предложении.

Трансформеры не работают со словами, они работают с «токенами», которые представляют

собой фрагменты текста, закодированные в виде вектора

9. Большие языковые модели

GPT — это Генеративный Предобученный Трансформер:готовая основа, которую можно адаптировать под

практически любую задачу

10. Что такое (Chat + GPT) и как работает

Приставка “Chat” к GPT означает, что это GPT, дообученный (или настроенный)так, чтобы общаться в формате диалога, поддерживать контекст общения,

понимать вопросы и давать развернутые, понятные ответы.

В отличие от базового GPT, который просто предсказывает следующий токен, ChatGPT

обучен имитировать человекоподобную беседу.

Обычно это достигается через instruction tuning (обучение следовать инструкциям) и

reinforcement learning from human feedback (RLHF) — дополнительное обучение с

участием людей, которые оценивают ответы модели.

GPT — просто мощный языковой мозг;

ChatGPT — тот же мозг, но «обученный» для общения с

людьми

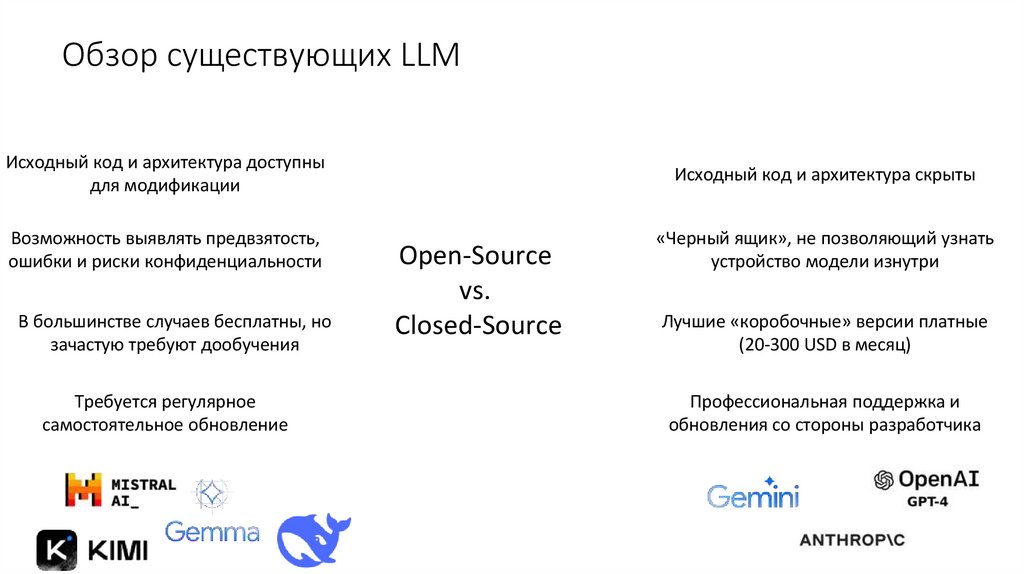

11. Обзор существующих LLM

Исходный код и архитектура доступныдля модификации

Исходный код и архитектура скрыты

Возможность выявлять предвзятость,

ошибки и риски конфиденциальности

«Черный ящик», не позволяющий узнать

устройство модели изнутри

В большинстве случаев бесплатны, но

зачастую требуют дообучения

Требуется регулярное

самостоятельное обновление

Open-Source

vs.

Closed-Source

Лучшие «коробочные» версии платные

(20-300 USD в месяц)

Профессиональная поддержка и

обновления со стороны разработчика

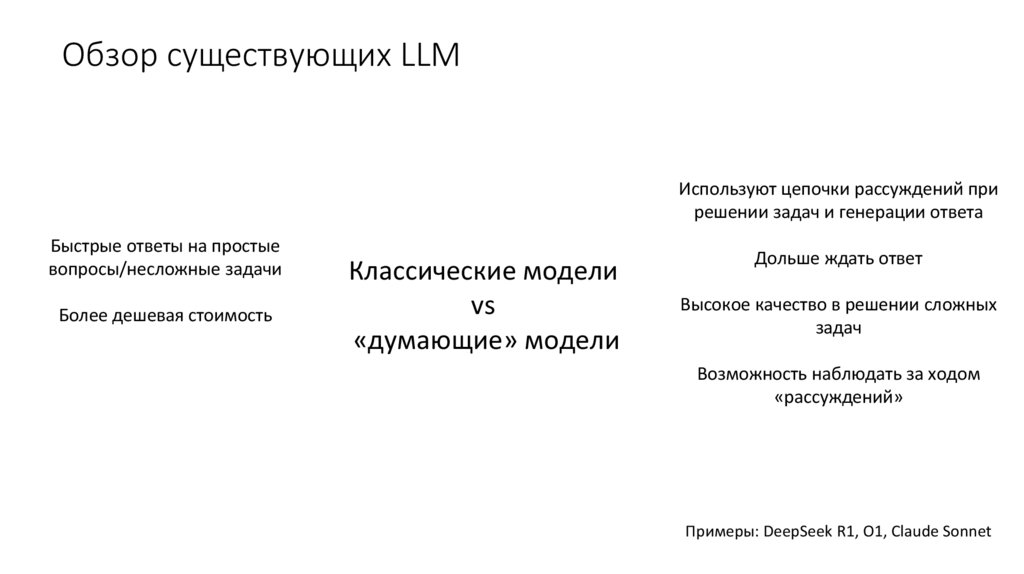

12. Обзор существующих LLM

Используют цепочки рассуждений прирешении задач и генерации ответа

Быстрые ответы на простые

вопросы/несложные задачи

Более дешевая стоимость

Классические модели

vs

«думающие» модели

Дольше ждать ответ

Высокое качество в решении сложных

задач

Возможность наблюдать за ходом

«рассуждений»

Примеры: DeepSeek R1, O1, Claude Sonnet

13. Большие языковые модели

Что такое prompt-engineering?Prompt-engineering – это процесс тщательной подготовки и

структурирования запросов или инструкций для интерактивного общения

с искусственным интеллектом, в частности с большими языковыми

моделями.

Это техника формулирования запросов таким образом, чтобы получить

максимально точный и релевантный ответ от ИИ.

14. Большие языковые модели

Для чего он нужен?Prompt-engineering необходим для повышения эффективности и точности

ответов.

Правильно сформулированные запросы помогают уточнить контекст и

цель вопроса, что ведет к более точным и полезным ответам от модели.

15. Большие языковые модели

Как мы будем работать?Важность навыка вопрошания в prompt-engineering

заключается в том, что он играет ключевую роль в оптимизации

взаимодействия между человеком (с его задачами) и искусственным

интеллектом.

16. Большие языковые модели

Базовые задачи для освоения1. Написание текста (writing)

2. Обобщение (summarizing)

3. Анализ/выводы (analyzing/inferring)

4. Генерация новых идей (brainstorming)

5. Выявление закономерностей, тенденций на основе предоставленного ряда данных (synthesizing)

6. Выделение (extracting)

7. Переформатирование (reformatting)

8. Развертывание (expanding)

9. *Создание программного кода (coding)

17.

Генеративные моделиаудио и визуального контента

18. Ландшафт ИИ инструментов

LLM (большие языковые модели)Являются самостоятельным продуктом

компаний-разработчиков с собственной

ценностью (чат-боты DeepSeek, ChatGPT,

YandexGPT и т.д.)

Являются платформой для создания

кастомизированных продуктов и решений как

для собственных нужд компаний-разработчиков,

так и для внешних бизнесов (Perplexity, Cursor,

ИИ-агенты и т.д.)

Генеративные модели аудио и

визуального контента

Генерация

изображений

Генерация видео

(анимация, ролики)

Генерация речи

Генерация

музыки

19.

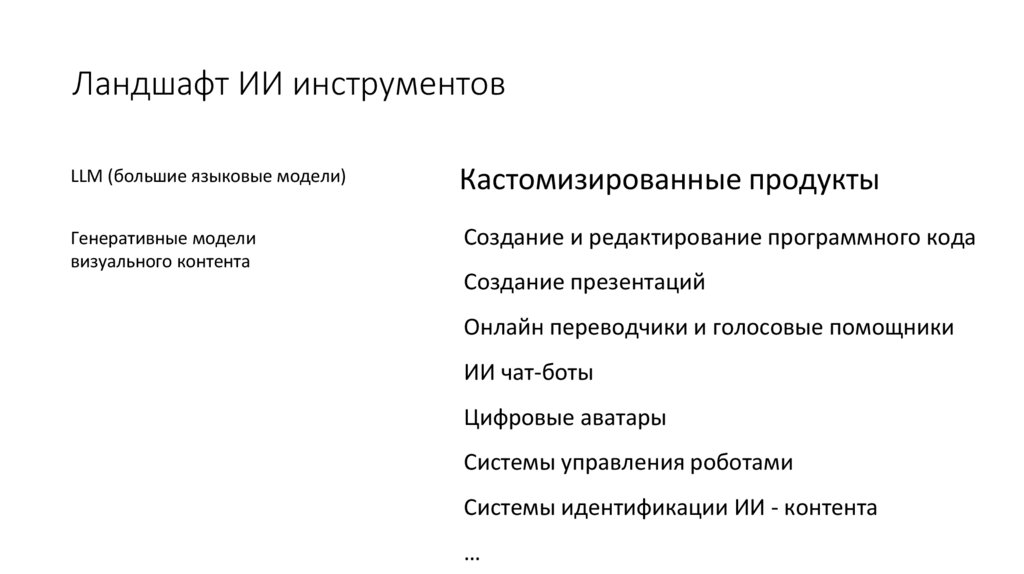

Кастомизированные продукты20. Ландшафт ИИ инструментов

LLM (большие языковые модели)Кастомизированные продукты

Генеративные модели

визуального контента

Создание и редактирование программного кода

Создание презентаций

Онлайн переводчики и голосовые помощники

ИИ чат-боты

Цифровые аватары

Системы управления роботами

Системы идентификации ИИ - контента

…

21. Следующая встреча

18 июля (пятница) в 16:00 (Мск)22. Практическое задание

По результатам материалов лекций от 16 и 17 июля 2025 года помыслитьи описать как может выглядеть работа Вашего учреждения в 2040 году:

какие операционные задачи сохранятся в работе Вашего учреждения и как

может измениться их выполнение из-за искусственного интеллекта?

Время выполнения – до 19:00 Мск