Similar presentations:

Информационные технологии в профессиональной деятельности. Информация. Кодирование информации

1.

2.

Лекции – 4 час. (2 пар)Лаб.работы – 10час. (5 пар)

Итоговый контроль: экзамен

3.

Допуск к экзамену:1. Сдать доклад по выбранной теме в

сроки указанные преподавателем.

Доклад оформить в форме реферата

(средствами Word ) + разработать

презентацию по теме доклада.

2. Выполнить все лабораторные

работы

4.

РЕКОМЕНДУЕМАЯ ЛИТЕРАТУРА1. Информационные системы в экономике : учебник /

под ред. Г. А. Титоренко – М. : ЮНИТИ, 2006.

2. Романов, В. П. Интеллектуальные

информационные системы в экономике : учеб.

пособие / В. П. Романов. – М. : Экзамен, 2003.

3. Информационные системы.: учебное пособие для

ВУЗов / Ю.П. Избачков, В.И.Петров. – СПб.: Питер,

2005.

4. Информационные технологии: учебник для вузов /

Б.Я. Советов, В.В. Цехановский – М.: Высшая

школа, 2005.

5. Соболь Б.В. и др. Информатика: учебник. 2006 Хохлова Н.М. Информационные технологии…(конспект лекций)

6.

Тема1Информация. Кодирование

информации.

7.

Наука информатика:Объект изучения – информация;

предмет изучения –

информационные процессы;

Информационные процессы – это

процессы, связанные с

получением, обработкой,

хранением, передачей

информации.

8. Французский термин informatigue(информатика) образован путем слияния слов information (информация) и automatique (автоматика) и

•Французский терминinformatigue(информатика)

образован путем слияния слов

information (информация) и

automatique (автоматика) и

означает «информационная

автоматика или

автоматизированная переработка

информации).

9. В англоязычных странах этому термину соответствует синоним computer science (наука о компьютерной технике)

10.

В общем случае в информатикевыделяют три части:

soft ware

•техническую -hard ware

•алгоритмическую - brain

ware

•программную -

11.

В теории информациисуществует

шенноновский подход.

(Клод Шеннон

американский инженер и

математик, родоначальник

теории информации)

12.

Информация - этоснятая

неопределенность, или

результат выбора из

набора возможных

альтернатив.

13.

В кибернетике (Кибернетика –наука об управлении) понятие

«информация» используется

для описания процессов

управления в сложных

динамических системах

(природе, обществе, технике).

(Норберт Винер – «отец» кибернетики)

14.

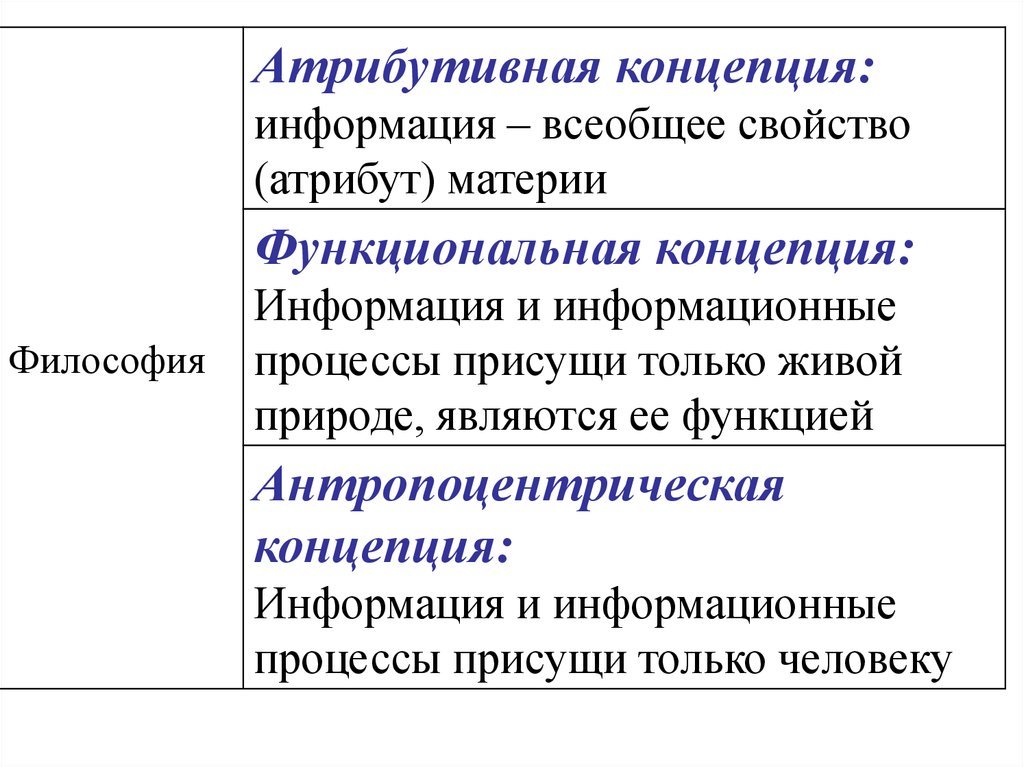

Атрибутивная концепция:информация – всеобщее свойство

(атрибут) материи

Функциональная концепция:

Философия

Информация и информационные

процессы присущи только живой

природе, являются ее функцией

Антропоцентрическая

концепция:

Информация и информационные

процессы присущи только человеку

15.

Носитель данных –материальный объект

или среда, которые

служат для

представления или

передачи информации.

16.

сигнал называетсядискретным

(прерывистым), если его

параметр может

принимать конечное число

значений в пределах

некоторого интервала

времени

17.

сигнал называетсянепрерывным

(аналоговым), если его

параметр может принимать

любое значение в пределах

некоторого интервала

времени

18.

Виды информацииПо способу

По форме

восприятия

представления

визуальная

текстовая

аудиальная

числовая

обонятельная

графическая

тактильная

звуковая

вкусовая

19.

Свойстваинформации

20.

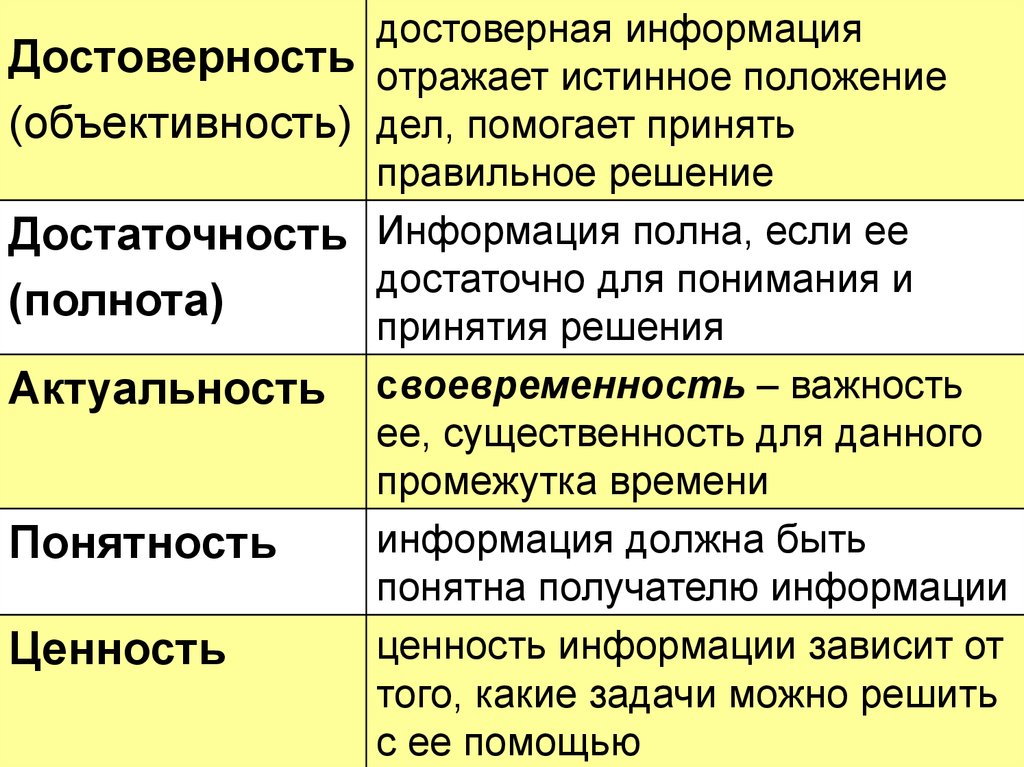

достоверная информацияДостоверность отражает истинное положение

(объективность) дел, помогает принять

правильное решение

Достаточность Информация полна, если ее

достаточно для понимания и

(полнота)

принятия решения

Актуальность своевременность – важность

ее, существенность для данного

промежутка времени

информация должна быть

Понятность

понятна получателю информации

ценность информации зависит от

Ценность

того, какие задачи можно решить

с ее помощью

21. Актуальность – степень соответствия информации текущему моменту времени

22. Единицы измерения информации

23.

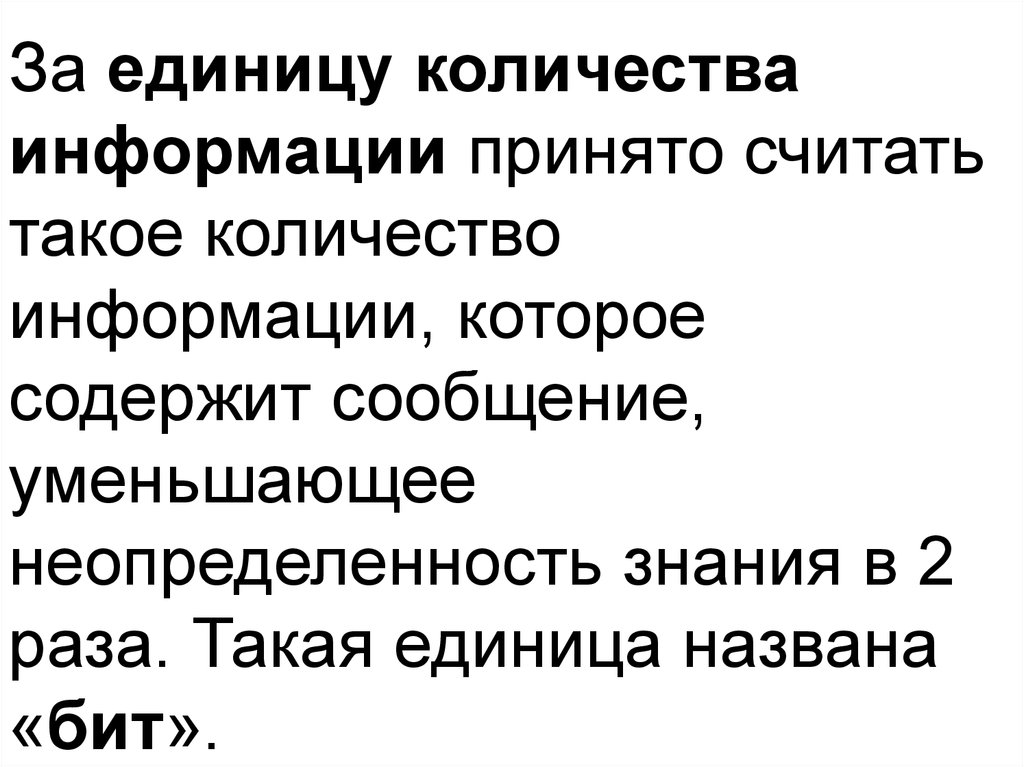

За единицу количестваинформации принято считать

такое количество

информации, которое

содержит сообщение,

уменьшающее

неопределенность знания в 2

раза. Такая единица названа

«бит».

24.

Сообщение о том,что произошло одно

событие из двух

равновероятных,

несет 1 бит

информации

25.

Обозначим:N – количество

равновероятных сообщений

(событий)

I - количество информации

содержащееся в выбранном

сообщении

26.

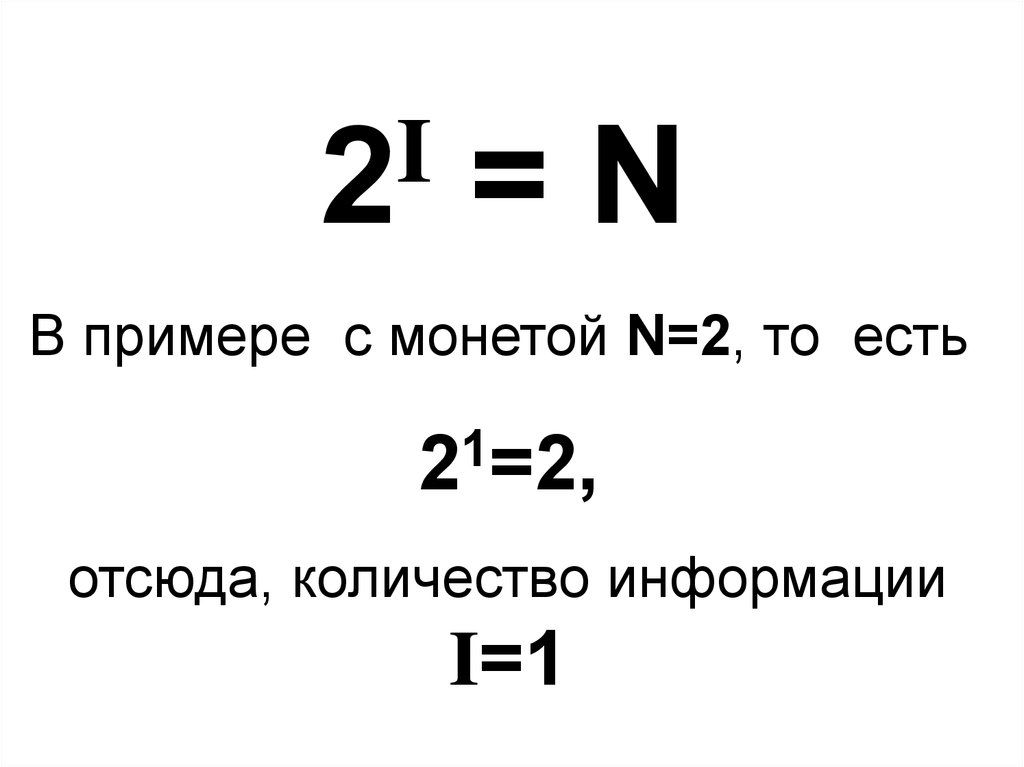

I2

=N

В примере с монетой N=2, то есть

1

2 =2,

отсюда, количество информации

I=1

27.

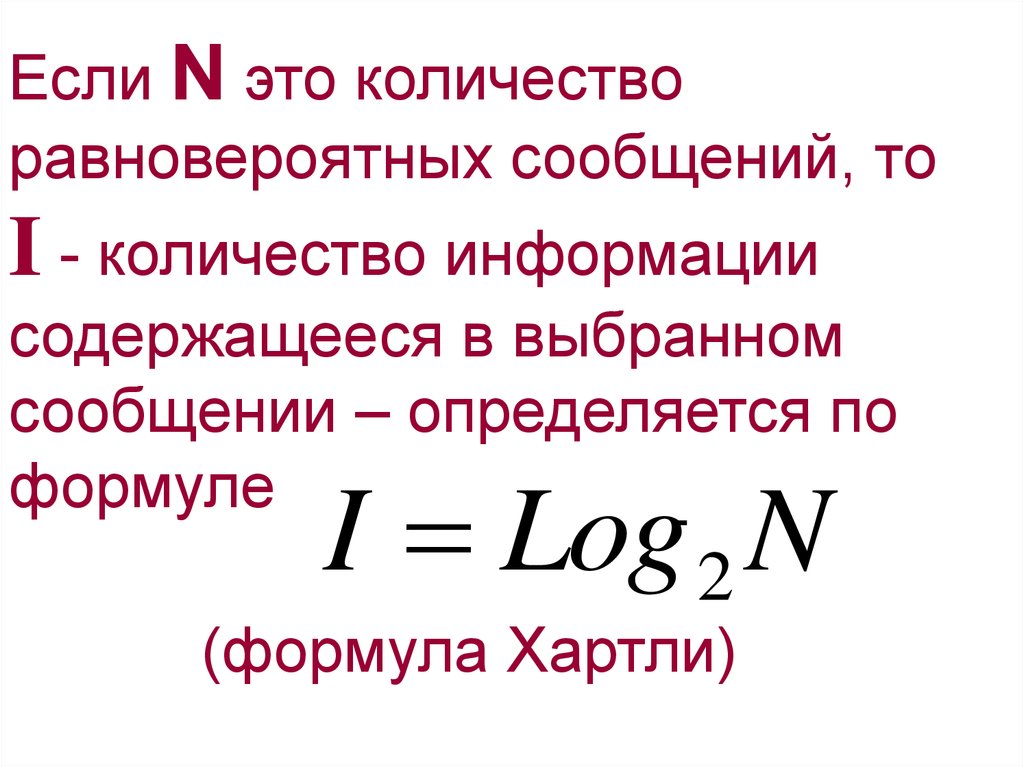

Если N это количестворавновероятных сообщений, то

I - количество информации

содержащееся в выбранном

сообщении – определяется по

формуле

I Log 2 N

(формула Хартли)

28.

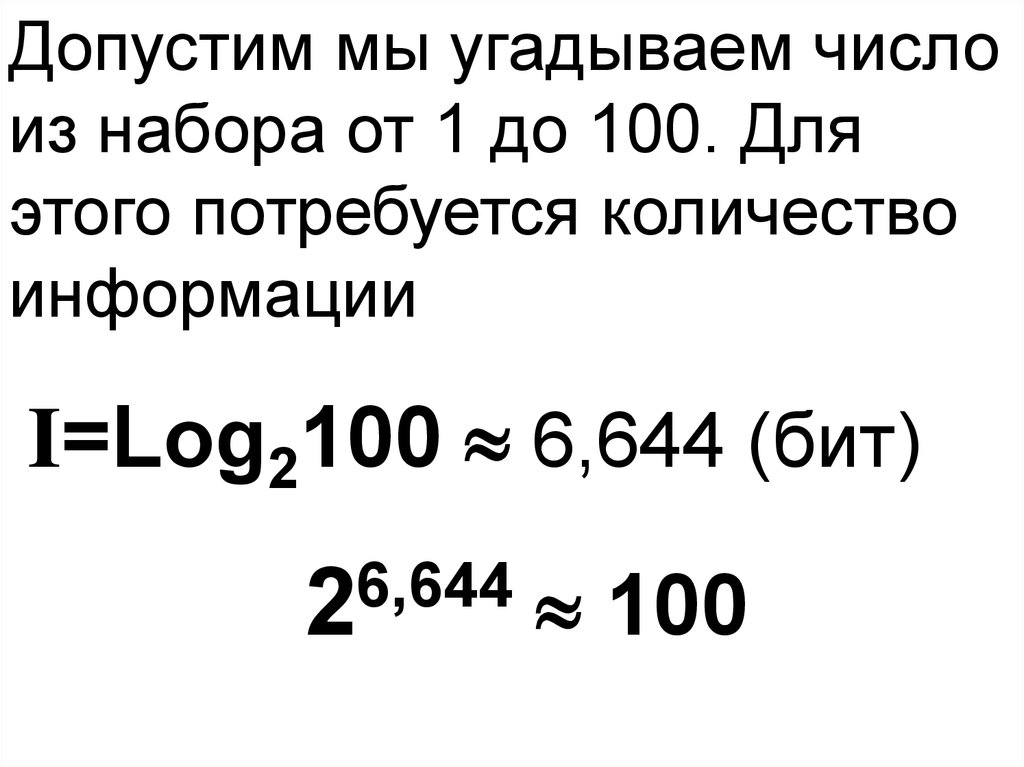

Допустим мы угадываем числоиз набора от 1 до 100. Для

этого потребуется количество

информации

I=Log2100 6,644 (бит)

6,644

2

100

29.

30.

Кол-вособытий,

сообщений

8

16

32

64

128

256

512

1024

Кол-во

информации

23

24

25

26

27

28

29

210

3 бит

4 бит

5 бит

6 бит

7 бит

8 бит

9 бит

10 бит

31.

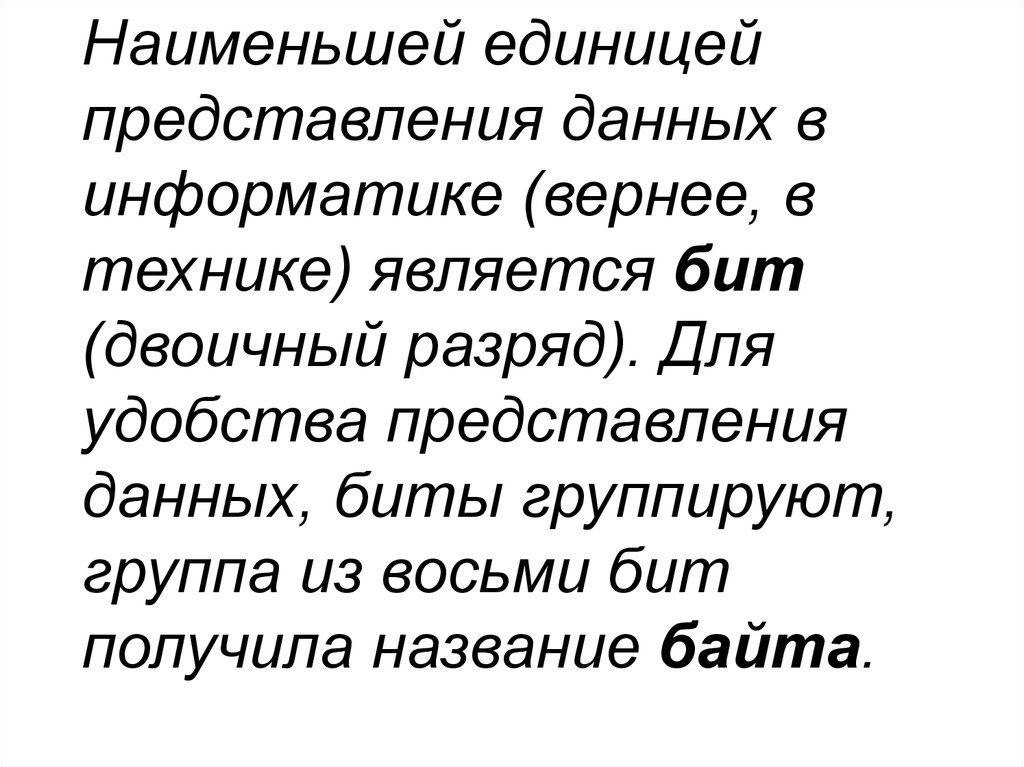

Наименьшей единицейпредставления данных в

информатике (вернее, в

технике) является бит

(двоичный разряд). Для

удобства представления

данных, биты группируют,

группа из восьми бит

получила название байта.

32.

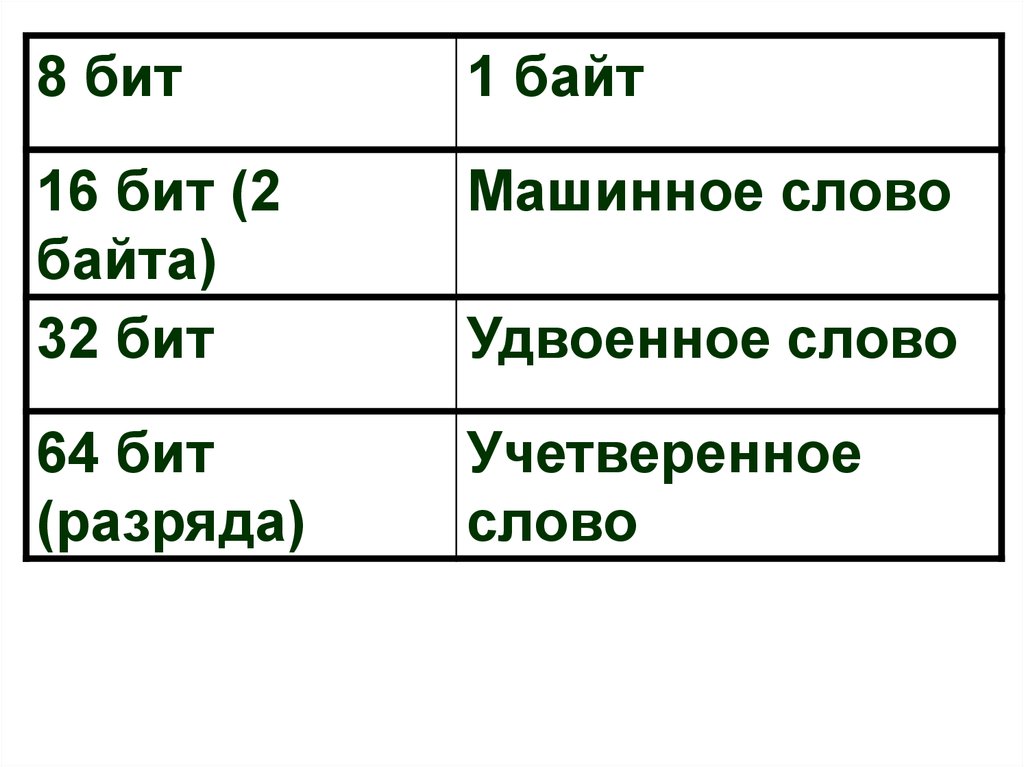

8 бит1 байт

16 бит (2

байта)

32 бит

Машинное слово

64 бит

(разряда)

Учетверенное

слово

Удвоенное слово

33.

Единицы измерения данных(Экзабайт, зеттабайт, йоттабайт)

34.

Информационнымназывается общество, где

большинство работающих

занято производством,

хранением, переработкой и

реализацией информации,

особенно ее высшей формы —

знаний.

35.

Контрольные вопросы и задания1.Дайте определение

информации. Перечислите

свойства информации.

2.Что понимается под

носителем информации?

36.

3.Дайте определение дискретных ианалоговых сигналов.

4.Какие три взаимосвязанные части

выделяют в информатике?

5.Составные части информатики с

современной точки зрения

37.

Энтропия в информатике это свойство ...a) данных

b) условий поиска

c) знаний

d) информации

informatics

informatics