Similar presentations:

Память сильнее, чем у слона! Как сделать так, чтобы ИИ ничего не забывал

1.

codex.townПамять сильнее,

чем у слона!

Как сделать так, чтобы ИИ ничего не

забывал

2.

codex.townThank you for your donations!

3.

codex.townCodex Town – сообщество

исследователей, практиков,

экспертов, билдеров и

интересующихся новыми

технологиями.

4.

codex.town5.

codex.townCodex.plan

Введение

• Необходимость механизмов памяти в языковых моделях

Теория

• Долгосрочная память для контекста на протяжении диалога

• Краткосрочная память для учета последних реплик

• Подход SPR для эффективной реконструкции информации

Технологии

• Использование платформы Zep для реализации памяти в чат-ботах

Демонстрация

• Создание простого демо чат-бота с механизмами памяти на основе Zep и SPR

Заключение

• Значимость развития механизмов памяти для языковых моделей

6.

codex.townВведение

7.

codex.townВведение

• Современные языковые модели не могут поддерживать длительный

контекстный диалог

• Способность к контекстному диалогу - ключевая для создания по-настоящему

интеллектуального ИИ

• Рассмотрим подходы к реализации механизмов долгосрочной и

краткосрочной памяти в языковых моделях

• Познакомился с ключевыми идеями и инструментами в этой сфере

8.

codex.townПроблемы памяти в LLM

• Современные языковые модели не могут поддерживать длительный

контекстный диалог

• Способность к контекстному диалогу - ключевая для создания по-настоящему

интеллектуального ИИ

• Рассмотрим подходы к реализации механизмов долгосрочной и

краткосрочной памяти в языковых моделях

• Познакомился с ключевыми идеями и инструментами в этой сфере

9.

codex.townТеория

10.

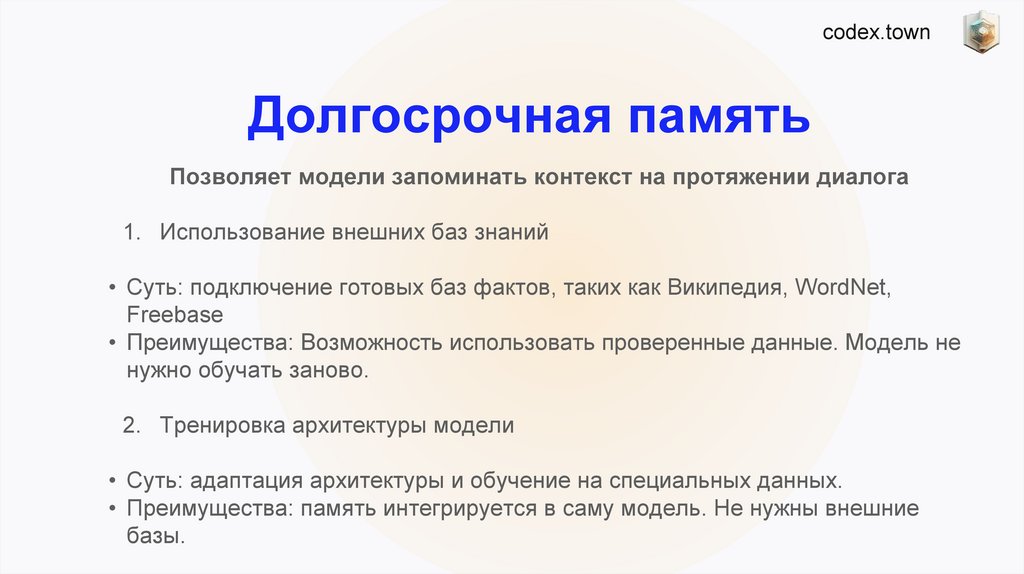

codex.townДолгосрочная память

Позволяет модели запоминать контекст на протяжении диалога

1. Использование внешних баз знаний

• Суть: подключение готовых баз фактов, таких как Википедия, WordNet,

Freebase

• Преимущества: Возможность использовать проверенные данные. Модель не

нужно обучать заново.

2. Тренировка архитектуры модели

• Суть: адаптация архитектуры и обучение на специальных данных.

• Преимущества: память интегрируется в саму модель. Не нужны внешние

базы.

11.

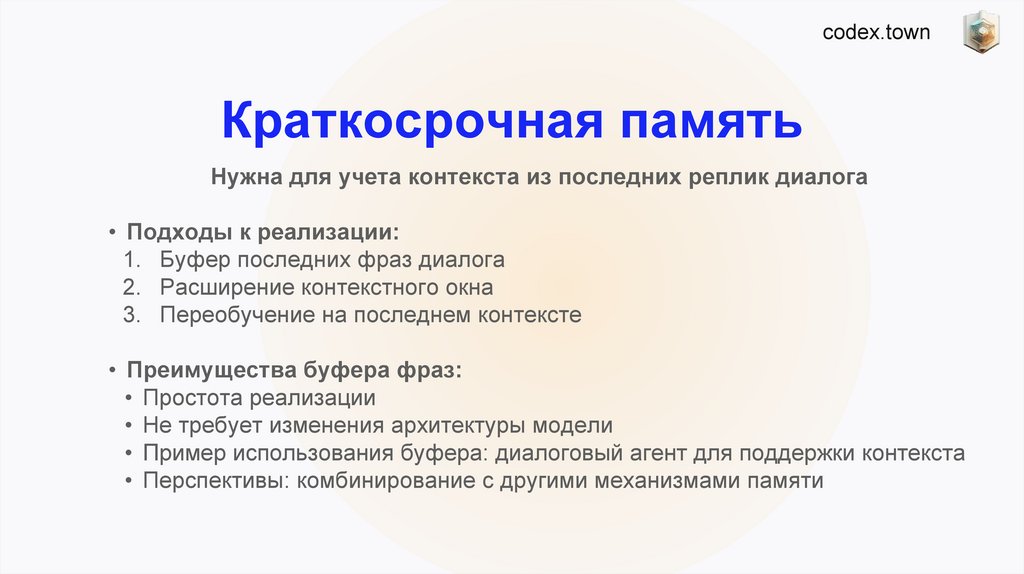

codex.townКраткосрочная память

Нужна для учета контекста из последних реплик диалога

• Подходы к реализации:

1. Буфер последних фраз диалога

2. Расширение контекстного окна

3. Переобучение на последнем контексте

• Преимущества буфера фраз:

• Простота реализации

• Не требует изменения архитектуры модели

• Пример использования буфера: диалоговый агент для поддержки контекста

• Перспективы: комбинирование с другими механизмами памяти

12.

codex.townТехнологии

13.

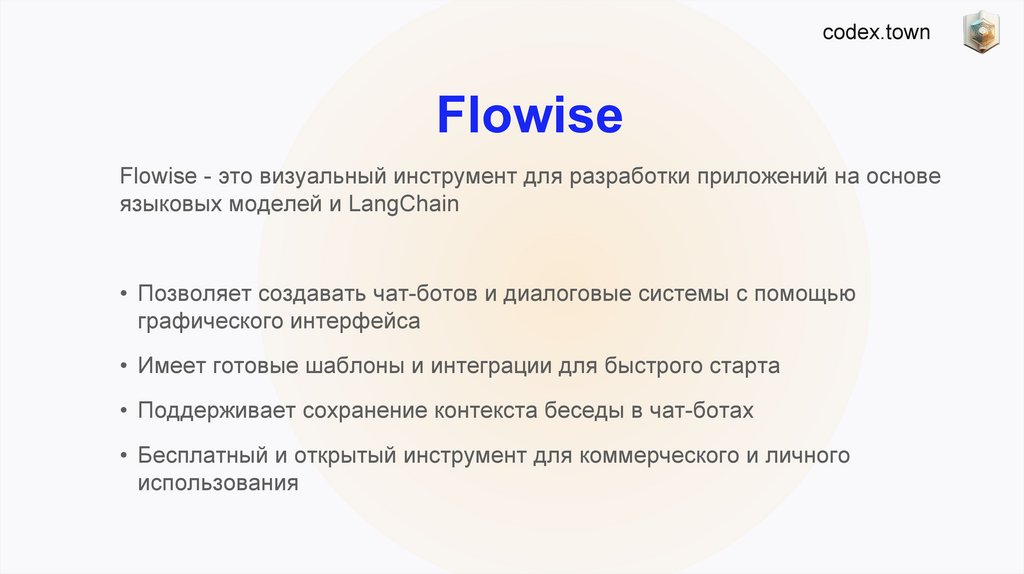

codex.townFlowise

Flowise - это визуальный инструмент для разработки приложений на основе

языковых моделей и LangChain

• Позволяет создавать чат-ботов и диалоговые системы с помощью

графического интерфейса

• Имеет готовые шаблоны и интеграции для быстрого старта

• Поддерживает сохранение контекста беседы в чат-ботах

• Бесплатный и открытый инструмент для коммерческого и личного

использования

14.

codex.townПлатформа

Zep

1. Open source для разработки приложений на основе языковых моделей

2. Быстрый перевод прототипа в продакшн

3. Пользователи, сессии, контекст и документы - объекты первого класса

4. Возможности:

5. Быстрая настройка

6. Гибридная векторная БД

7. Сохранение истории чатов

8. Извлечение признаков

9. Интеграции с инструментами NLP

Применение:

• Чат-боты с сохранением контекста

• Приложения на основе документов

• Инструменты для агентов

15.

codex.townSPR - Sparse Priming Representations

1. SPR имитирует структуру человеческой памяти

2. Сжимает информацию в ключевые фразы

3. Позволяет моделям эффективно реконструировать знания

4. Фокус на существенных элементах и контексте

Применение:

• Оптимизация памяти в языковых моделях

• Образовательные инструменты

• Коммуникационные инструменты

16.

codex.townMemGPT

1.

Инновации в управлении памятью

• Разработано исследователями из Беркли.

• Расширяет возможности больших языковых моделей за счёт долгосрочного извлечения и записи информации в память.

• Преодолевает ограничения стандартного окна контекста ввода.

2.

Интеграция цикла обратной связи

• Связывает события пользователя с поиском в виртуальном контексте и выполнением функций.

• Имитирует управление памятью операционной системы в рамках языковой модели.

3.

Иерархическая система памяти

• Использует двухуровневую структуру памяти: Основной Контекст и Внешний Контекст.

• Обеспечивает передачу данных, аналогичную работе оперативной памяти и дисковой памяти в компьютерах.

4.

Расширенные функциональные возможности

• Позволяет LLM процессору осуществлять цепочку функций.

• Возможность выполнения сложных задач, таких как поиск по базе данных и обмен сообщениями в рамках единого рабочего

процесса.

5.

Способность к самооптимизации

• Адаптируется и переписывает свою память через прямое взаимодействие и корректировки со стороны пользователей.

17.

codex.townДемонстрация

18.

codex.townДемонстрация Flowise+Zep

19.

codex.townДемонстрация SPR

20.

codex.townДемонстрация MemGPT

21.

codex.townЗаключение

22.

codex.townЗаключение

1.

Критическая роль механизмов памяти: Мы подтвердили, что для понимания и

генерации естественного языка механизмы памяти играют ключевую роль.

2.

Стратегии памяти: Были исследованы стратегии управления долговременной и

кратковременной памятью, которые могут быть применены в языковых моделях.

3.

Демонстрация эффективности: На примере демо чат-бота показано улучшение

производительности за счет интеграции механизмов памяти.

4.

Практическая значимость: Обсуждение значимости исследований механизмов

памяти для будущих прорывов в области искусственного интеллекта.

5.

Пути развития: Определены перспективные направления для будущих

исследований, способные способствовать эволюции языковых моделей.

23.

Спасибо!Телеграм

t.me/cryptoEssay

t.me/mikefluff

Youtube:

www.youtube.com/@cryptoEssay1

instagram.com/mikeflufff

codex.town

inite.io

Site:

internet

internet